Google AI ha presentado STATIC: optimización de matrices dispersas, un framework disruptivo que promete revolucionar la eficiencia de los Modelos de Lenguaje Grandes (LLMs). Este desarrollo, basado en matrices dispersas, logra acelerar drásticamente el constrained decoding en la recuperación generativa, con mejoras de hasta 948 veces en velocidad. Para nuestras empresas, esto no es solo un número: significa que las aplicaciones de IA actuales y futuras serán notablemente más rápidas y asequibles.

STATIC de Google AI: Rompiendo Barreras en la Velocidad de LLMs

El desafío con los LLMs ha sido siempre su apetito computacional, especialmente en tareas de generación con restricciones. Cuando necesitamos que un modelo genere respuestas muy específicas —como identificadores de documentos en un sistema de búsqueda— se aplica el constrained decoding. Esto implica ‘obligar’ al modelo a elegir ciertas palabras o estructuras, un proceso que hasta ahora era intensivo en cálculo y lento. Las arquitecturas tradicionales de transformadores sufren por la atención cuadrática y la necesidad de evaluar múltiples trayectorias de generación, lo que se traduce en latencia y costes.

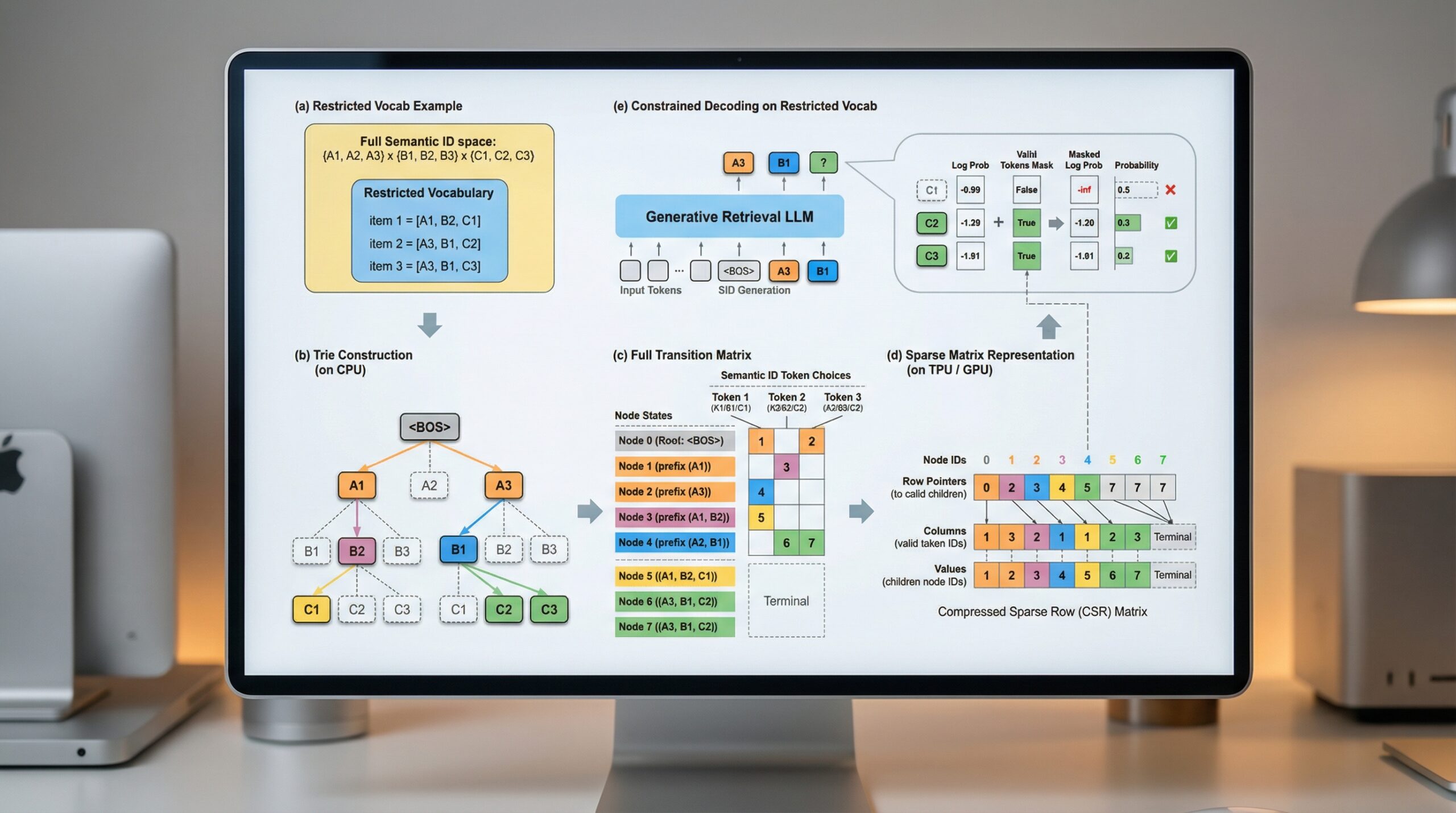

Aquí es donde entra STATIC. En lugar de procesar todos los datos de forma densa (lo que sería como mover un elefante completo para usar solo su trompa), STATIC modela estas restricciones como un grafo acíclico dirigido (DAG) precomputado y utiliza operaciones matriciales dispersas. Imaginen un mapa donde solo marcamos las carreteras importantes en lugar de cada metro cuadrado de terreno. El resultado es que aprovechamos que solo un pequeño porcentaje de las activaciones del LLM son realmente relevantes en un momento dado (alrededor del 1-5%).

¿Qué Implica STATIC para tu Negocio?

Este framework no es un concepto teórico; es una solución práctica con beneficios tangibles:

- Precomputa topologías de restricciones: Utilizando el formato CSR (Compressed Sparse Row), reduce la memoria y el tiempo de inferencia, lo que se traduce en menos recursos necesarios.

- Fusión de kernels: Evita recomputaciones redundantes, haciendo que el proceso sea más ágil y eficiente.

- Soporte multi-constraint fusion: Permite combinar múltiples tipos de restricciones (léxicas, semánticas, temporales) en una sola matriz, simplificando la gestión de reglas complejas para los modelos.

- Escalabilidad lineal: A diferencia de métodos anteriores que escalaban cuadráticamente con el vocabulario, STATIC escala de forma lineal. Esto es crucial a medida que los LLMs crecen en tamaño y complejidad.

Los benchmarks son contundentes: hablar de 948 veces más velocidad en RAG (Retrieval-Augmented Generation) sobre datasets de referencia como MS MARCO y Natural Questions, manteniendo una precisión del 99.5% de recall@10, es impresionante. Con STATIC, tareas que antes tomaban horas (como procesar un millón de tokens) ahora se completan en segundos. Esto habilita el despliegue a gran escala de LLMs en entornos de producción, desde la búsqueda impulsada por IA hasta agentes conversacionales.

Análisis Blixel: Tu Ventaja Competitiva con STATIC

Este avance de Google AI es una señal clara de por dónde van los tiros: eficiencia y escalabilidad. Para una PYME, esto significa que la IA ya no es un lujo inalcanzable. Herramientas basadas en LLMs para atención al cliente, análisis de documentos, o generación de contenido pueden volverse significativamente más rápidas y baratas de implementar. ¿Qué implicaciones prácticas tiene esto?

Primero, menores costes operativos. Un procesamiento más rápido se traduce en menos uso de TPU/GPU, ergo, menos factura de computación en la nube. Segundo, mayor agilidad y mejor experiencia de usuario. Si tus aplicaciones de IA responden casi instantáneamente, la productividad de tus empleados y la satisfacción de tus clientes se disparan. Tercero, expansión de las capacidades de tus agentes de IA. Podrás integrar funciones más complejas de recuperación generativa o búsqueda inteligente sin sacrificar rendimiento.

Mi recomendación es clara: si ya utilizas o planeas usar LLMs en tu operativa, pon atención a las integraciones de STATIC. Puede que no lo implementes directamente, pero los proveedores de servicios y plataformas que consumes sí lo harán. Esto te permitirá desplegar IA más potente incluso en dispositivos con recursos limitados (edge devices), ampliando tus posibilidades. La eficiencia es el nuevo motor de la IA empresarial.

Fuente: Marktechpost

Deja una respuesta