En el panorama actual de IA, la velocidad es un diferenciador clave. Recientemente, OpenAI Codex Spark ha irrumpido en el escenario como una solución para la codificación en tiempo real, prometiendo una aceleración sin precedentes. Esta versión optimizada de GPT-5.3 Codex, diseñada específicamente para tareas de programación, ha logrado velocidades de generación de más de 1000 tokens por segundo, un hito impresionante gracias a su implementación en el hardware Wafer Scale Engine 3 (WSE-3) de Cerebras. Esto representa un aumento de 15 veces en rapidez comparado con su predecesor, una cifra que no podemos ignorar las empresas que buscamos eficiencia.

OpenAI Codex Spark: La velocidad redefine el desarrollo

La integración de OpenAI Codex Spark con el WSE-3 de Cerebras no es solo una anécdota técnica; es un cambio de paradigma para el desarrollo de software asistido por IA. Con una ventana de contexto de 128k tokens, este modelo es capaz de manejar proyectos complejos, entender dependencias entre cientos de archivos y hasta sugerir refactorizaciones arquitectónicas. Esto significa menos tiempo perdido en la comprensión de bases de código legadas o en la planificación inicial, permitiendo a los equipos enfocarse en la innovación y la entrega de valor.

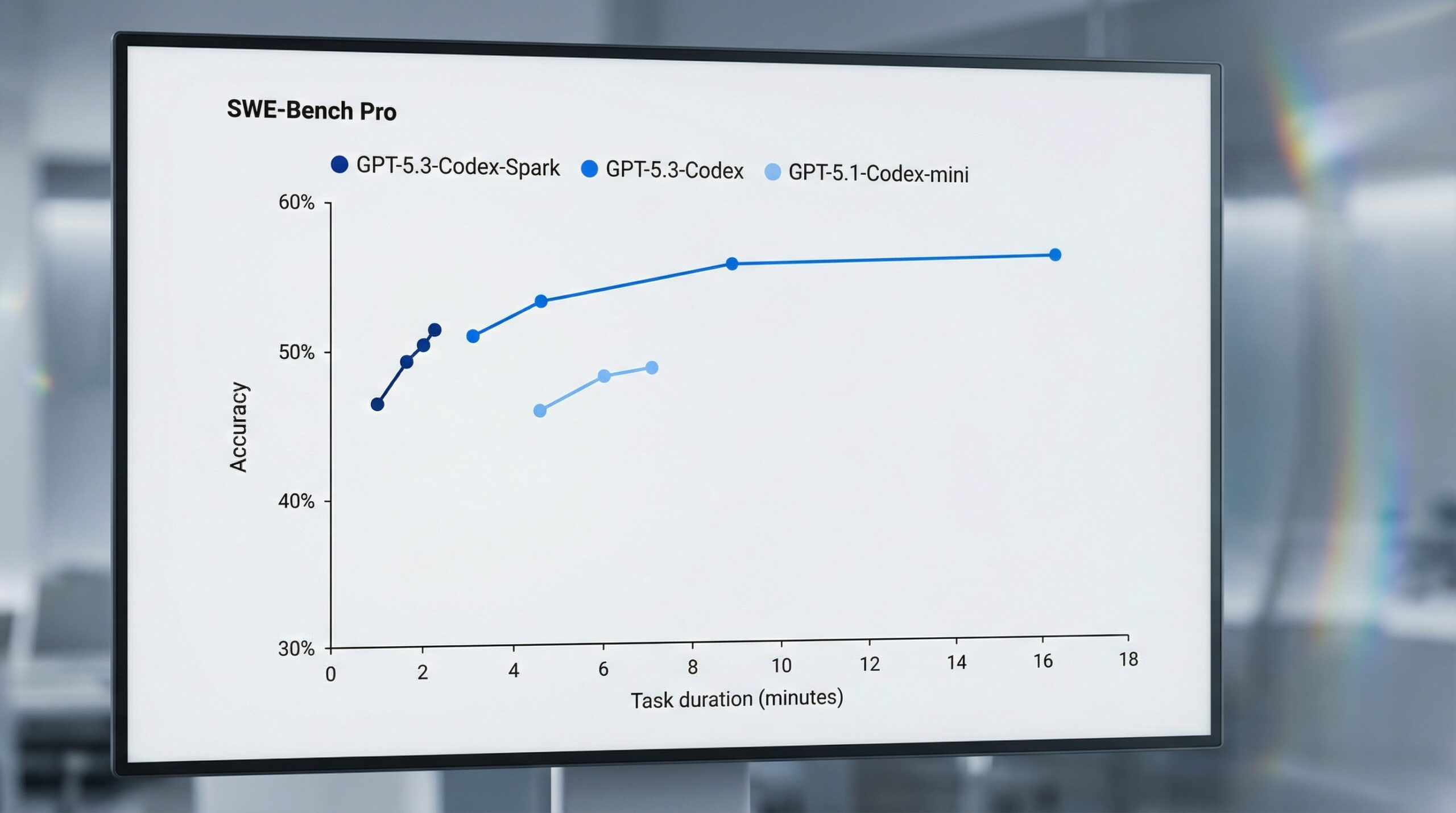

La optimización para latencia ultra-baja facilita flujos de trabajo interactivos, donde los desarrolladores pueden intervenir, redirigir o iterar en tiempo real. Aunque sacrifica algo de exactitud frente a modelos más grandes en benchmarks específicos, su velocidad lo posiciona como un complemento ideal para tareas rápidas y repetitivas, liberando a sus desarrolladores para un razonamiento más profundo. Este avance es crucial para acelerar el time-to-market, reducir barreras técnicas y soportar tareas intensivas como debugging sistemático o migraciones de código. Descubre más sobre cómo la IA se aplica hoy en el sector.

Análisis Blixel: Más allá de la promesa, la eficiencia real para PYMES

Desde Blixel, vemos esta noticia como una oportunidad tangible para las PYMES. La mejora de 15x en la velocidad de codificación no es un dato de laboratorio; es un factor que impacta directamente en la productividad de sus equipos de desarrollo y, por ende, en su competitividad. Aquí no estamos hablando de reemplazar desarrolladores, sino de potenciar su capacidad de respuesta.

El punto clave es cómo OpenAI Codex Spark les permite hacer más con los recursos que ya tienen. Imaginen reducir el tiempo de las tareas repetitivas o la curva de aprendizaje en proyectos nuevos. Esto se traduce en ciclos de desarrollo más cortos, una mayor capacidad para innovar y la posibilidad de atender más proyectos o funcionalidades en el mismo periodo. Es cierto que podría requerir más revisiones manuales al inicio, pero el incremento en la velocidad inicial compensa sobradamente.

Mi recomendación práctica: si su equipo de desarrollo está saturado o buscan nuevas formas de acelerar la entrega de software, deberían considerar seriamente integrar soluciones basadas en este tipo de modelos. Empiecen por proyectos piloto, tareas de refactorización o generación de código auxiliar. La inversión inicial es mínima comparada con el potencial retorno en eficiencia.

La colaboración con Cerebras y su chip WSE-3, con sus impresionantes 127 petaFLOPS y 4 billones de transistores, no solo rompe con la dependencia de Nvidia, sino que también marca el camino hacia una nueva arquitectura de cómputo optimizada para la IA. OpenAI ha implementado mejoras sustanciales en la pila de inferencia, la inicialización de sesiones y en el flujo cliente-servidor, todo con el objetivo de minimizar la latencia. Esto es el inicio de modelos ultrarrápidos y un modelo bimodal para Codex: uno en tiempo real y otro para razonamiento a largo plazo, con subagentes operando en paralelo. Anticipamos que esta evolución de OpenAI Codex Spark transformará cómo abordamos la codificación y el desarrollo de software.

Fuente: Marktechpost