En el mundo de la inteligencia artificial, uno de los mayores desafíos es el consumo computacional. Google Research ha dado un paso gigante en esta dirección con TurboQuant, una innovadora suite de técnicas de compresión extrema para modelos de IA que redefine la eficiencia. Esta tecnología permite reducir drásticamente el tamaño de modelos grandes sin sacrificar rendimiento, abriendo la puerta a una IA más accesible y ubicua.

TurboQuant integra cuantización agresiva, poda estructurada y destilación de conocimiento. Imaginen reducir el tamaño de un LLM (Modelo de Lenguaje Grande) hasta 100 veces. Esto es lo que consigue TurboQuant, a través de métodos como la cuantización por debajo de 4 bits y activación dinámica, que optimizan el uso de los recursos desde la base.

Impacto de TurboQuant en el uso de la IA

El núcleo de esta metodología es el ‘quantization-aware training’ extendido a regímenes ultra-bajos. Esto significa que el entrenamiento del modelo desde sus primeras etapas simula la cuantización extrema. Además, incorpora poda de magnitudes neuronales guiada por saliencia, eliminando hasta el 95% de parámetros sin una merma significativa en la precisión de benchmarks como GLUE y SuperGLUE. En la práctica, esto se traduce en modelos mucho más ligeros que pueden correr en hardware menos potente.

Para la inferencia eficiente, TurboQuant emplea fusión de operadores y ‘scheduling’ adaptativo de precisión, alternando entre modos de alta y baja precisión según la complejidad de la entrada. Esto no solo hace los modelos más pequeños, sino que también los hace más inteligentes a la hora de procesar información, optimizando cada ciclo de CPU o GPU. Para las PYMEs, esto significa acceso a capacidades de IA antes impensables por costes o limitaciones de infraestructura.

Análisis Blixel: Más allá de la teoría, soluciones reales para tu empresa

Como Sofía Navarro, mi trabajo es siempre traducir estos avances técnicos en algo tangible y accionable para vuestras empresas. TurboQuant no es solo una novedad; es un cambio de paradigma para la adopción de IA. ¿Cuántas veces hemos oído que la IA es cara, que requiere servidores enormes o que consume demasiada energía? TurboQuant de Google ataca directamente esas barreras.

Pensemos en dispositivos edge, móviles o sistemas IoT. Antes, integrar un LLM potente era impensable. Con esta tecnología, el «cerebro» de un modelo avanzado puede comprimirse para caber en un smartphone o en un sensor industrial, abriendo un abanico de posibilidades: desde asistentes de voz locales ultrarrápidos hasta mantenimiento predictivo avanzado en fábricas sin depender de la nube.

¿Qué significa esto para tu negocio?

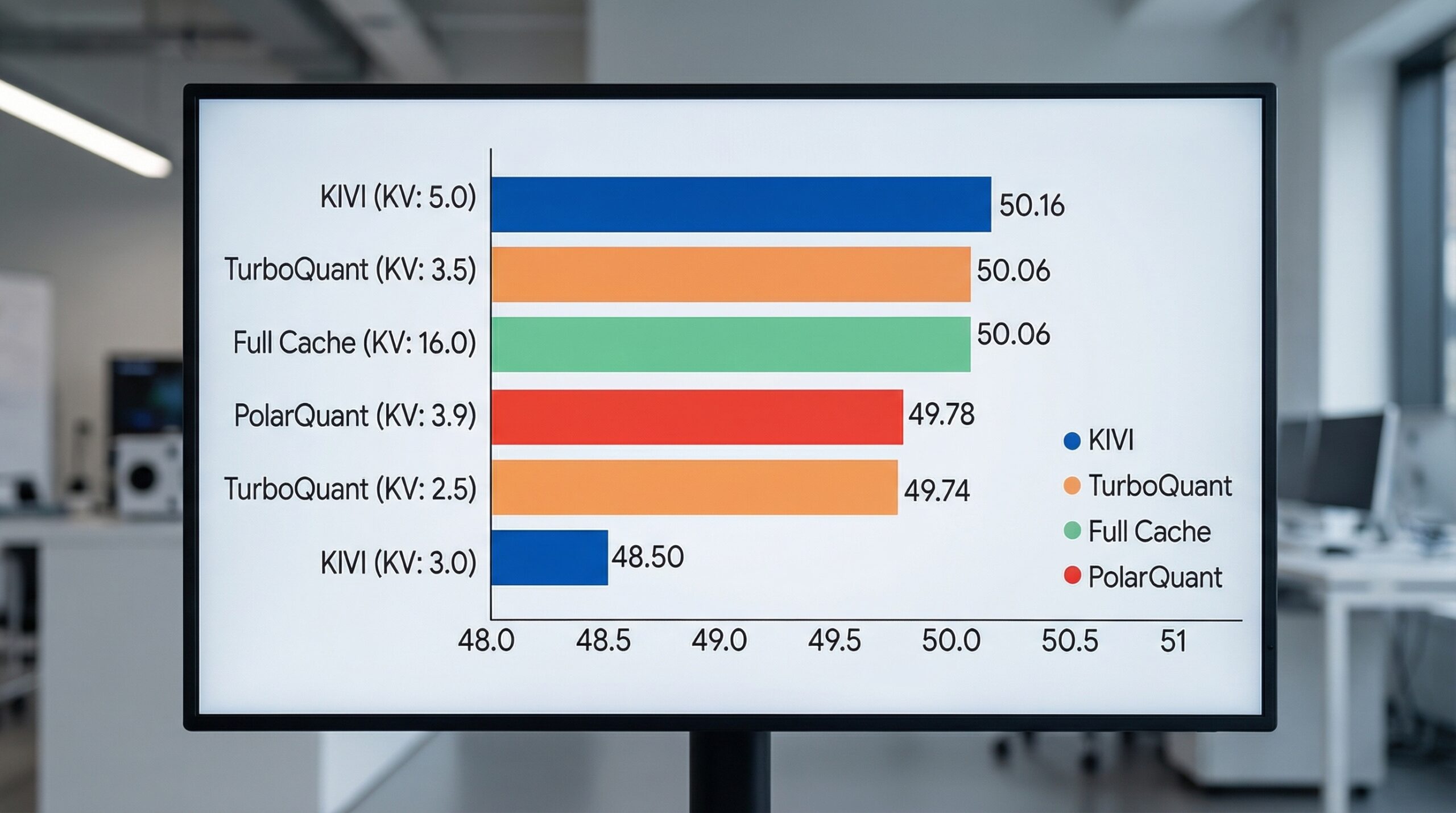

Desde Blixel, vemos un futuro donde la IA es ubicua y, más importante, asequible. Los resultados de TurboQuant hablan por sí mismos: reduce la huella de memoria en un 90% y la latencia de inferencia en 8x para modelos con miles de millones de parámetros. Esto significa que, si tu empresa está pensando en implementar analítica de texto, chatbots de soporte avanzado o sistemas de visión artificial, los costes operativos y de infraestructura se reducirán drásticamente. Menos consumo, menor latencia, mayor autonomía para tus sistemas. Es una oportunidad de democratizar el acceso a la IA avanzada que no podemos ignorar. Es hora de pensar cómo podemos integrar estas eficiencias en vuestros productos y servicios, sin tener que invertir en infraestructuras mastodónticas.

La metodología incluye incluso el entrenamiento conjunto de un ‘student model’ compacto a partir de múltiples ‘teachers’ comprimidos, mejorando la robustez. Esta técnica aborda limitaciones clave de la IA actual: alto consumo computacional y barreras de despliegue. TurboQuant pavimenta el camino para IA ubicua, desde móviles hasta IoT, manteniendo capacidades de modelos de frontera. Su implementación open-source facilita adopción amplia, con código y pesos pre-entrenados disponibles, lo que permite a las empresas y desarrolladores aprovechar estos avances de inmediato.

Fuente: Google Research Blog