En el panorama actual, donde la implementación de la inteligencia artificial es una prioridad para muchas empresas, la seguridad y estabilidad en el despliegue de modelos de Machine Learning (ML) se vuelven críticas. No basta con desarrollar un modelo excelente; la clave está en cómo lo introducimos en entornos productivos sin causar disrupciones. Precisamente, para abordar esto de forma controlada y minimizando riesgos, existen diversas estrategias de despliegue seguras de ML en producción que toda PYME debería considerar, incluso con recursos limitados.

¿Qué Estrategias de Despliegue Seguras de ML en Producción Existen?

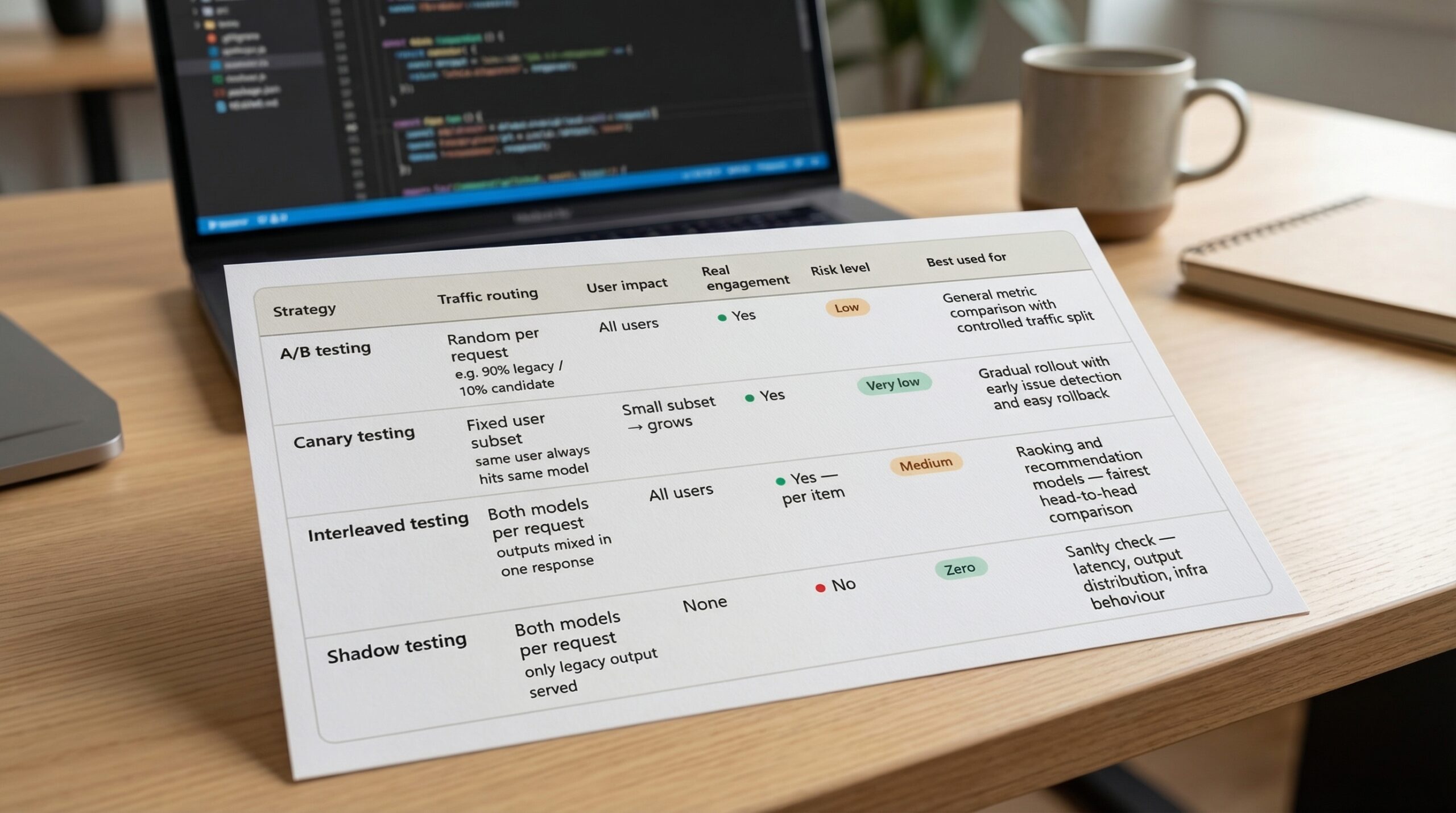

La adopción de modelos de ML en producción puede ser un proceso delicado. Un error, por pequeño que sea, puede traducirse en pérdidas económicas, clientes insatisfechos o incluso problemas de reputación. Por eso, entender y aplicar estas técnicas es fundamental. Vamos a desglosar las cuatro estrategias principales:

1. A/B Testing: Comparación Directa para Optimización

El A/B testing para modelos de ML funciona de manera similar a como lo conocemos en marketing. Se divide el tráfico de usuarios en dos grupos: uno interactúa con la versión actual (control) y otro con la nueva versión del modelo (variante). El objetivo es comparar el rendimiento en métricas clave (precisión, latencia, ROI, etc.) para determinar qué versión es superior. Si bien requiere una segmentación de usuarios y un sistema de enrutamiento sofisticado, es ideal para optimizaciones continuas y para establecer causalidad entre el cambio del modelo y el impacto en el negocio.

2. Canary Releases: Despliegue Gradual para Minimizar Riesgos

Esta estrategia consiste en desplegar la nueva versión del modelo a un subconjunto muy pequeño de usuarios (entre el 5% y el 10% inicialmente) mientras se monitorea su comportamiento y rendimiento en tiempo real. Si el modelo se comporta como se espera, mostrando métricas estables (por ejemplo, una tasa de error inferior al 1%, latencia predecible), el despliegue se expande gradualmente a más usuarios. La belleza de las Canary releases es que limitan el «radio de la explosión» (blast radius) de un posible fallo, permitiendo un rollback rápido si algo sale mal.

3. Interleaved Testing: Evaluación Simultánea para Detección Rápida

El Interleaved testing es una técnica potente que envía la misma entrada simultáneamente a ambos modelos (el antiguo y el nuevo), comparando sus salidas para el mismo usuario. Esta metodología es extremadamente eficiente para detectar desviaciones en las predicciones sin afectar la experiencia real del usuario en producción. Aunque puede añadir una ligera latencia debido a la ejecución dual, el valor de identificar rápidamente inconsistencias o regresiones es inmenso.

4. Shadow Testing: Validación Silenciosa sin Impacto

Conocido también como «dark launches», el Shadow testing es una forma de validar un nuevo modelo en producción sin que sus predicciones afecten las respuestas reales. El tráfico de producción se enruta al nuevo modelo en paralelo, pero sus resultados no se utilizan. Esto permite capturar datos reales de entrada y salida para evaluar el rendimiento del nuevo modelo offline. Es una técnica ideal para pruebas de integridad y para ganar confianza en un modelo antes de su despliegue activo, ya que no conlleva ningún riesgo directo para los usuarios finales.

Análisis Blixel: Implementando Estas Estrategias en su PYME

Desde Blixel, vemos con frecuencia cómo las PYMES se enfrentan a la paradoja de querer innovar con IA sin los recursos de las grandes corporaciones para gestionar despliegues complejos. Mi recomendación es sencilla: no tienen que implementar todas estas estrategias de golpe, pero sí entenderlas y aplicarlas progresivamente. Para empezar, un buen monitoreo es no negociable. Herramientas como Prometheus y Grafana, o incluso soluciones más sencillas pero efectivas, son esenciales para observar el comportamiento de sus modelos.

Empiecen con pruebas de Shadow Testing, que ofrecen una validación de bajo riesgo. Una vez que tengan más confianza y experiencia, avancen a Canary releases para un despliegue gradual y controlado. No olviden la importancia de los procedimientos de rollback; saber cómo volver rápida y eficientemente a una versión anterior es su salvavidas. La clave es la gradualidad y la observabilidad. Considere los pipelines de CI/CD para automatizar, y explore soluciones MLOps como MLflow para el seguimiento de experimentos. La reproducibilidad de sus modelos mediante contenedores (Docker/K8s) es el pilar para cualquier estrategia de despliegue segura.

Cada una de estas estrategias de despliegue seguras de ML en producción tiene sus ventajas y desafíos, desde el overhead computacional hasta la necesidad de una segmentación precisa o la gestión de estado en modelos secuenciales. Sin embargo, su aplicación combinada o selectiva, dependiendo de la madurez del equipo y la criticidad del modelo, es lo que finalmente garantiza un despliegue exitoso y libre de inconvenientes. Son aplicables a cualquier stack ML (TensorFlow, PyTorch, scikit-learn) y plataformas cloud como AWS SageMaker o GCP Vertex AI, democratizando así la seguridad en la innovación para empresas de todos los tamaños.

Fuente: Marktechpost