Prepárense, porque lo que ha lanzado Sakana AI con Doc-to-LoRA y Text-to-LoRA no es solo una novedad; es un giro importante en cómo las empresas, especialmente las PYMES, podrán interactuar y aprovechar los Large Language Models (LLMs). En un mercado donde la adaptación de un LLM a necesidades específicas es cara y compleja, Sakana AI ofrece una alternativa que promete democratizar el acceso a modelos especializados.

Imaginen esto: adaptar un LLM ya no requerirá fine-tuning costoso ni ejércitos de ingenieros. Estas dos herramientas, Doc-to-LoRA y Text-to-LoRA, son como una navaja suiza para personalizar modelos de lenguaje. Permiten generar adaptadores LoRA (Low-Rank Adaptation) de forma instantánea y eficiente, sin ese desembolso de recursos que solía ser un cuello de botella.

Sakana AI y la gestión de contexto largo con Doc-to-LoRA

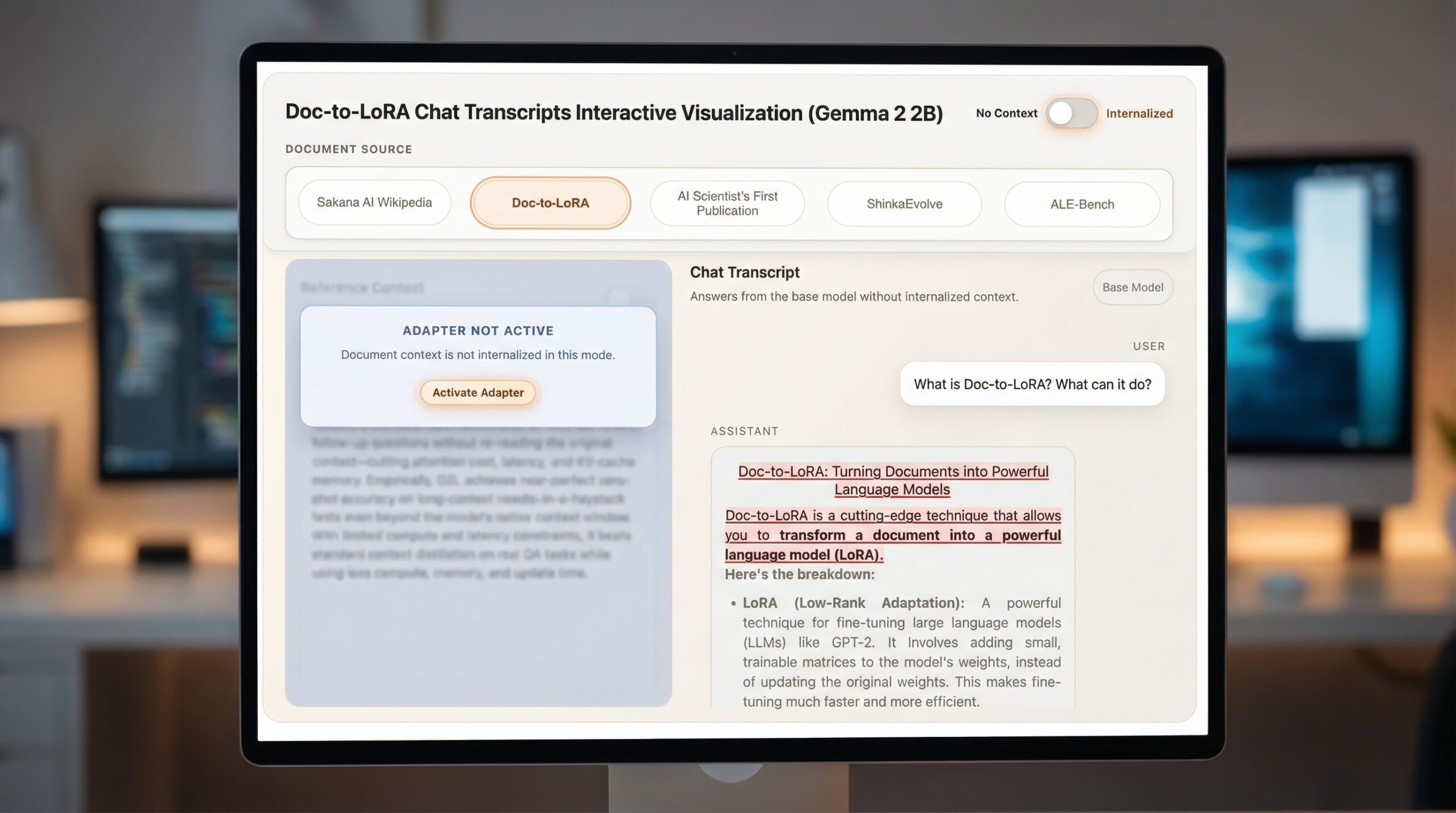

Uno de los mayores dolores de cabeza con los LLMs es procesar y entender documentos muy largos. El contexto se pierde, la información crítica se diluye y los costes de computación se disparan. Doc-to-LoRA de Sakana AI ataca este problema de raíz. Convierte documentos (ya sean textos planos o incluso información visual procesada por un VLM) en adaptadores LoRA compactos. Hablamos de adaptadores con apenas 3.4 millones de parámetros (rank-8), lo que es una eficiencia brutal.

El truco está en un hypernetwork basado en Perceiver, entrenado para aprender a generar estas actualizaciones. En lugar de procesar todo el documento cada vez, el sistema aprende a predecir qué modificaciones necesita el LLM para entender ese contenido específico. Este proceso, aunque incluye un meta-training inicial más intensivo, permite un despliegue de adaptadores en segundos una vez entrenado. Para los documentos que exceden la ventana de contexto estándar, Doc-to-LoRA los divide en fragmentos, generando LoRAs individuales que luego se componen. ¿El resultado? Una precisión casi perfecta incluso con documentos de hasta 40.000 tokens, superando con creces la capacidad de un modelo base sin adaptación, según sus pruebas de ‘Needle-in-a-Haystack’. Esto es oro puro para empresas que manejan grandes volúmenes de documentación legal, técnica o de investigación. Las fuentes originales de esta información son clave para entender la magnitud de su avance.

Text-to-LoRA: Adaptación de LLMs por descripción textual

Si Doc-to-LoRA es para documentos, Text-to-LoRA es para tareas. Aquí, la idea es extender esa facilidad de adaptación a descripciones de tareas, usando lenguaje natural. Imaginen que quieren un LLM que resuma correos electrónicos de forma específica, o que genere textos con un tono muy particular. Con Text-to-LoRA de Sakana AI, bastará con describir la tarea en texto, y el hypernetwork generará el adaptador LoRA correspondiente. Esto baja la barrera de entrada a niveles inimaginables para usuarios no técnicos.

Inspirado en cómo los sistemas biológicos se adaptan rápidamente, este sistema ha sido entrenado con una librería masiva de tareas (479, para ser exactos), demostrando ser capaz de comprimir bibliotecas de adaptadores manteniendo un rendimiento excelente. Lo más impresionante es su capacidad para generalizar a tareas que nunca ha visto, simplemente a partir de una descripción. Esto simplifica drásticamente el uso de LLMs para cualquier tipo de negocio. Han anunciado que publicarán un paper en ICML2025 y ya se puede encontrar código en GitHub con una WebUI para Mistral-7B, lo que facilita mucho la exploración de esta tecnología.

Análisis Blixel: Implicaciones para tu negocio

Desde Blixel, vemos en las propuestas de Sakana AI un cambio de paradigma real para las PYMES. La principal limitación para muchas empresas al adoptar IA ha sido el costo y la complejidad de personalizar los modelos existentes. Con Doc-to-LoRA y Text-to-LoRA, esa barrera se reduce drásticamente.

Pensemos en aplicaciones concretas. ¿Eres una consultoría legal? Doc-to-LoRA podría adaptar un LLM para que analice contratos gigantescos con una precisión impensable y sin inflar tu factura de computación. ¿Una empresa de atención al cliente? Text-to-LoRA podría generar adaptadores a medida para manejar consultas específicas de tu sector, simplemente describiendo lo que necesitas del bot. Esto significa que las empresas pequeñas y medianas pueden empezar a jugar en la misma liga que las grandes en términos de personalización de IA, sin las astronómicas inversiones previas. La promesa de escalar linealmente sin alterar la arquitectura a medida que se añaden más «chunks» es algo que debe tenerse muy en cuenta para la sostenibilidad del uso de estas soluciones a largo plazo. Es una inversión inicial en optimización para un retorno constante en eficiencia.

Fuente: Marktechpost