En el mundo de la inteligencia artificial, especialmente en el ámbito empresarial, es habitual encontrar modelos que, tras un desarrollo y validación prometedores, fracasan estrepitosamente al ser desplegados en entornos reales. A esto lo llamamos fragilidad en modelos de regresión. El problema es crítico: características redundantes o de bajo valor predictivo no solo no aportan, sino que introducen debilidad, haciendo que modelos con alta precisión en el laboratorio colapsen frente a datos del mundo real con variaciones impredecibles. Esto es lo que se conoce como “fragilidad de producción”.

Impacto de características redundantes en la fragilidad de modelos de regresión

La «fragilidad de producción» es un fenómeno común donde modelos de machine learning, que muestran métricas exitosas en datasets de entrenamiento y validación, no logran mantener ese rendimiento cuando se enfrentan a la variabilidad del mundo real. La causa principal de esta debilidad suele residir en un diseño deficiente del feature engineering, particularmente la inclusión de características (features) que son redundantes o no informativas.

Cuando un modelo se entrena con un exceso de variables, especialmente aquellas que correlacionan fuertemente entre sí o que aportan poco valor predictivo, lo que se consigue no es una mayor precisión, sino una mayor sensibilidad. Esto amplifica su vulnerabilidad a las pequeñas perturbaciones y a los cambios en la distribución de los datos del entorno operativo. Imagina construir un puente con demasiados soportes que, en lugar de fortalecerlo, compiten entre sí y lo hacen más propenso a ceder. En el ML, un modelo puede alcanzar el 95% de precisión en un conjunto de validación, pero colapsar al recibir inputs ligeramente diferentes de los que «espera».

La investigación va más allá de la simple precisión, enfocándose en la robustez adversarial, la generalización fuera de distribución (OOD generalization), la calibración, la cuantificación de incertidumbre y la equidad (fairness). Todas estas métricas son cruciales para entender un rendimiento que va más allá de la predicción puntual. La inclusión de características redundantes incrementa innecesariamente la dimensionalidad del modelo, lo que complica su interpretabilidad y reduce su capacidad real de generalizar.

Por ejemplo, si un modelo de riesgo crediticio incluye el código postal y la ciudad como variables independientes, estas son altamente redundantes. Si el código postal sufre una mínima alteración por un error de entrada, el modelo podría interpretarlo como un dato completamente nuevo y fallar, a pesar de que la ciudad sigue siendo la misma. Esto magnifica la fragilidad en modelos de regresión, haciendo que el sistema sea menos fiable.

Análisis Blixel: Más allá de la precisión a cualquier costo

Desde Blixel, vemos a diario cómo las empresas se obsesionan con la tasa de acierto del modelo en fase de prueba, descuidando su comportamiento en el mundo real. La clave no es solo qué tan bien predice en un dataset estático, sino qué tan bien soporta el «estrés» del día a día. Para una PYME con recursos limitados, esto es aún más importante. Construir modelos robustos desde el principio es más eficiente que corregir fallos caros y reputacionales después. Las características redundantes son un lastre que consume recursos computacionales, introduce ruido y dificulta la interpretabilidad.

Recomendaciones accionables para evitar la fragilidad de producción:

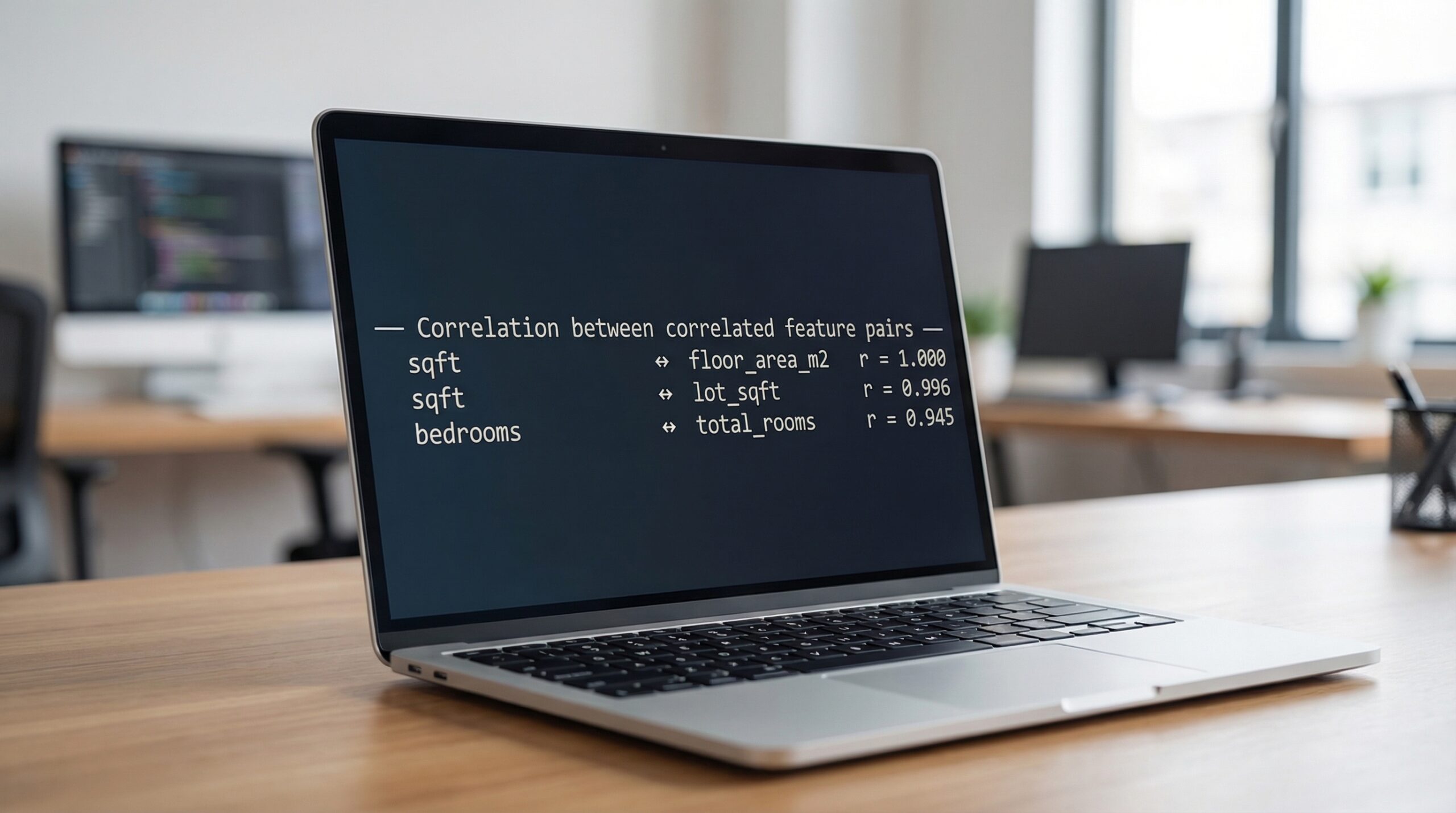

- **Auditoría de Features:** Antes de entrenar, realiza un análisis exhaustivo para identificar y eliminar características con baja varianza, alta correlación con otras o que aporten poco valor predictivo. Herramientas de selección de características (como RFE, PCA o ANOVA) te pueden ayudar.

- **Validación Robusta (OOD):** No te limites a la validación cruzada. Diseña pruebas que simulen cambios en la distribución de datos en producción. Si trabajas con datos temporales, valida con datos futuros desconocidos.

- **Monitoreo Continuo:** Implementa sistemas de monitoreo para detectar el «drift» de datos y el «model decay» en tiempo real. Esto te permitirá reentrenar o ajustar antes de que la fragilidad se convierta en un fallo crítico.

- **Foco en la Interpretabilidad:** Un modelo más simple, con menos características pero más relevantes, es más fácil de entender y, por ende, de auditar y depurar. Esto es crucial cuando hablamos de la fragilidad en modelos de regresión.

La fiabilidad es la base de la confianza. En un entorno de producción, un modelo con un 90% de precisión pero que es frágil es mucho más peligroso que uno con un 85% de precisión, pero extremadamente robusto y predecible en su comportamiento ante escenarios imprevistos.

Fuente: Marktechpost