La interpretabilidad en la inteligencia artificial ha sido tradicionalmente un reto, especialmente al escalar modelos a miles de millones de parámetros. Sin embargo, Guide Labs con su LLM interpretable de 8B parámetros, ha logrado un avance significativo que desafía esta creencia. Han presentado la primera red neuronal de lenguaje a gran escala inherentemente interpretable, manteniendo el rendimiento sin comprometer la transparencia, una noticia clave para cualquier empresa que busque aplicar IA de forma responsable y auditable.

¿Qué implica el LLM interpretable de 8B parámetros de Guide Labs?

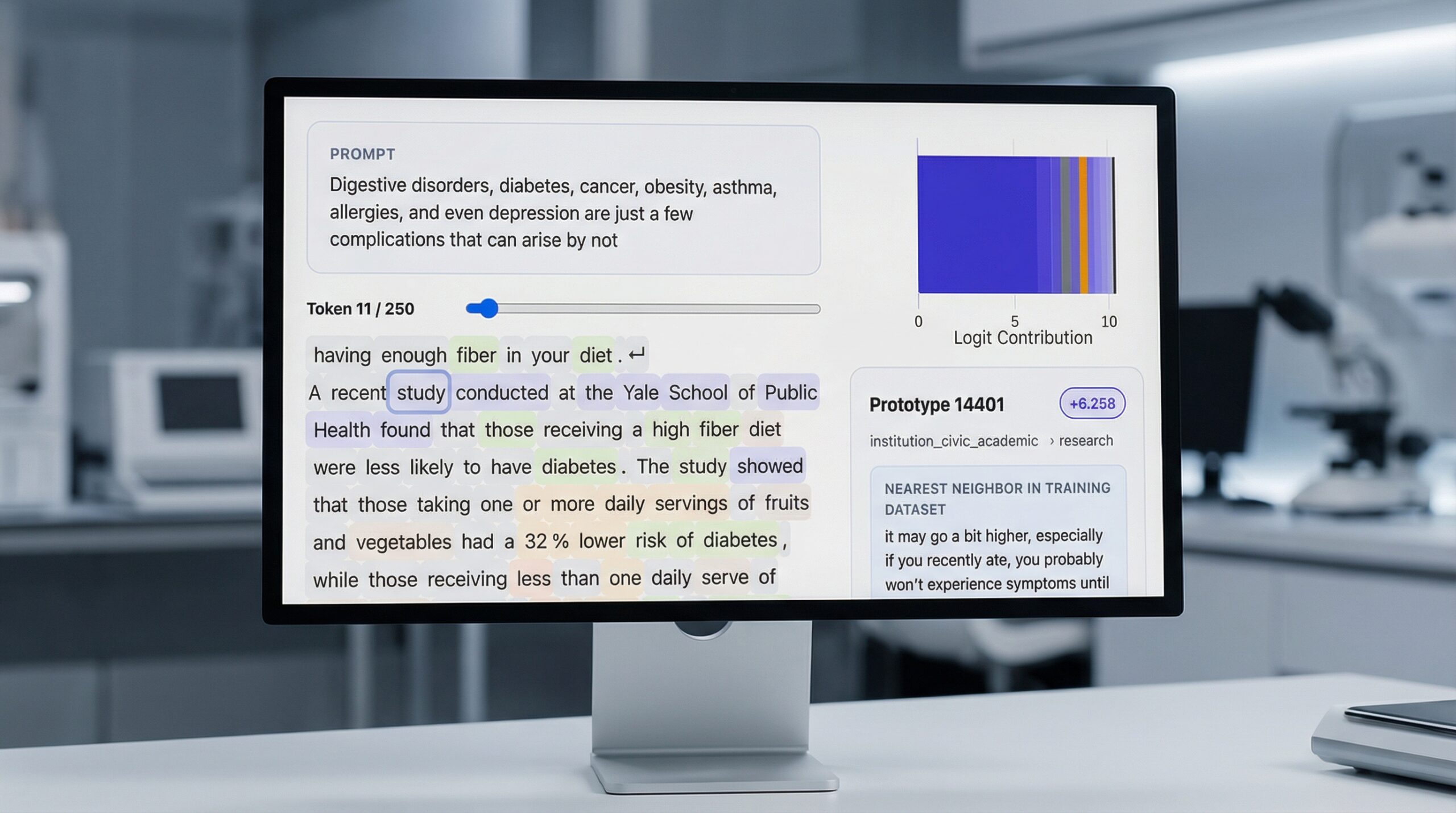

Este logro de Guide Labs no es menor. Al integrar la interpretabilidad directamente en la arquitectura del modelo, Guide Labs se desmarca de los métodos post-hoc que intentan explicar decisiones de IA una vez tomadas. Este nuevo enfoque se basa en tres componentes técnicos cruciales: Atlas, para anotar conjuntos de datos con conceptos que las personas puedan comprender; una arquitectura de difusión discreta para escalar a miles de millones de parámetros sin sacrificar la coherencia; y PRISM, una familia de modelos que revelan qué patrones de datos impulsan cada predicción.

Para su negocio, esto significa que sus sistemas de IA podrían ser no solo potentes, sino también transparentes. Imagine poder entender por qué un modelo de IA tomó una decisión de crédito, identificó un riesgo de seguridad o generó una respuesta específica. Esto es fundamental para cumplir con regulaciones como el futuro AI Act europeo y para generar confianza tanto internamente como con sus clientes. La implementación de IA explicable reduce riesgos y mejora la alineación entre los objetivos empresariales y el comportamiento del modelo, algo que siempre hemos priorizado en Blixel.

Análisis Blixel: Implicaciones Reales para su Empresa

Desde Blixel, vemos este avance de Guide Labs como un punto de inflexión. Para las PYMES, sobre todo en sectores regulados (finanzas, salud, legal), la capacidad de contar con un LLM interpretable de 8B parámetros cambia el juego. Ya no tendrán que elegir entre potencia y explicabilidad. Esto facilita la auditoría, la validación y la justificación de las decisiones automatizadas, minimizando los riesgos legales y éticos asociados a la ‘caja negra’ de la IA actual.

Mi perspectiva es clara: si su empresa ha postergado la adopción de la IA a gran escala por preocupaciones sobre la falta de transparencia, este es el momento de reevaluar. Este tipo de tecnología le permite implementar soluciones avanzadas de IA sabiendo que puede controlar y comprender su comportamiento. Consideren ya la posibilidad de auditar sus proyectos de IA existentes, o planificar los futuros, con esta capa de interpretabilidad desde el diseño. La transparencia no es solo una buena práctica; con Guide Labs, se convierte en un activo estratégico.

Este sistema revela el «por qué» detrás de las predicciones con una sobrecarga de parámetros mínima (menos del 2%) y una atribución de datos que se mantiene muy cerca de la calidad base (dentro del 5%). Esto es vital, ya que tradicionalmente, añadir interpretabilidad implicaba una caída significativa del rendimiento o una complejidad computacional inasumible. Guide Labs demuestra que no tiene por qué ser así.

Las implicaciones son profundas, especialmente para las industrias donde la auditoría, la fiabilidad y la rendición de cuentas son críticas. Un LLM que revela qué patrones de los datos de entrenamiento impulsan cada predicción abre la puerta a un control sin precedentes y a una mejor alineación de la IA con los objetivos de negocio y los valores éticos. Es una oportunidad para que las empresas no solo cumplan, sino que destaquen en un entorno regulatorio cada vez más exigente en cuestiones de inteligencia artificial.

Fuente: TechCrunch