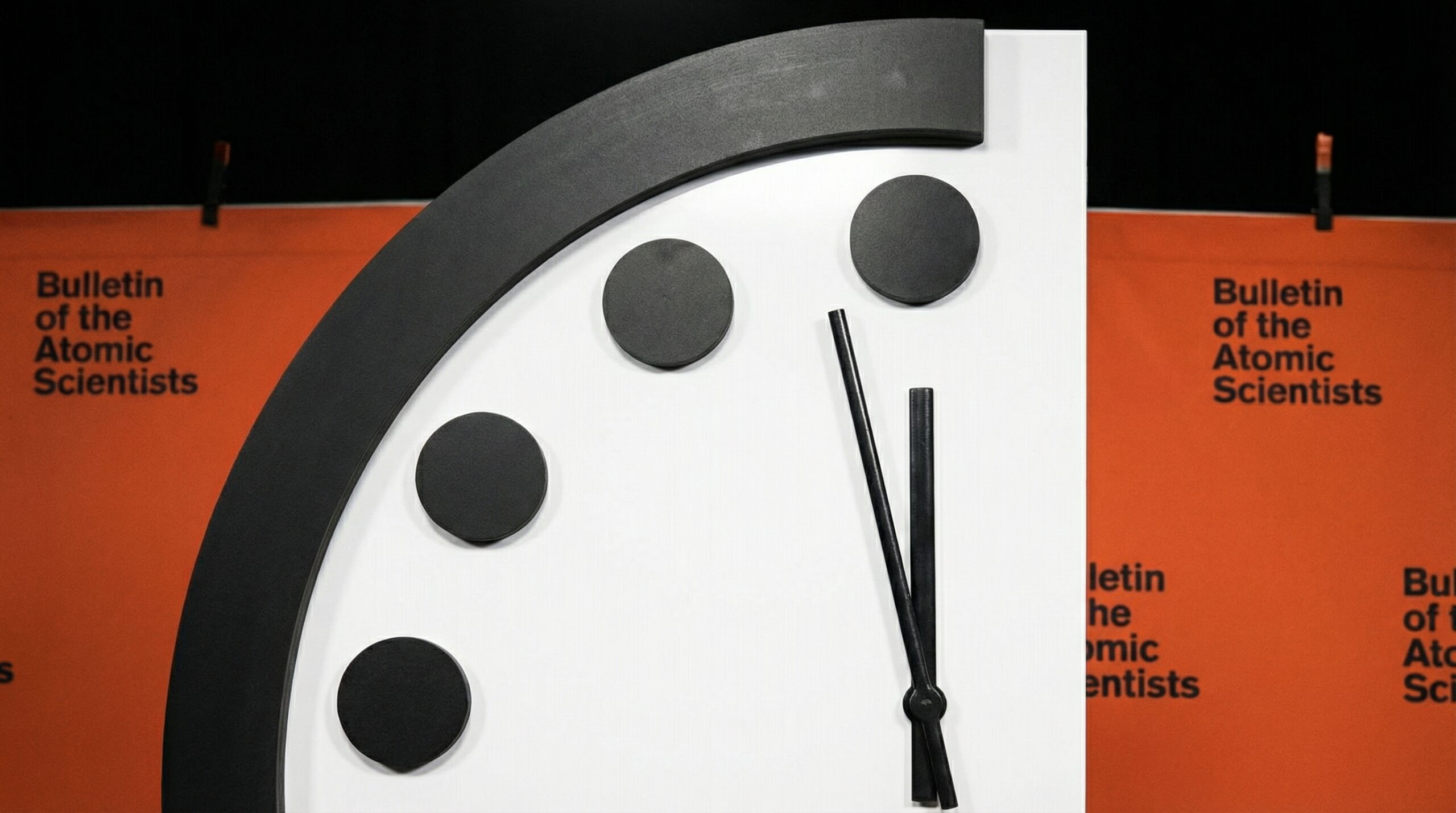

El Reloj del Apocalipsis 85 segundos para la medianoche representa el punto más cercano a la catástrofe desde 1947, según el Boletín de Científicos Atómicos. Este ajuste simbólico en 2026 supera el récord de 89 segundos de 2025, incorporando la inteligencia artificial entre amenazas nucleares, climáticas y biotecnológicas. En un mundo de tensiones geopolíticas, la IA se señala como amplificadora de desinformación y vigilancia, pero ¿es justo culpar a la tecnología por fallos humanos?

Contexto del nuevo ajuste del reloj

El Boletín, respaldado por nobeles y expertos, critica el deterioro de la cooperación internacional. Rusia, China y EE.UU. priorizan nacionalismos agresivos, erosionando tratados como el de No Proliferación Nuclear. Conflictos en Ucrania y Gaza, sumados a políticas trumpistas, impulsan esta carrera armamentística. El Reloj del Apocalipsis 85 segundos refleja no solo armas atómicas, sino cambio climático desde 2007 y ahora IA disruptiva.

Históricamente, el reloj llegó a 17 minutos en 1991 post-Guerra Fría, pero desde 2020 ronda los 100 segundos. Este avance a 85 segundos subraya la falta de liderazgo global, con advertencias sobre probabilidades crecientes de desastre si no se revierte la tendencia.

La IA como amenaza emergente

La declaración destaca la IA por su potencial en desinformación masiva, vigilancia orwelliana y manipulación global. En un contexto de ‘gobernanza fallida’, se ve como catalizador de riesgos existentes. Sin embargo, datos duros muestran que la IA ya salva vidas en medicina y optimiza energías renovables, contrarrestando el clima mejor que protocolos multilaterales inertes.

Ejemplos como deepfakes en elecciones o ciberataques IA-asistidos preocupan, pero precedentes como el alarmismo Y2K demuestran exageraciones pasadas. El verdadero peligro radica en la proliferación nuclear real, no en modelos de lenguaje descontrolados.

Simbolismo vs. realidad regulatoria

Críticos ven el reloj como metáfora efectiva, pero escépticos cuestionan su precisión científica. ¿Mide riesgos cuantificables o fomenta pánico? La mención a IA invita a sobrerregulación, como la UE con su AI Act, que frena innovación europea frente a competidores asiáticos y americanos más ágiles.

En libertad de expresión, la IA amplifica voces, no solo censura. Datos de mercado: inversiones en IA superan 200.000 millones anuales, impulsando PIB global un 15% para 2030 según PwC, pese a narrativas apocalípticas.

Análisis Blixel:

Como redactor escéptico de narrativas oficiales, el Reloj del Apocalipsis 85 segundos me parece un ejercicio simbólico útil, pero con sesgo anti-tecnológico. Culpar a la IA ignora que las verdaderas agujas las mueven líderes nacionalistas y tratados rotos, no algoritmos. Ironía: científicos atómicos, herederos de Hiroshima, ahora temen bits más que bombas. Datos duros desmontan el pánico: tasas de proliferación nuclear caen (SIPRI 2025), mientras IA reduce emisiones CO2 un 4% en optimizaciones logísticas (IEA). La sobrerregulación, disfrazada de ética, mata innovación: miremos China, líder en IA sin ‘frenos morales’ occidentales. Defendamos libertad digital y mercados abiertos; el apocalipsis real es estancamiento regulatorio, no superinteligencia ficticia. Futuro: IA como aliada si evitamos control estatal orwelliano.

Deja una respuesta