El Pentágono desarrolla alternativas a Anthropic ante el rechazo de la empresa a relajar sus estrictas restricciones éticas en modelos de IA como Claude. Fundada como una escisión ‘ética’ de OpenAI, Anthropic firmó un contrato de 200 millones de dólares con el Departamento de Defensa de EE.UU. para integrar su IA en sistemas clasificados, incluyendo colaboraciones con Palantir. Sin embargo, mantiene salvaguardas que vetan usos en vigilancia masiva de ciudadanos estadounidenses o en armas autónomas sin supervisión humana. El CEO Dario Amodei alerta sobre riesgos de ‘alucinaciones’ en entornos bélicos, demandando control humano constante.

Escalada del conflicto con el Pentágono

En febrero de 2026, el Pentágono presionó a cuatro grandes laboratorios de IA, incluyendo Anthropic, para permitir aplicaciones militares ‘para todos los fines legales’: desde inteligencia hasta desarrollo de armas y operaciones de campo. La negativa de Anthropic desencadenó una revisión drástica. El Departamento de Defensa evalúa cortar lazos, calificar a la empresa como ‘riesgo para la cadena de suministro’ bajo la Ley de Producción de Defensa de 1950 y forzar a contratistas a eliminar Claude en seis meses. Esta medida busca garantizar proveedores dispuestos a priorizar la seguridad nacional sobre filtros corporativos.

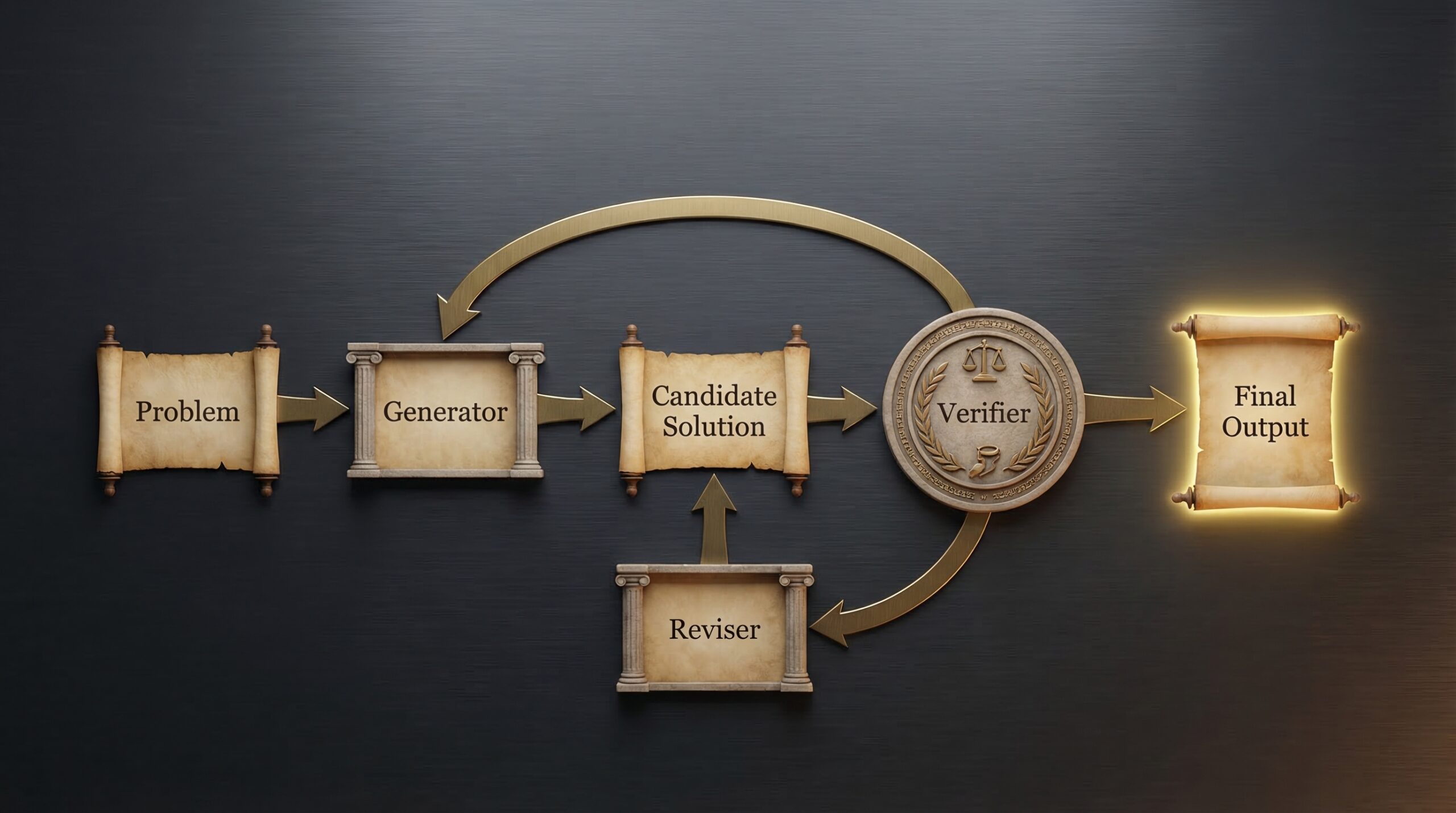

El Pentágono desarrolla alternativas a Anthropic con rapidez: ya firmó con xAI de Elon Musk para integrar Grok en redes secretas, un modelo sin restricciones para vigilancia o armamento. Negocia también con Google y OpenAI, diversificando ante dependencias éticas.

Posturas éticas y reacciones en la industria

Anthropic califica la decisión como ‘no legalmente válida’ y planea impugnarla judicialmente, ofreciendo una transición ordenada. Apoyos internos resaltan divisiones: 219 empleados de Google y 65 de OpenAI respaldan públicamente su rechazo a vigilancia masiva y ‘matar autónomamente’. Sin embargo, estos safeguards ignoran que la IA militar ya usa modelos menos regulados, cuestionando si la ética selectiva no es más bien una barrera comercial.

El debate expone contradicciones: mientras Amodei cita alucinaciones como riesgo letal, el Pentágono argumenta que la supervisión humana mitiga fallos, y retrasar innovación debilita la superioridad estratégica de EE.UU. frente a rivales como China, que no duda en desplegar IA sin filtros.

Implicaciones para la innovación en IA militar

Este roce redefine tensiones entre ética corporativa y demandas de defensa. El Pentágono desarrolla alternativas a Anthropic acelera la transición a proveedores flexibles como xAI, cuyo Grok promete integración sin cortapisas. Datos duros respaldan la urgencia: informes del Congreso destacan que EE.UU. pierde terreno en IA bélica, con China invirtiendo 20 veces más en hardware sin restricciones éticas.

Precedentes como el rechazo de Google a Project Maven en 2018 muestran que presiones éticas internas frenan contratos millonarios, pero terminan beneficiando a competidores menos escrupulosos.

Análisis Blixel:

Como redactor escéptico de narrativas éticas corporativas, veo en este caso una hipocresía clásica: Anthropic, nacida de la rebelión contra OpenAI por ‘lucro descontrolado’, ahora usa safeguards como escudo ante contratos reales. ¿Riesgos de alucinaciones? Cierto, pero la solución no es paralizar innovación militar con vetos arbitrarios, sino invertir en verificación robusta. El Pentágono tiene razón al desarrollar alternativas a Anthropic: la defensa nacional no puede depender de caprichos morales que ignoran precedentes como el uso de IA en drones ucranianos sin filtros. xAI emerge como ganador pragmático, alineado con libre mercado. La verdadera amenaza no son las armas autónomas, sino la sobrerregulación que entrega ventaja estratégica a regímenes autoritarios. Datos del DoD confirman: retrasos éticos cuestan miles de millones y vidas. Hora de priorizar innovación sobre postureo virtuoso.