En 2026, los modelos de IA en estafas digitales han pasado de ser una curiosidad a la herramienta estrella de los cibercriminales. Deepfakes de voces e imágenes realistas, junto con agentes autónomos, permiten suplantaciones perfectas y fraudes ejecutivos en minutos. Lo que antes requería horas de edición manual ahora se genera en segundos, integrando datos de redes sociales para personalizar ataques. Esta evolución no solo acelera el phishing, sino que evade controles biométricos tradicionales, planteando un desafío brutal a bancos y empresas.

El auge de deepfakes y suplantación con IA

Los modelos de IA en estafas digitales como los generativos de texto, imagen y voz crean contenidos indistinguibles de la realidad. Un informe reciente destaca cómo fraudes CEO, donde un ‘director’ pide transferencias urgentes, usan deepfakes para llamadas convincentes. Datos de firmas de ciberseguridad muestran un aumento del 300% en estos incidentes desde 2024, con pérdidas millonarias. Los criminales extraen perfiles de LinkedIn o Instagram para referencias precisas, haciendo que las víctimas duden menos.

La automatización es clave: modelos agénticos orquestan desde reconnaissance hasta ejecución, reduciendo errores humanos. En estafas bancarias, mensajes con hábitos de consumo específicos –como ‘recuerda tu afición al golf’– triplican tasas de éxito frente al phishing genérico.

Implicaciones para finanzas y usuarios

Las instituciones financieras enfrentan un punto de inflexión con estos modelos de IA en estafas digitales. Controles biométricos fallan ante deepfakes de alta resolución, y transacciones fraudulentas se autorizan en tiempo real. Estadísticas de 2026 revelan que el 40% de fraudes bancarios involucran IA, con un costo global estimado en 50.000 millones de dólares anuales. La personalización extrema elimina banderas rojas clásicas como errores gramaticales.

Usuarios individuales son vulnerables: un video falso de un familiar en apuros puede vaciar cuentas en horas. Esto amplifica vectores existentes, pero con precisión quirúrgica.

Defensas predictivas y el rol de la regulación

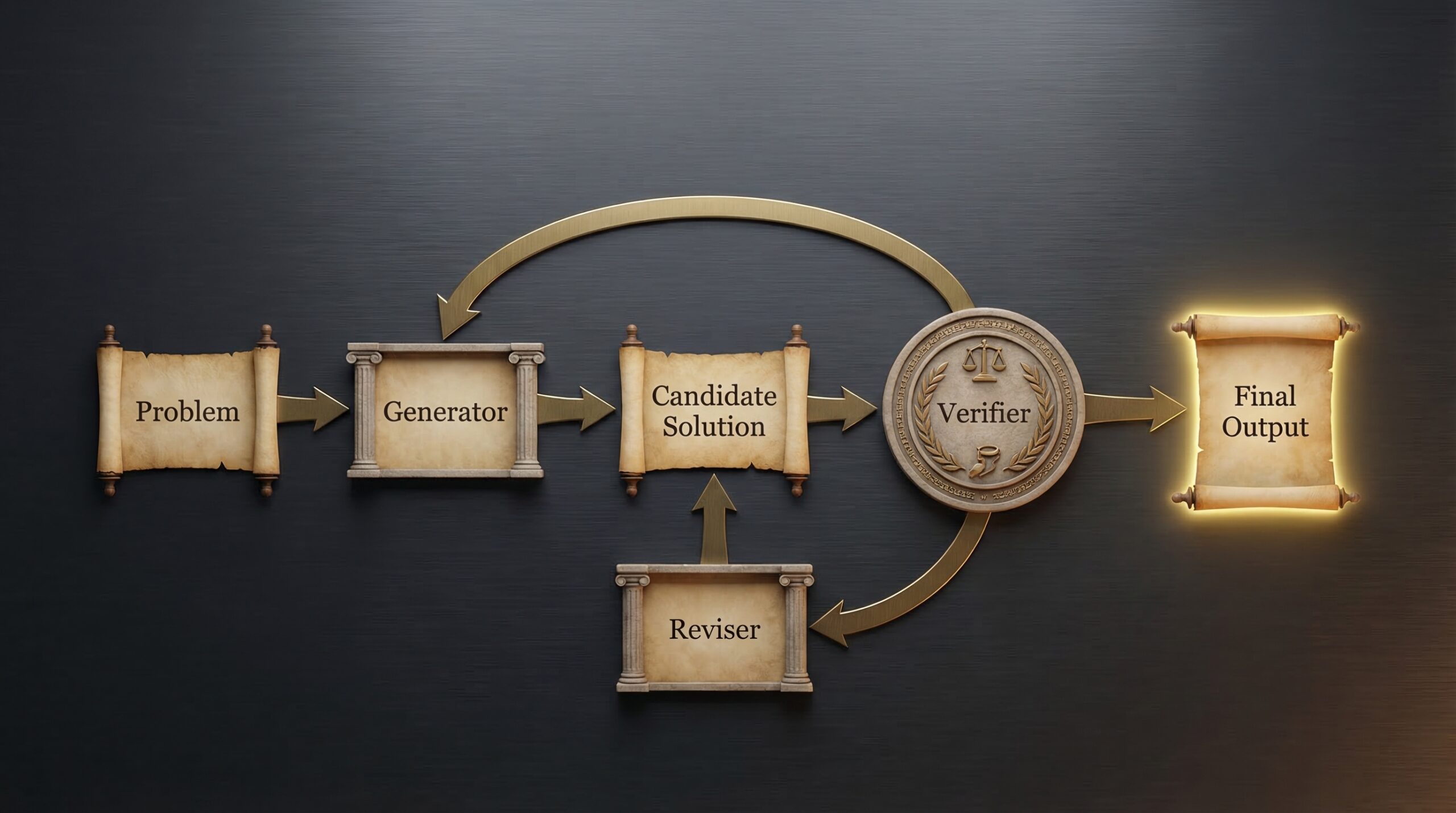

Responder a los modelos de IA en estafas digitales requiere IA defensiva: sistemas que detectan anomalías en patrones de comportamiento digital, como inconsistencias en latencia de voz o microexpresiones. Bancos como JPMorgan ya despliegan modelos para analizar ‘huellas digitales’ únicas, prediciendo amenazas con 95% de precisión. La clave está en la innovación, no en prohibiciones que ralentizarían el progreso general de la IA.

Reguladores europeos empujan certificados de autenticidad para contenidos IA, pero precedentes como GDPR muestran que la sobrerregulación genera costos sin eliminar riesgos –los criminales operan en jurisdicciones laxas.

Análisis Blixel:

Como redactor escéptico de narrativas alarmistas, veo en los modelos de IA en estafas digitales un recordatorio clásico: la tecnología amplifica tanto el bien como el mal, pero culpar a la herramienta es como prohibir cuchillos por los asaltos. Datos duros confirman el problema –el FBI reportó 22.000 millones en pérdidas por BEC en 2025–, pero las soluciones no pasan por ‘regulaciones éticas’ que, irónicamente, benefician a gigantes compliant mientras startups innovadoras se ahogan en burocracia.

La verdadera batalla se libra en el terreno técnico: IA contra IA. Modelos de detección como esos de Google o OpenAI identifican deepfakes con tasas superiores al 98%, y blockchain para verificación de identidad ofrece trazabilidad sin centralización estatal. Preocupa más la hipocresía regulatoria –la UE multa a empresas por ‘riesgos sistémicos’ mientras China lidera en IA ofensiva sin cortapisas.

Pragmáticamente libertario, defiendo innovación abierta: open-source defensivo democratiza protecciones, evitando monopolios. El futuro no es menos IA, sino usuarios y firmas más astutos. Frenar modelos por miedo equivale a parar coches por accidentes –absurdo y contraproducente. En 2026, ganará quien itere más rápido, no quien regule más.

Fuente: No disponible

Deja una respuesta