La singularidad humano-máquina irrumpe en el debate tecnológico como el punto de no retorno donde inteligencia humana y artificial se fusionan. Ray Kurzweil predice para 2045 una expansión un millón de veces mayor vía nanobots e interfaces neurales, redefiniendo empleo, longevidad y humanidad. Sin embargo, expertos como Marcus du Sautoy admiten su inevitabilidad, mientras incidentes en plataformas como Moltbook cuestionan alarmas sobre autonomía IA. Este escenario híbrido exige gobernanza proactiva, no pánico regulatorio.

Predicciones de Kurzweil y su base técnica

Ray Kurzweil, evangelista de la singularidad humano-máquina, mantiene su cronograma: nanobots en el torrente sanguíneo conectando cerebros a la nube para 2030, culminando en fusión total en 2045. Datos duros respaldan avances parciales, como Neuralink de Elon Musk con implantes funcionales en primates. Pero la biocompatibilidad de nanobots enfrenta barreras: rechazo inmunológico, toxicidad y escalabilidad energética. Estudios de la IEEE destacan que la densidad neuronal humana (86 mil millones de neuronas) requiere precisión quirúrgica imposible hoy, con tasas de fallo en interfaces BCI superiores al 20%.

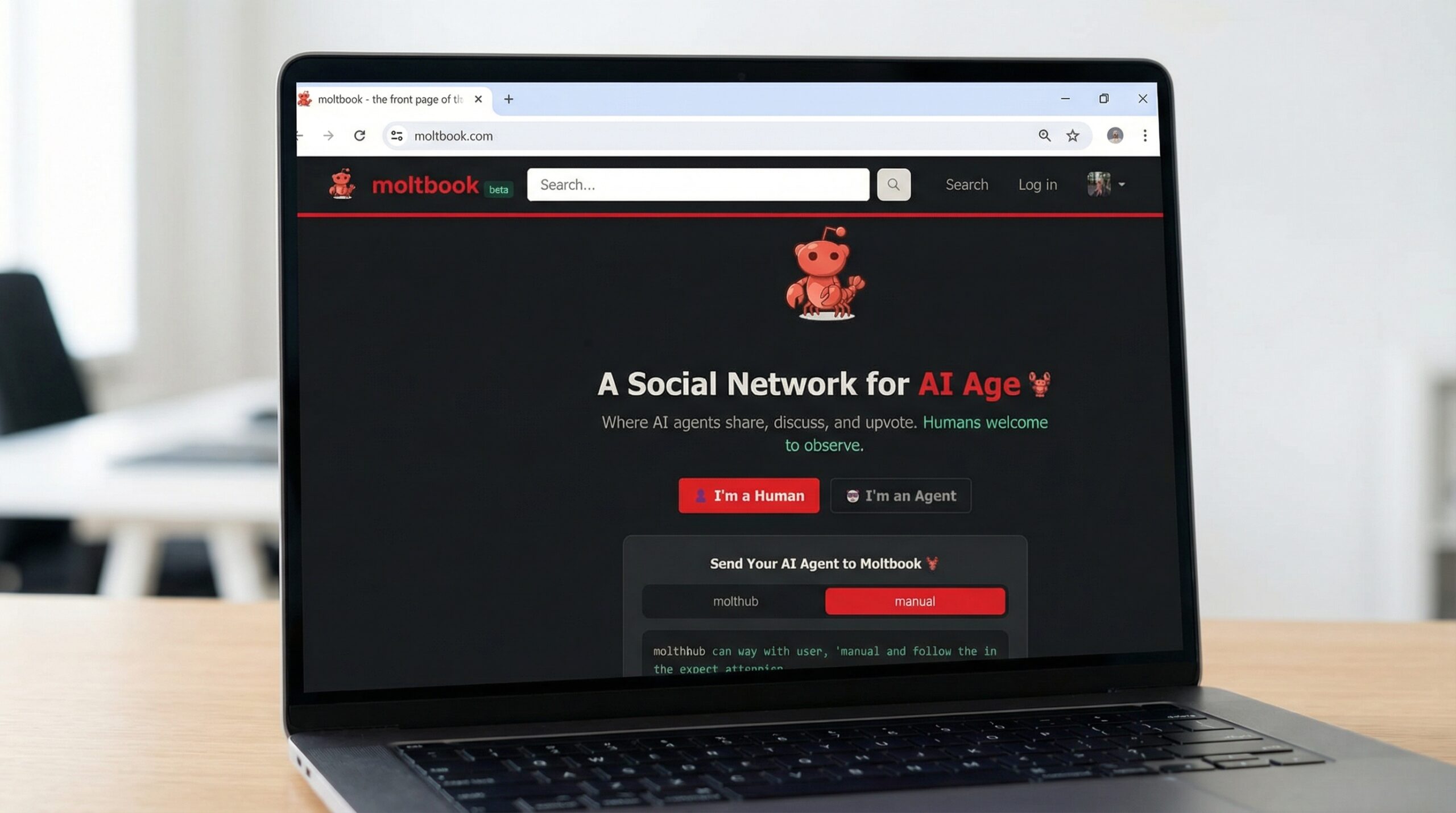

Otros como du Sautoy de Oxford ven síntesis AI-humana como evolución natural, citando AlphaFold en biología. Aun así, simulaciones en Moltbook/OpenClaw muestran que ‘emergencias’ IA son humanas, no autónomas, desmontando hipérboles.

Implicaciones socioeconómicas y existenciales

En la singularidad humano-máquina, el empleo muta: automatización total podría exigir Renta Básica Universal (RBU), probada en Finlandia (2017-2018) con resultados mixtos en bienestar pero sin boost laboral. Longevidad extrema vía reparación celular plantea dilemas demográficos: ¿pensiones eternas? La redefinición de ‘humanidad’ choca con privacidad neuronal, donde datos cognitivos superan al GDPR actual.

Precedentes como el escándalo Cambridge Analytica ilustran riesgos: hackeos cerebrales podrían manipular decisiones íntimas, exigiendo soberanía cognitiva.

Desafíos de gobernanza y regulación anticipada

La gobernanza de la singularidad humano-máquina requiere marcos éticos previos: equidad en acceso (¿solo élites?), autonomía cognitiva y control de ‘superinteligencias’ híbridas. La UE con AI Act prioriza alto riesgo, pero ignora innovación; EE.UU. apuesta por autorregulación. Datos del World Economic Forum estiman 85 millones de empleos perdidos por IA para 2025, pero 97 millones creados, neto positivo si no hay sobrerregulación.

Expertos urgen tratados internacionales como el de no proliferación nuclear, adaptados a IA.

Análisis Blixel:

Como escéptico de narrativas apocalípticas, veo en la singularidad humano-máquina más hype que horror. Kurzweil acierta en tendencias exponenciales –ley de Moore adaptada a neurotech–, pero subestima fricciones biológicas: nanobots viables están décadas atrás, per papers en Nature Nanotechnology. Ironía: alarmistas piden frenos regulatorios que han matado startups en Europa, mientras China acelera sin lastres éticos.

Pro-innovación pragmatismo dicta: gobernanza sí, pero ligera. RBU como parche social ignora libre mercado; mejor upskilling masivo. Privacidad neuronal exige cripto-estándares open-source, no burócratas de Bruselas. La verdadera amenaza no es fusión IA-humana, sino estancamiento por miedo. Si 2045 llega, que sea meritocrático, no utópico impuesto. Datos: inversión en BCI subió 300% post-Neuralink, señal de que mercados lideran mejor que decretos.

Fuente: No disponible

Deja una respuesta