La ejecución de modelos de IA ha evolucionado rápidamente, pero la gestión de memoria sigue siendo un cuello de botella crítico. Ejecutar modelos IA con capacidad de «recordar» entre sesiones es el siguiente gran desafío. A pesar de los avances en los ‘context windows’ que permiten a los modelos procesar grandes volúmenes de información en una única interacción, la persistencia de la memoria a largo plazo, de una sesión a otra, ha sido una limitación significativa. Esto impacta directamente la eficiencia y la utilidad de asistentes IA en entornos empresariales, donde el contexto continuo es fundamental.

Aquí es donde soluciones como Supermemory están marcando la diferencia. Desarrollada por Dhravya Shah, esta API actúa como una capa de memoria universal, diseñada para dotar a las aplicaciones de IA de una capacidad de ‘recuerdo’ duradera y contextual. En lugar de procesar cada interacción como una nueva, Supermemory extrae conocimientos clave de datos no estructurados —desde chats hasta PDFs y flujos de apps— y construye un grafo de conocimiento. Este grafo permite a la IA acceder a información relevante y personalizada, incluso si la consulta se refiere a datos de meses atrás.

Supermemory: Una nueva era para ejecutar agentes IA persistentes

La propuesta de valor de Supermemory es clara: reducir la latencia y ofrecer una memoria contextual que los LLMs tradicionales no pueden proporcionar por sí solos. Su capacidad para manejar entradas multimodales y su integración con herramientas de uso común como Google Drive o Notion, la posicionan como una herramienta robusta para diversas aplicaciones. Desde asistentes de correo electrónico hasta editores de vídeo y robots que requieren retención visual, la necesidad de ejecutar modelos IA con este nivel de persistencia es innegable. Ya cuenta con el respaldo de capital de riesgo e inversores de alto perfil de gigantes tecnológicos como Google AI y OpenAI, lo que valida su potencial.

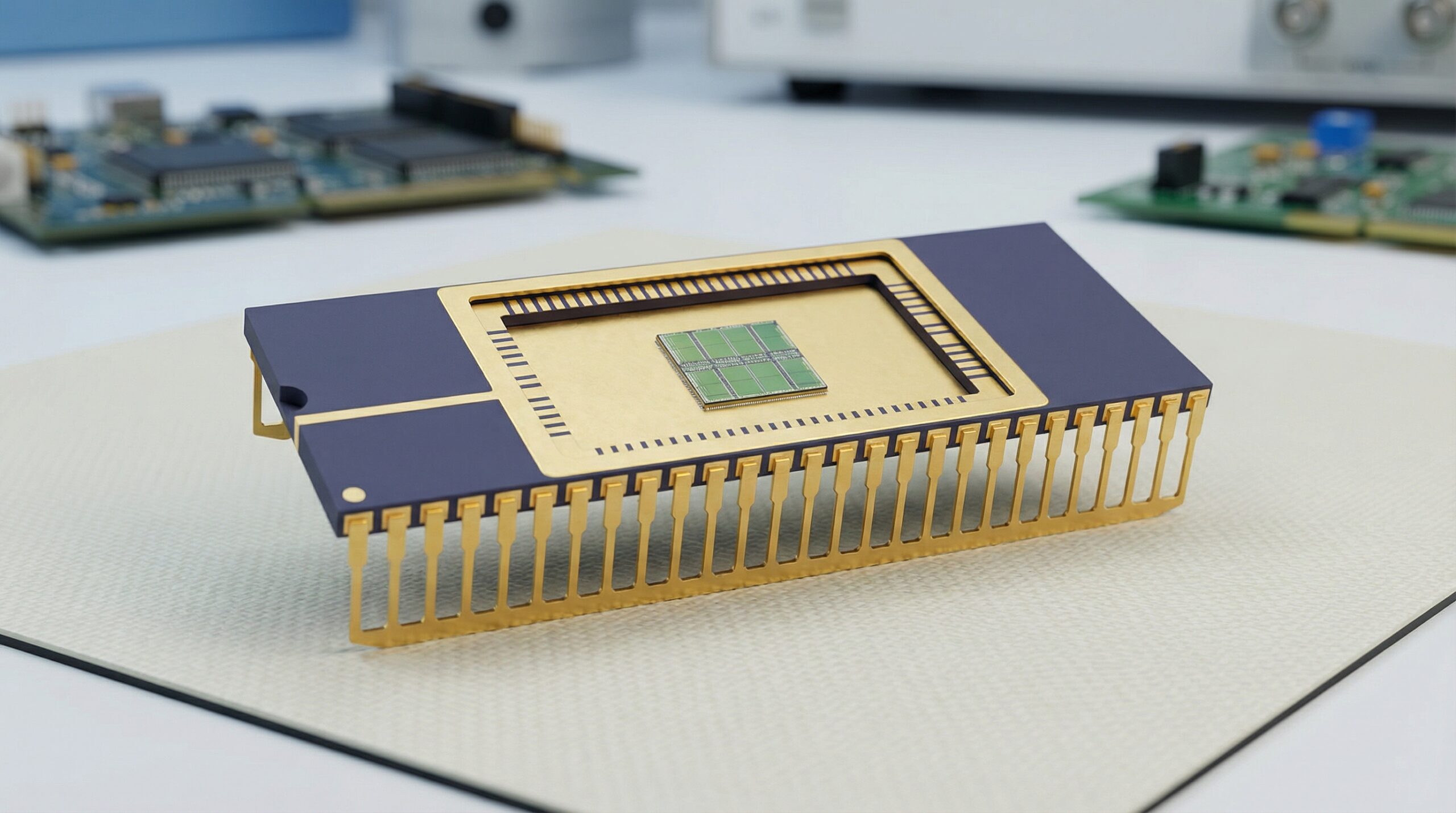

Esto se alinea con una tendencia más amplia en la industria: la búsqueda de eficiencia de datos y hardware especializado para inferencia. Mientras los equipos como Flapping Airplanes exploran modelos 1000 veces más eficientes en datos, inspirados en el cerebro humano, empresas como Positron desarrollan chips como Atlas o Asimov, diseñados para una inferencia eficiente, en contraste con el hardware más generalista como el Nvidia H100. Estos esfuerzos convergentemente buscan optimizar la capacidad de los sistemas para no solo procesar, sino también «aprender» y «recordar» de manera más inteligente, un paso crucial para la IA aplicada y los agentes autónomos.

Análisis Blixel: Implicaciones para su PYME

La llegada de soluciones como Supermemory no es ciencia ficción; es una herramienta práctica para mejorar la eficiencia operativa. Como PYME, si depende de agentes de IA para atención al cliente, gestión de proyectos o análisis de datos, la capacidad de estos agentes para «recordar» el contexto de interacciones previas es un game-changer. Imagine un chatbot que no solo responde preguntas, sino que comprende el historial completo de su cliente a lo largo de meses, ofreciendo una experiencia totalmente personalizada.

Nuestra recomendación es clara: evalúe cómo una capa de memoria persistente podría potenciar sus aplicaciones de IA actuales. Integrar una API como Supermemory puede reducir significativamente los costes de contexto en la ejecución de LLMs, mejorar la calidad de respuesta de sus agentes y, en última instancia, optimizar la experiencia de usuario. Estar al tanto de estas innovaciones le permitirá no solo competir, sino liderar en su nicho, aprovechando al máximo el valor de ejecutar modelos IA con una inteligencia más completa y contextual.

Fuente: TechCrunch