Workstations IA llave en mano para tu equipo

Desde el desarrollo de prototipos hasta la inferencia de modelos de hasta 1 trillón de parámetros. Workstations basadas en GPU NVIDIA Grace Blackwell, configuradas, instaladas y mantenidas por Blixel AI. Sin depender del cloud.

Dos tiers según tu caso de uso.

No todas las empresas necesitan la misma potencia. Te ayudamos a elegir el tier adecuado según el tamaño de tus modelos, el volumen de inferencia y el presupuesto disponible.

Workstation IA Entry

Pensada para developers, ingenieros de ML y prototipado rápido. Ideal para equipos que están empezando con modelos locales.

- GPU: NVIDIA Grace Blackwell · 20-core ARM

- Memoria unificada: 128 GB LPDDR5X

- AI performance: 1 petaFLOP FP4

- Modelos: hasta 200B parámetros (fine-tuning)

- Networking: ConnectX-7 (200 Gbps) + 10 GbE

- Almacenamiento: 1-4 TB NVMe

- Form factor: Mini desktop (1,5 kg)

- Refrigeración: Aire (silenciosa)

Workstation IA Pro

Para producción real, fine-tuning de modelos enterprise e inferencia distribuida. Equivale a un mini data center sobre tu mesa.

- GPU: NVIDIA Grace Blackwell Ultra · 72-core ARM

- Memoria unificada: 748 GB (496 GB CPU + 252 GB HBM3e)

- AI performance: 20 petaFLOPS FP4

- Modelos: hasta 1 trillón de parámetros

- Networking: ConnectX-8 SuperNIC (800 Gbps)

- Almacenamiento: NVMe configurable hasta 30 TB

- Form factor: Workstation deskside

- Refrigeración: Líquida (silenciosa)

Cuando el cloud no es la respuesta.

Hay casos donde una workstation local supera al cloud en coste, latencia y privacidad. Estas son las razones más habituales por las que nuestros clientes eligen on-premise.

Privacidad total

Tus datos no salen de la oficina. Cumplimiento RGPD garantizado, ideal para sectores regulados como salud, legal o finanzas.

Latencia cero

Inferencia local sin dependencia de internet. Respuestas en milisegundos, perfecto para aplicaciones en tiempo real.

Coste predecible

Inversión única, sin facturas mensuales por uso de GPU. Amortización clara y control absoluto del coste total de propiedad.

Control de soberanía

Sin vendor lock-in. Los modelos, datos y configuraciones son tuyos. Puedes auditar, modificar y migrar cuando quieras.

Para qué se utilizan las workstations IA.

Estos son los escenarios donde tener GPU local marca la diferencia frente al cloud o a soluciones más generalistas.

Tier Entry vs Tier Pro de un vistazo.

Para que veas claramente qué ofrece cada configuración y elijas la que mejor encaja con tu caso.

| Característica | Tier Entry | Tier Pro |

|---|---|---|

| Arquitectura GPU | NVIDIA Grace Blackwell | NVIDIA Grace Blackwell Ultra |

| CPU | 20-core ARM | 72-core ARM |

| Memoria unificada | 128 GB LPDDR5X | 748 GB (496 GB + 252 GB HBM3e) |

| AI Performance (FP4) | 1 petaFLOP | 20 petaFLOPS |

| Tamaño máx. modelo | 200B parámetros | 1 trillón parámetros |

| Networking | ConnectX-7 (200 Gbps) | ConnectX-8 (800 Gbps) |

| Refrigeración | Aire | Líquida |

| Caso de uso ideal | Desarrollo · Prototipado | Producción · Fine-tuning enterprise |

| Software | NVIDIA AI Enterprise · CUDA · NeMo · Triton · TensorRT-LLM (incluido en ambos) | |

Qué incluye nuestra implementación.

No vendemos solo hardware. Cada workstation viene con servicio completo de implementación y soporte técnico continuo por parte del equipo de Blixel AI.

Auditoría previa

Análisis de tus casos de uso para recomendar el tier exacto. Sin sobredimensionar ni quedarse cortos.

Configuración llave en mano

Sistema operativo, drivers, frameworks de IA y modelos preinstalados. Llega operativa, lista para usar.

Formación a tu equipo

Sesiones prácticas para que tu equipo aprenda a usar la workstation y los modelos desde el primer día.

Soporte continuo

Mantenimiento, actualizaciones de modelos y soporte técnico mientras la uses. Sin coste sorpresa.

Si necesitas más capacidad o flexibilidad.

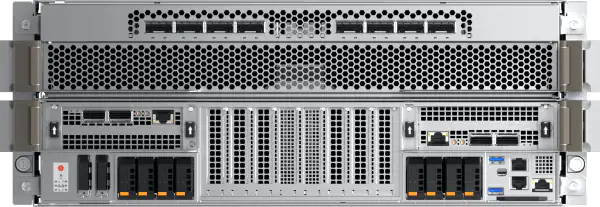

Servidores on-premise

Cuando una workstation no es suficiente y necesitas una infraestructura de varios servidores.

Ver on-premise →Modelos IA locales

Llama, Mistral, Phi y otros modelos open source que puedes desplegar en tu workstation.

Ver modelos →Seguridad y RGPD

Cómo garantizamos cumplimiento normativo y protección de datos en infraestructura local.

Ver seguridad →Sobre las workstations IA.

El tamaño de los modelos que puedes ejecutar. El Tier Entry es ideal para desarrollo y modelos hasta 200B parámetros. El Tier Pro tiene 20 veces más rendimiento (20 PFLOPS vs 1 PFLOP) y casi 6 veces más memoria, lo que permite trabajar con modelos de hasta 1 trillón de parámetros y entornos de producción reales.

El Tier Entry se conecta como un PC normal, no requiere infraestructura especial. El Tier Pro es refrigerado por líquido pero también plug-and-play, solo necesita una toma eléctrica estándar y una conexión de red. Nosotros nos encargamos de la configuración inicial.

Linux (Ubuntu o Rocky) preconfigurado con NVIDIA AI Enterprise, CUDA, NeMo, Triton, TensorRT-LLM y los frameworks principales (PyTorch, TensorFlow, Hugging Face). También dejamos preinstalados los modelos open source que necesite tu equipo.

Sí. El Tier Pro incluye networking ConnectX-8 de hasta 800 Gbps, lo que permite formar clusters pequeños de 2-4 workstations para entrenamiento distribuido. Si necesitas más capacidad, te recomendamos pasar a infraestructura on-premise tipo rack.

Depende del tier y la configuración exacta. En general, tras la auditoría inicial y confirmar la configuración, la entrega e instalación llave en mano se realiza en pocas semanas. Marta te concretará los plazos exactos en una llamada.

Depende del volumen. Si usas GPU cloud más de 4-6 horas al día, una workstation local se amortiza rápidamente y además te da privacidad total. Si tu uso es esporádico, el cloud puede salir más barato. En la videollamada calculamos contigo el punto de equilibrio según tu caso.

¿Qué workstation encaja con tu caso?

Agenda una videollamada gratuita de 30 minutos. Analizamos tus casos de uso, modelos y volumen previsto, y te recomendamos el tier exacto sin compromisos.