La automatización web con IA es una pieza clave para la eficiencia de muchas empresas, pero a menudo tropezamos con barreras técnicas o de escalabilidad. La buena noticia es que AWS ha dado un paso adelante significativo con el lanzamiento de Amazon Bedrock AgentCore Browser, una herramienta que busca simplificar este proceso y dotar a los agentes de IA de capacidades web avanzadas. Esta novedad no es un mero añadido; es una evolución que promete transformar cómo las pequeñas y medianas empresas interactúan con la web a través de la inteligencia artificial, eliminando la necesidad de gestionar infraestructura compleja y abriendo puertas a nuevas posibilidades de uso.

Amazon Bedrock AgentCore Browser: Más Allá de la Navegación Básica

Este nuevo componente introduce funcionalidades que antes eran un dolor de cabeza. Por ejemplo, las browser profiles permiten que los agentes reutilicen estados de autenticación —piensen en cookies o datos de localStorage— entre sesiones. Esto significa que un agente no tiene que iniciar sesión una y otra vez, ahorrando tiempo y mejorando la fluidez del trabajo. Además, soporta modos de solo lectura o persistentes, lo cual es ideal para el procesamiento paralelo de datos, o para tareas donde la sesión debe mantenerse activa y consistente en el tiempo. Sumen a esto el uso de proxies, que no solo facilitan el cumplimiento de normativas de geolocalización, sino que también permiten a los agentes operar desde diferentes ubicaciones geográficas.

Otra característica potente son las extensiones Chrome personalizadas. Esto no es ciencia ficción, sino capacidad real para que sus agentes realicen acciones complejas: desde autenticaciones personalizadas en sitios específicos hasta pruebas automatizadas de sitios web o la optimización de la navegación mediante bloqueadores de anuncios. Estas capacidades abren un abanico enorme para tareas de investigación automatizada, servicio al cliente especializado y recolección de datos a gran escala, sin la carga de gestionar la infraestructura subyacente.

Análisis Blixel: Aplicación Práctica para su Negocio

Desde Blixel, vemos en Amazon Bedrock AgentCore Browser una solución que muchas PYMES estaban esperando. La clave aquí es la descomplejización. No necesitan ser expertos en infraestructura para desplegar agentes que naveguen y extraigan información de la web de forma inteligente. La capacidad de ejecutar miles de sesiones concurrentes a través de contenedores aislados de Chrome headless, sin que ustedes tengan que preocuparse por el escalado de servidores o la gestión de navegadores, es un valor incalculable.

Las implicaciones son directas: si su negocio depende de la monitorización de competidores, la recolección de datos de mercado, la automatización de flujos de trabajo en CRMs web, o incluso la mejora del soporte al cliente mediante la búsqueda proactiva de información, esta herramienta puede ser un cambio de juego. La seguridad y observabilidad que ofrece AWS (IAM, CloudWatch, CloudTrail) garantiza que la información se gestione con los más altos estándares, algo crucial en un entorno empresarial. Es hora de pensar en cómo delegar tareas repetitivas y de investigación a agentes IA, liberando a su equipo para funciones de mayor valor estratégico.

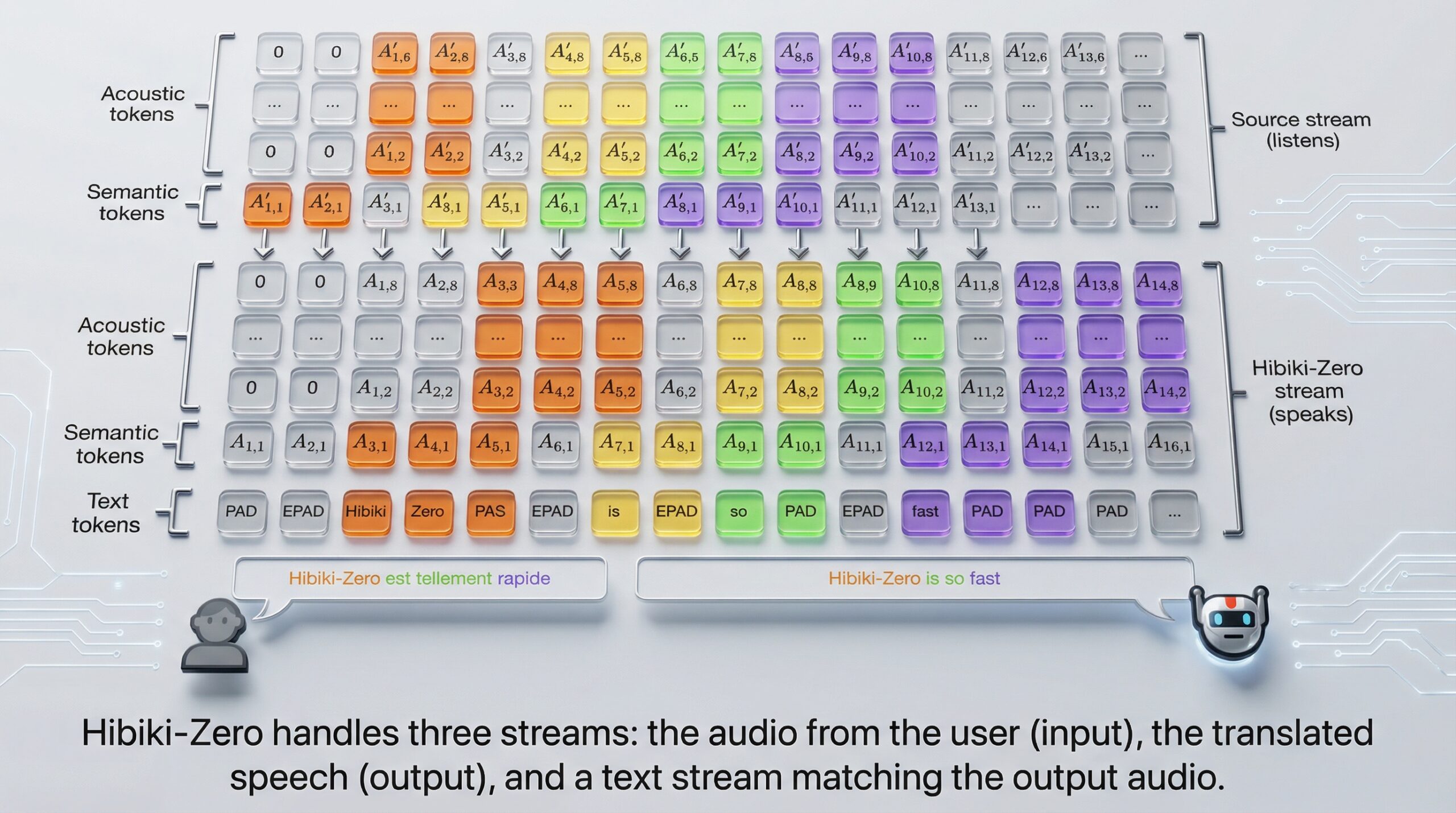

Técnicamente, el sistema opera con contenedores aislados, utilizando Chrome headless y APIs WebSocket para streaming en tiempo real y visualización en vivo de la interacción del agente. Esto no solo ofrece una observabilidad completa a través de la reproducción de sesiones en S3 y métricas en CloudWatch, sino que también garantiza la seguridad y el aislamiento de datos. Soporta una interacción dinámica y completa, incluyendo clics, formularios e incluso la capacidad de sortear CAPTCHAs y límites de velocidad, lo que lo hace robusto para escenarios del mundo real. La integración con AgentCore permite un descubrimiento semántico de herramientas y la ejecución serverless de sesiones que pueden durar hasta 8 horas, consolidando su promesa de eficiencia a gran escala [1][4].

Los diferenciales clave de esta oferta son claros: aislamiento para prevenir fugas de datos, retroalimentación visual post-acción para un debugging efectivo, y compatibilidad con librerías conocidas como Playwright. Disponible en 9 regiones AWS, este lanzamiento resuelve las limitaciones de los Modelos Fundacionales estáticos y los desafíos de escalabilidad de la automatización web tradicional, marcando un antes y un después en cómo las empresas, especialmente las PYMES, pueden aprovechar la IA para optimizar sus operaciones web. Este avance con Amazon Bedrock AgentCore Browser no solo es técnico, es una oportunidad real para democratizar el acceso a la automatización inteligente.

Fuente: AWS Machine Learning Blog