En el sector salud, la eficiencia operativa y la satisfacción del paciente son pilares fundamentales. Hoy, empresas como Clarus Care están redefiniendo cómo se logran estos objetivos. Utilizando la potencia de Amazon Bedrock, Clarus Care ha logrado transformar las interacciones conversacionales en los centros de contacto médicos, algo que era impensable hace unos años.

Esta plataforma de gestión de llamadas, impulsada por Inteligencia Artificial, no solo sustituye a los operadores humanos en ciertas tareas, sino que mejora significativamente la administración de mensajes de pacientes 24/7. El resultado directo es un aumento notable en la satisfacción del paciente, una experiencia optimizada para el personal médico de guardia y, lo que es crucial para cualquier negocio, una reducción sustancial de los costos operativos. Según datos de Clarus, su tecnología maneja miles de llamadas anualmente en múltiples especialidades, con una tasa de retención del 100% entre sus usuarios.

Clarus Care: Redefiniendo la Comunicación Médica con IA

La integración con Amazon Bedrock no es un detalle menor; permite que Clarus Care ofrezca conversaciones increíblemente naturales y contextuales, adaptándose a las diversas estructuras organizativas del sector salud. Es decir, que no importa el tamaño o la complejidad de su centro médico, la IA de Clarus se adapta. Esta capacidad ha demostrado ser vital para simplificar la comunicación fuera del horario laboral, ahorrando cientos de horas a los médicos y, lo más impactante, reduciendo errores en un 50% en comparación con proveedores anteriores. Un dato que nos lleva a reflexionar: un análisis propio reciente reveló que el 25% de las llamadas de pacientes en sistemas de Miami no obtienen respuesta, una brecha que Clarus Care busca cerrar con esta tecnología.

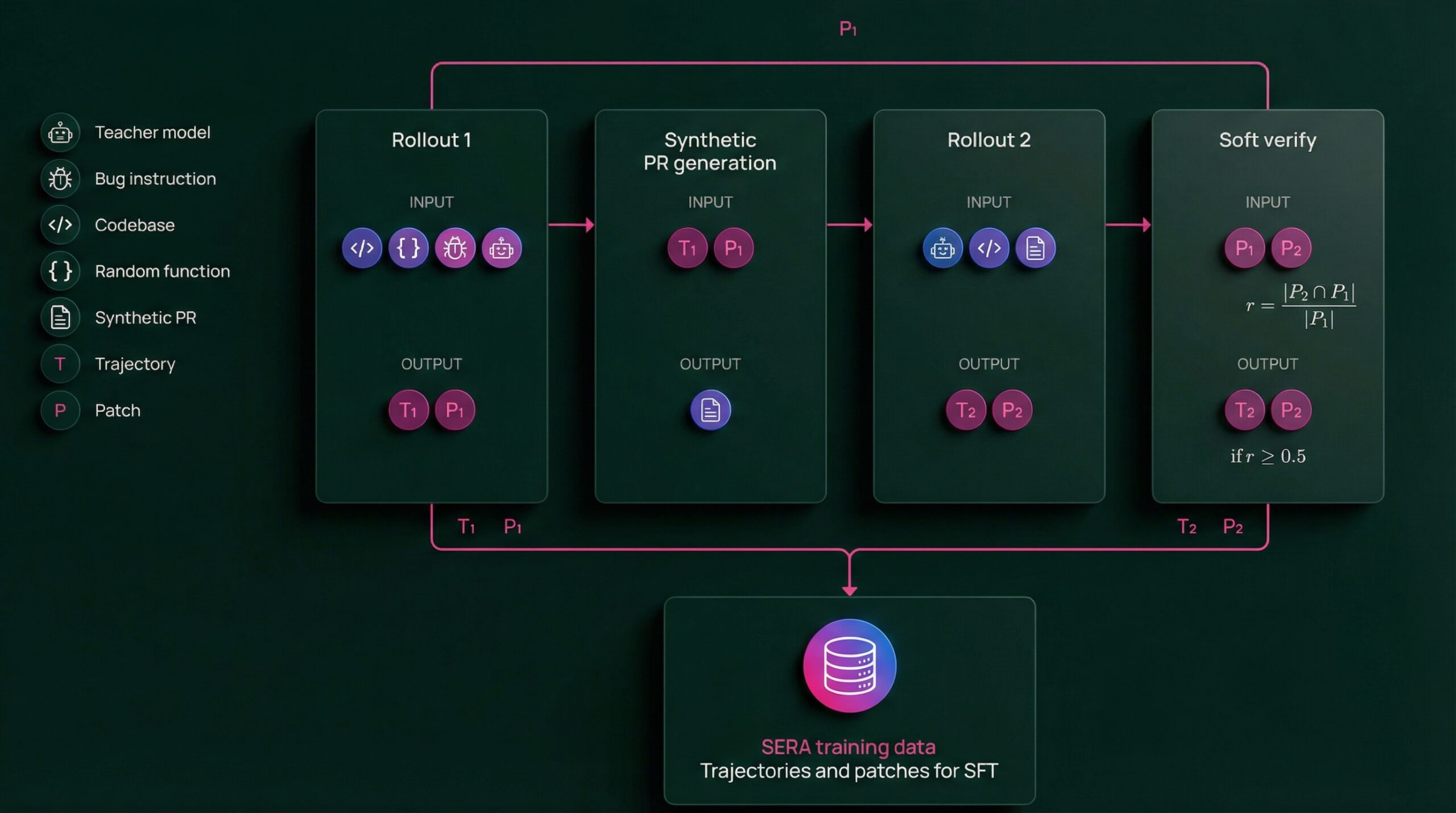

Desde el punto de vista técnico, Amazon Bedrock es la clave. Proporciona acceso a modelos fundacionales avanzados, como Claude de Anthropic, lo que facilita evaluaciones inteligentes y transcripciones precisas con herramientas como Amazon Connect Contact Lens. Además, su procesamiento en batch asegura escalabilidad sin necesidad de desarrollar ETL (Extract, Transform, Load) personalizados. Esto significa que miles de interacciones diarias pueden ser procesadas de manera eficiente, incluyendo la redacción de información de identificación personal (PII), la diarización de hablantes y el análisis de sentimiento. La arquitectura integra soporte de IA/ML para múltiples centros, lo que no solo unifica el stack tecnológico con soluciones como Amazon Transcribe y Bedrock Agents, sino que también reduce los costos operativos de manera significativa.

Análisis Blixel: Más Allá de la Noticia para su Empresa

Como Sofía Navarro, mi perspectiva en Blixel es siempre ‘qué significa esto para usted, empresario’. La noticia de Clarus Care y Amazon Bedrock no es solo un caso de éxito técnico; es una hoja de ruta. Los beneficios son palpables: estamos hablando de una eficiencia operativa que permite una cobertura de control de calidad 20 veces mayor en escenarios similares. Esto libera recursos humanos, que pueden dedicarse a tareas de mayor valor. Más allá de eso, la IA ofrece insights en tiempo real para mejorar el entrenamiento de su personal y asegurar el cumplimiento normativo, algo crítico en el entorno sanitario.

Lo que nos enseña Clarus Care con Amazon Bedrock es que la IA aplicada no es una promesa futurista, sino una herramienta actual para transformar sus centros de contacto en soluciones proactivas. Si su pyme opera en el sector salud o similar, considere cómo una IA de estas características podría capturar esas oportunidades de interacción perdidas y, en última instancia, mejorar drásticamente su servicio al cliente y su cuenta de resultados. No se trata de reemplazar personas, sino de empoderarlas con herramientas que hagan su trabajo más eficiente y efectivo.

Fuente: Amazon Web Services Blog