Desde el 5 de febrero de 2026, Reddit está posicionando la búsqueda con IA como su próxima gran oportunidad estratégica. La plataforma, conocida por su vasto contenido generado por usuarios y comunidades activas, está capitalizando su rol esencial en los resultados de motores de búsqueda impulsados por IA como ChatGPT, Gemini y Perplexity. No es un secreto que Google ya integra hilos de Reddit de forma destacada, convirtiéndola en una fuente primaria de información para el entrenamiento de modelos y las respuestas generadas por IA.

Reddit y su apuesta por la búsqueda con IA para empresas

Esta no es solo una declaración ambiciosa; es una estrategia bien definida. Técnicamente, Reddit aprovecha su inmenso repositorio de conversaciones auténticas y moderadas por usuarios. Hablamos de un dataset de valor incalculable para el entrenamiento de Grandes Modelos de Lenguaje (LLMs). Han desarrollado un producto de búsqueda nativo con una interfaz conversacional, diseñada para facilitar el descubrimiento dentro de su ecosistema.

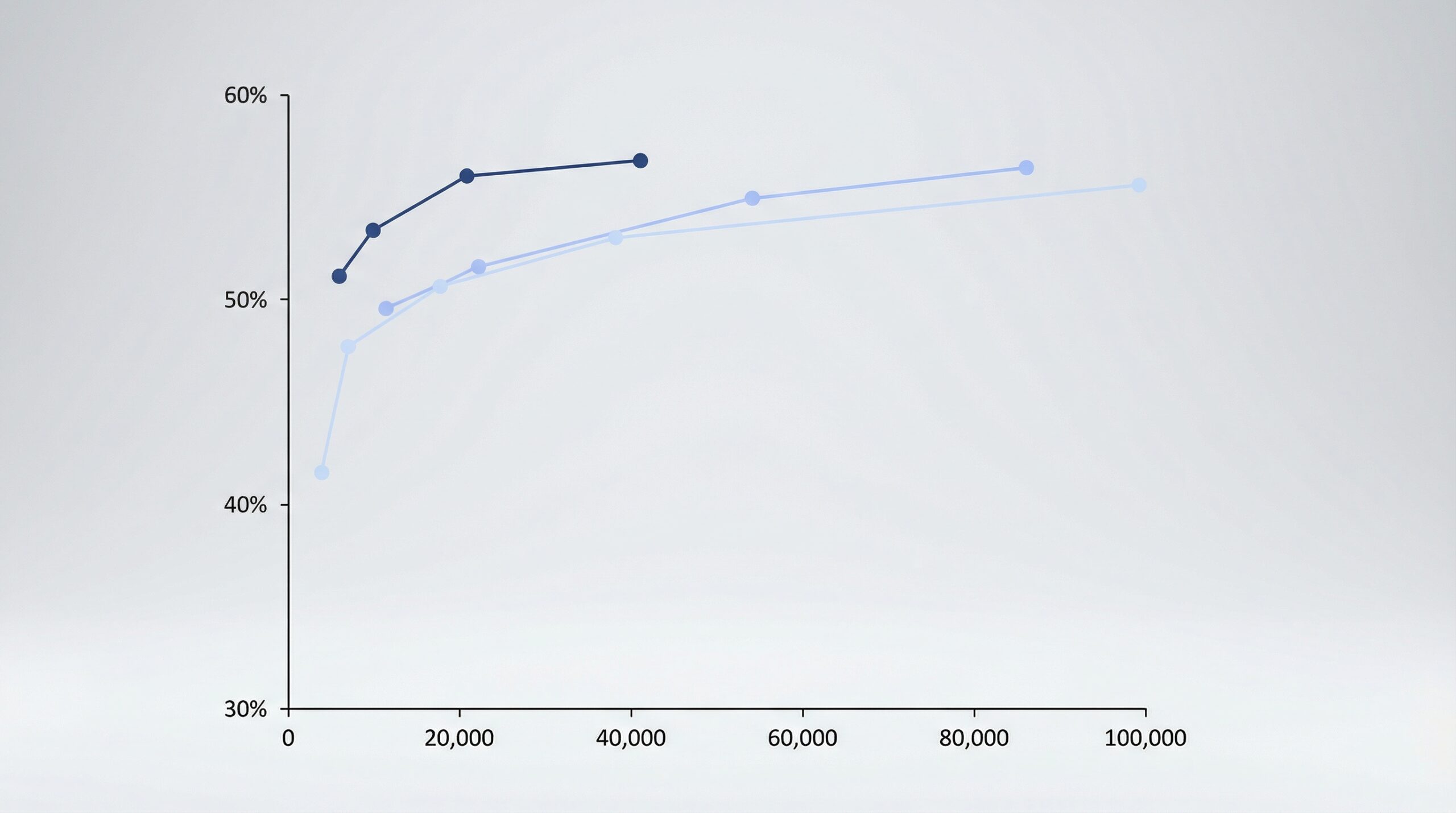

Para las empresas, esto abre una puerta interesante. La escalabilidad y el rendimiento publicitario son clave, y Reddit está optimizando sus campañas con IA para priorizar la facilidad de uso y métricas de desempeño claras. Además, están explorando integrar comercio social y formatos shopper-friendly, transformando la curiosidad en ventas mediante el descubrimiento impulsado por IA, siempre respetando las dinámicas comunitarias. Aunque la reducción potencial del tráfico de referencia por los AI Overviews de Google es un desafío, Reddit lo contrarresta con licencias de datos a empresas de IA y un énfasis en las conversaciones humanas en tiempo real.

Análisis Blixel: Más allá del titular, ¿qué significa para mi negocio esta próxima gran oportunidad de Reddit?

Aquí la clave no es solo que Reddit esté mirando la IA, sino cómo tu empresa puede aprovechar su estrategia. Olvídate de las tácticas de marketing tradicionales que no funcionan en Reddit. La plataforma quiere ser un destino de búsqueda conversacional y comercio con IA. Esto implica que tu presencia no debe ser de ‘venta dura’, sino de valor.

Si tu sector puede beneficiarse de las conversaciones humanas y la autenticidad, Reddit ofrece una ventana única. Piensa en minar los puntos débiles (pain points) de los usuarios a través de sus discusiones, o incluso en hacer ingeniería inversa de las consultas de los LLMs para crear interacciones realmente relevantes. Las marcas que participen orgánicamente, aportando valor a las comunidades, serán las que ganen. Herramientas como Surfer AI Tracker ayudan a medir KPIs en canales de búsqueda con IA, permitiéndote ajustar tu estrategia de forma efectiva. No subestimes el potencial de una presencia bien gestionada en este nuevo paradigma.

En definitiva, la convergencia de Reddit con la inteligencia artificial no es solo una evolución, es una reinvención. La plataforma se posiciona no solo como una fuente de datos, sino como el futuro destino principal para la búsqueda conversacional y el comercio impulsado por IA, lo que representa una búsqueda con IA como su próxima gran oportunidad evidente para todos los implicados.

Fuente: TechCrunch