La mejora de la inteligencia artificial, especialmente en los modelos de lenguaje grandes (LLMs), es una prioridad para cualquier empresa que quiera mantenerse competitiva. Recientemente, un paper de arXiv ha presentado un marco innovador que podría ser un antes y un después: cómo Bytedance AI está trabajando para estabilizar el razonamiento Chain-of-Thought (CoT) largo. Este avance es crucial porque aborda uno de los mayores desafíos actuales de los LLMs: la inconsistencia en su capacidad para mantener cadenas de pensamiento lógicas y complejas.

Bytedance AI y la Metáfora Molecular en CoT

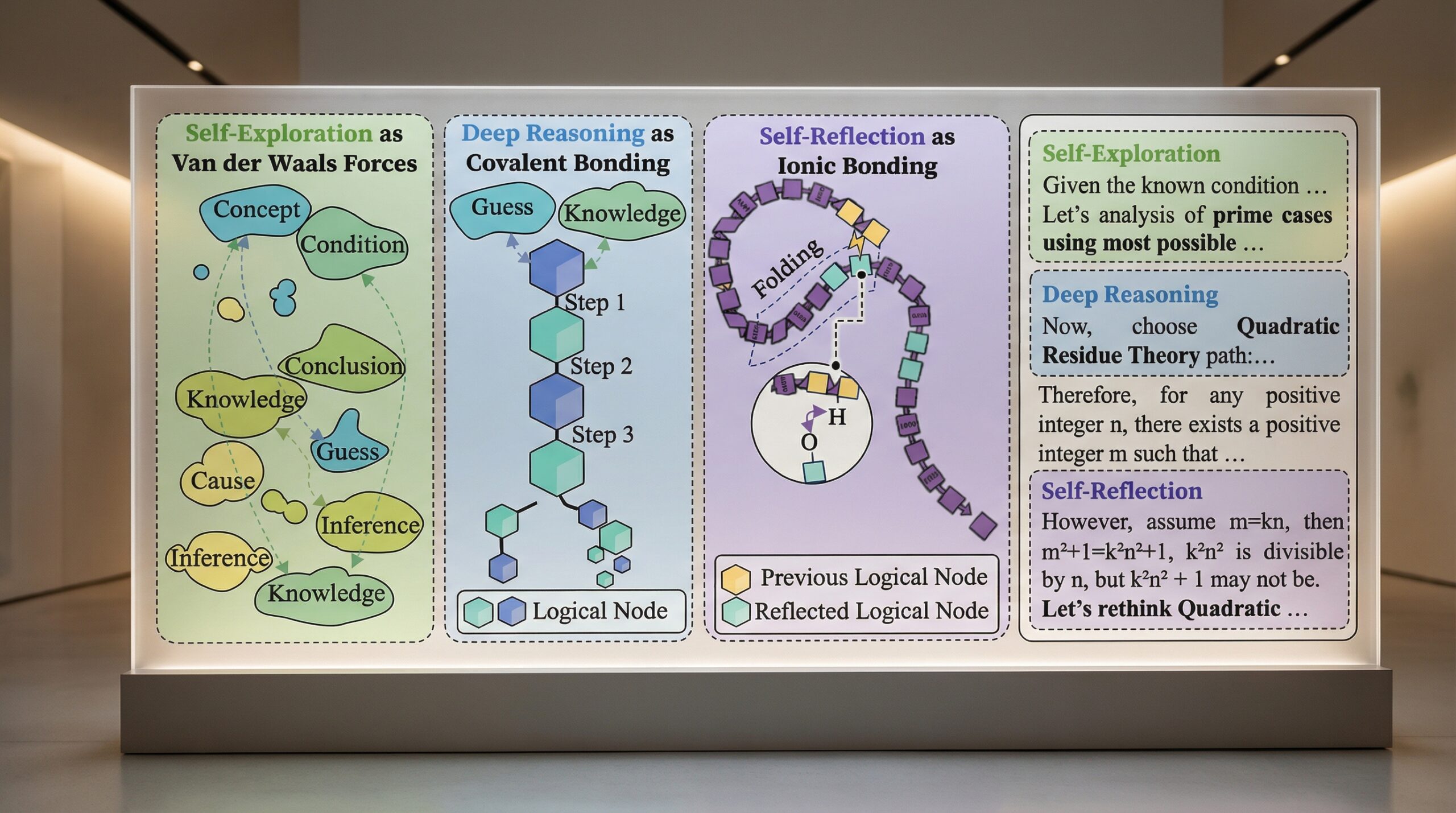

La propuesta de Bytedance conceptualiza el razonamiento CoT largo como estructuras moleculares emergentes. Han identificado tres tipos de ‘enlaces’ que dan forma a este proceso: los enlaces covalentes, que representan el ‘deep-reasoning’ y forman clústeres densos de deducciones; los enlaces de hidrógeno, que actúan como mecanismos de ‘self-reflection’, conectando y corrigiendo pasos previos; y las fuerzas de van der Waals, que son ‘self-exploration’, para puentes débiles entre segmentos de razonamiento distantes. Entender cómo Bytedance AI estructura estas interacciones es clave para modelos más robustos.

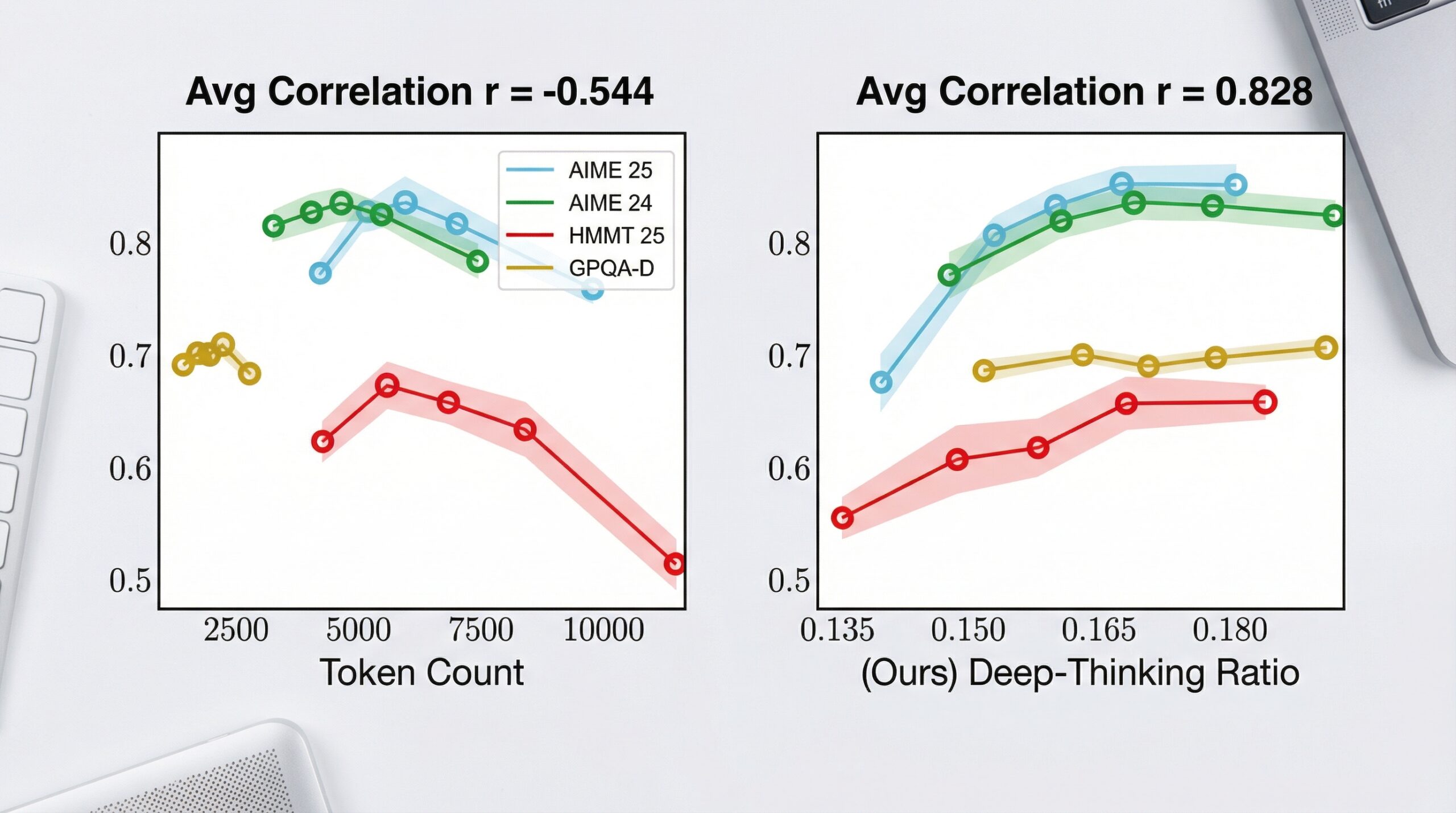

Este enfoque permite comprender por qué ciertos patrones de razonamiento son más estables que otros. Los análisis de Bytedance revelan que estas estructuras moleculares no son simplemente una imitación superficial de palabras clave, sino que emergen del fine-tuning del CoT largo. Han introducido el concepto de ‘isómeros semánticos efectivos’, demostrando que solo aquellos ‘enlaces’ que promueven una rápida convergencia de entropía son los que realmente soportan un aprendizaje estable de CoT largo. En cambio, la competencia estructural es perjudicial para el entrenamiento del modelo. ¿El dato crucial? Han verificado la estabilidad con correlaciones Pearson superiores a 0.95 en más de 2000 muestras, usando múltiples LLMs y tareas. Esto no es teoría, son datos.

Análisis Blixel: Más allá de la teoría, implicaciones prácticas para PYMEs

Para su negocio, este avance significa modelos de IA más fiables. Si sus LLMs pueden mantener un razonamiento complejo de manera consistente, las aplicaciones se vuelven mucho más potentes: desde asistentes virtuales que gestionan consultas complicadas hasta sistemas de soporte a la decisión que procesan grandes volúmenes de información contextual. La estabilidad que busca Bytedance AI con este método reduce ‘alucinaciones’ y errores en la lógica de los modelos, algo vital en entornos tan críticos como servicio al cliente, análisis financiero o automatización de procesos complicados. Es decir, sus asistentes de IA serán más inteligentes y menos propensos a equivocaciones costosas.

El método ‘Mole-Syn’ desarrollado por Bytedance, una aproximación basada en gráficos de transferencia de distribución, ofrece un camino para sintetizar estructuras CoT efectivas. Esto se traduce en una mejora en la estabilidad operativa de los LLMs, aspecto fundamental para el despliegue en entornos empresariales donde la consistencia es clave. Si bien es una investigación avanzada, el mensaje es claro: la fiabilidad y coherencia de las respuestas de la IA está mejorando a pasos agigantados. Para las PYMEs, esto significa que la inversión en soluciones basadas en LLMs será menos riesgosa y con un retorno más predecible.

Las funciones de los enlaces moleculares son claras: el ‘deep-reasoning’ codifica el flujo lógico central (72.56% de los pasos a una distancia semántica menor de 3), el ‘self-reflection’ estabiliza la lógica global y el ‘self-exploration’ expande el espacio lógico. Esto explica por qué las estructuras ya deterioradas son difíciles de restaurar, protegiendo a los LLMs privados de la imitación vía destilación. Esta protección es una ventaja añadida en un mundo donde la propiedad intelectual y la seguridad de los modelos son cada vez más importantes. En resumen, Bytedance AI no solo mejora la capacidad de razonamiento, sino que también ofrece un camino hacia modelos más seguros y estables. El futuro de los LLMs se está construyendo sobre bases moleculares más sólidas.

Fuente: Marktechpost