El gobierno australiano ha optado por un enfoque pragmático: Australia regula IA leyes existentes en lugar de imponer una normativa específica y rígida. Bajo el National AI Plan 2026, se descartan las guardrails obligatorias para IA de alto riesgo, priorizando marcos como la Privacy Act, Australian Consumer Law y Copyright Act. Este giro llega en un momento clave, con requisitos de transparencia en toma de decisiones automatizada (ADM) que entran en vigor en diciembre de 2026, exigiendo controles técnicos inmediatos a las organizaciones.

Contexto del National AI Plan 2026

Australia regula IA leyes existentes para mantener flexibilidad regulatoria, evitando el modelo de leyes ad hoc que ha complicado la innovación en Europa. El plan confirma que no habrá legislación específica, sino adaptación de normas vigentes. Esto responde a consultas públicas donde la industria advirtió sobre riesgos de sobrerregulación. En cambio, se enfoca en obligaciones concretas: desde diciembre 2026, las entidades que usen IA en decisiones con datos personales deben implementar cinco controles: registro auditable de decisiones, mecanismos de explicabilidad, revisión humana, notificaciones transparentes y gestión de consentimiento. La OAIC ya inició en enero 2026 un compliance sweep en sectores clave, con multas de hasta AUD 66.000 por incumplimiento.

Este enfoque contrasta con la UE, donde el AI Act impone categorías de riesgo estrictas. Australia busca equilibrar protección sin ahogar startups, un alivio para un mercado con 1.500 empresas de IA según datos del gobierno.

Requisitos técnicos en toma de decisiones automatizada

Australia regula IA leyes existentes destacando la Privacy Act actualizada. Los cinco controles obligatorios no son opcionales: las organizaciones procesando datos sensibles vía IA enfrentan auditorías rigurosas. Por ejemplo, el registro de decisiones debe ser auditable, permitiendo rastreo de sesgos o errores. La explicabilidad exige modelos interpretables, un desafío para black-box como algunos LLMs. La revisión humana y transparencia notifican al usuario sobre IA involucrada, fortaleciendo confianza sin prohibiciones totales.

La OAIC, con su sweep inicial, ya revisa políticas en finanzas y salud, donde ADM es común. Sanciones escalan a AUD 66.000 por violación, incentivando cumplimiento proactivo.

Ausencia de excepción TDM en Copyright Act

Un punto controvertido: Australia regula IA leyes existentes sin introducir una excepción para text-and-data mining (TDM). Entrenar modelos requiere licencias para datos protegidos por copyright, alineándose con posturas conservadoras. Esto beneficia a titulares de derechos pero frena innovación abierta, similar a Japón o Singapur que sí permiten TDM amplio. Críticos argumentan que eleva barreras de entrada para pymes australianas frente a gigantes como OpenAI.

El gobierno prioriza incentivos a licencias voluntarias, pero sin claridad, podría derivar en litigios costosos.

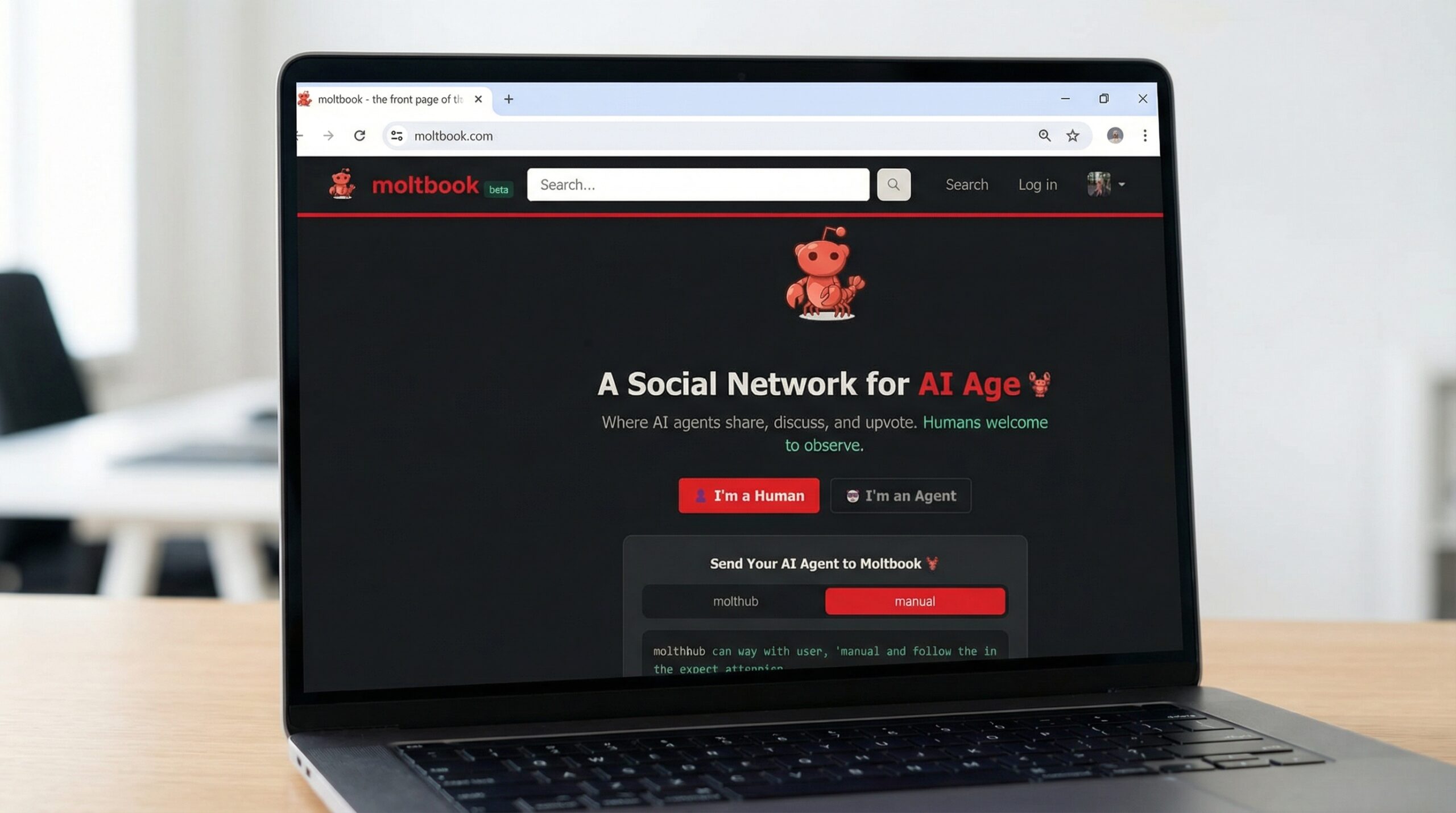

Creación del Australian AI Safety Institute

Con AUD 29,9 millones, el instituto evaluará riesgos upstream en diseño de IA y downstream en impactos reales. No es un regulador punitivo, sino un asesor para estándares voluntarios inicialmente. Esto posiciona a Australia como hub asiático de IA segura, atrayendo inversión sin cargas excesivas.

Reacciones mixtas: industria aplaude flexibilidad, ONGs piden más dientes contra deepfakes.

Análisis Blixel:

Como escéptico de la sobrerregulación, aplaudo que Australia regula IA leyes existentes: evita el laberinto burocrático del AI Act europeo, donde startups tardan meses en clasificar riesgos. Usar Privacy Act y similares mantiene agilidad, crucial en un sector donde la velocidad gana. Los controles ADM son razonables –transparencia sin veto a la innovación–, y el instituto de AUD 30 millones parece un faro pragmático, no un policía estatal. Sin embargo, la rigidez en TDM huele a proteccionismo disfrazado: sin excepciones, Australia arriesga quedarse atrás de hubs como EE.UU. o Corea, donde datos fluyen libremente. Ironía: mientras Bruselas sueña con ‘IA ética’ que paraliza, Canberra apuesta por evolución orgánica. Riesgo latente: si OAIC endurece sweeps, las multas podrían mutar en control indirecto. Perspectiva: modelo exportable para países emergentes, priorizando innovación sobre utopías reguladoras. Datos duros respaldan: IA australiana creció 20% anual pre-plan, según CSIRO. Bien jugado, pero vigilemos el consentimiento forzado no mate la experimentación.