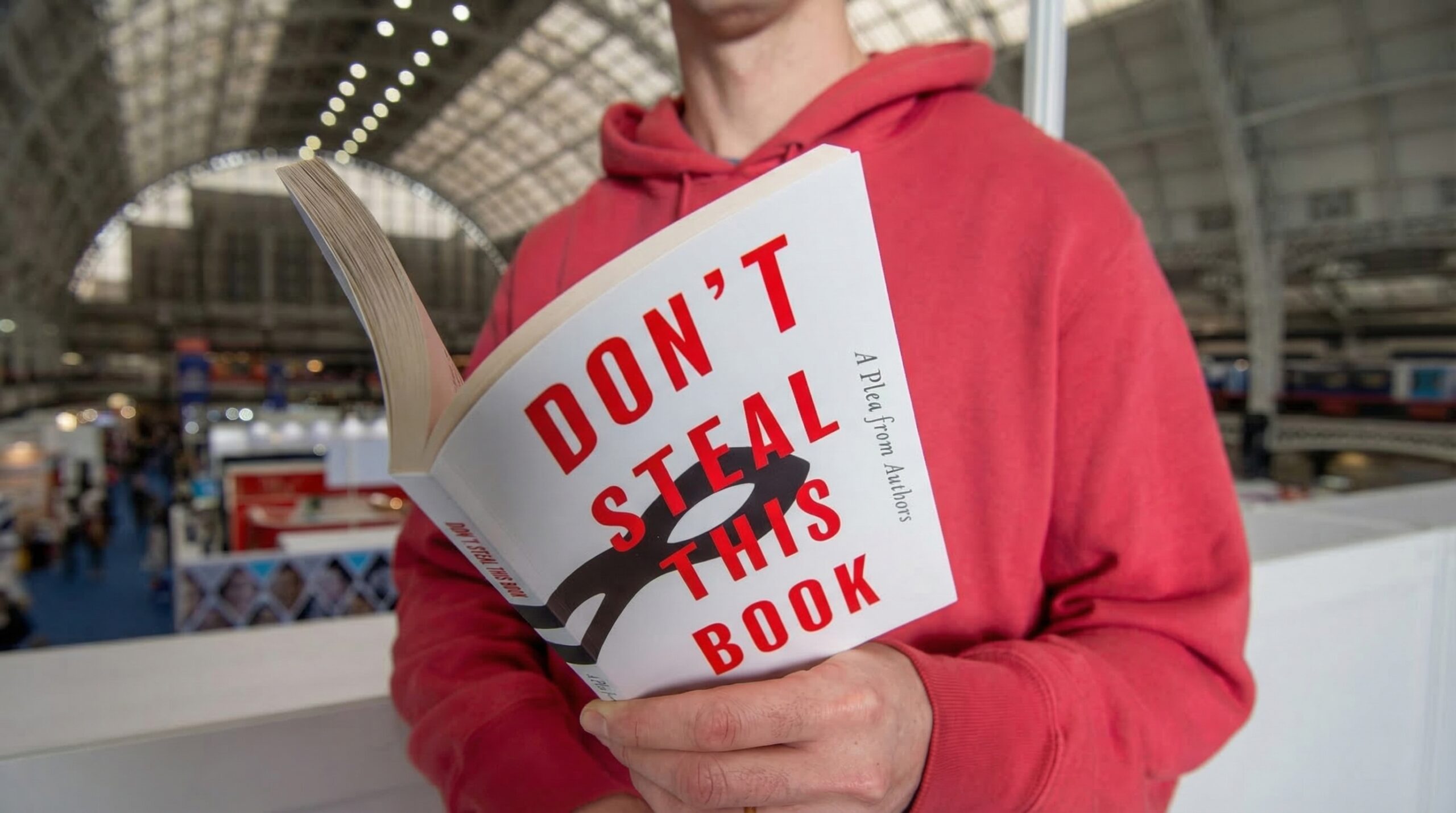

La logo Society of Authors libros humanos representa un intento por demarcar el terreno en un mercado editorial cada vez más invadido por contenidos generados por IA. La Society of Authors del Reino Unido ha lanzado esta marca distintiva para certificar que las obras han sido creadas exclusivamente por humanos, sin intervención de modelos como GPT. En un contexto donde herramientas de IA producen textos coherentes a bajo costo, esta medida busca restaurar la confianza de lectores y editores. El logo se colocará en portadas y promocionales, tras un riguroso proceso de verificación manual que incluye análisis de metadatos, historiales de edición y declaraciones juradas. Esto contrasta con detectores automáticos de IA, que fallan en más del 20% de casos según benchmarks de Turnitin o GPTZero.

Contexto y motivación de la iniciativa

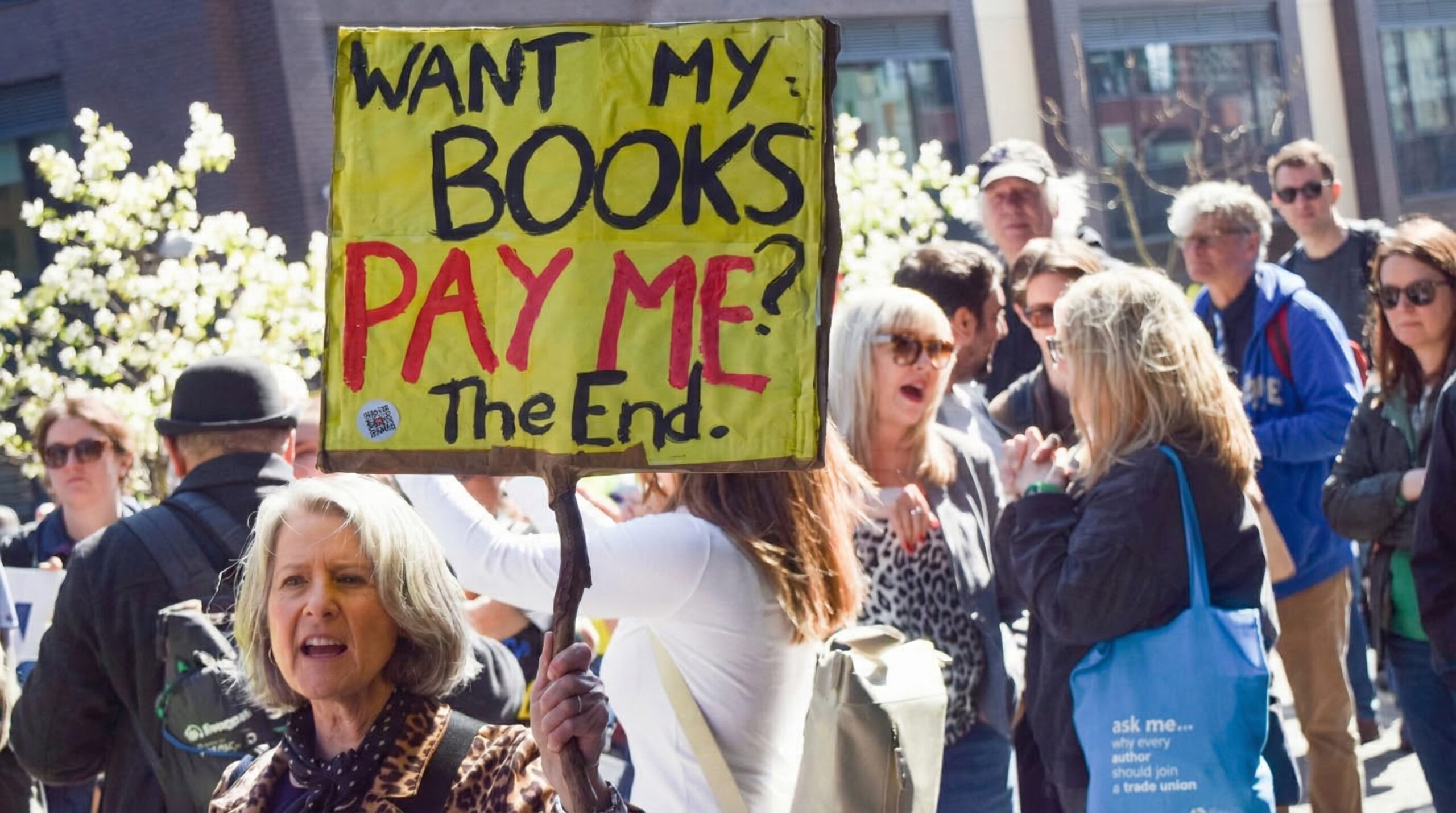

La Society of Authors responde al auge de la IA en la escritura, donde plataformas permiten generar novelas completas en minutos. Datos del mercado indican que el 15% de contenidos en Amazon Kindle ya provienen de IA, según informes de 2025, saturando categorías y devaluando royalties de autores tradicionales. Esta logo Society of Authors libros humanos no es solo un sello estético: pretende proteger la cadena de valor editorial, desde autores hasta distribuidores, promoviendo transparencia ética. Similar a etiquetas orgánicas en alimentos, busca diferenciar el ‘producto artesanal’ humano del industrializado por algoritmos.

Sin embargo, el proceso de certificación exige recursos: expertos revisan manualmente cada obra, excluyendo cualquier uso de IA en borradores, ideas o ediciones. Esto eleva barreras para autores independientes, que podrían enfrentar costos administrativos prohibitivos.

Proceso técnico y limitaciones detectadas

La verificación combina metadatos forenses, como timestamps de creación en editores como Word o Scrivener, con juramentos notariales. No confía en detectores IA automatizados por su alta tasa de falsos positivos y negativos. Críticos apuntan a IAs ‘sigilosas’ que imitan estilos humanos perfectamente, evadiendo cualquier escrutinio actual. Además, la iniciativa ignora híbridos humano-IA, comunes en edición profesional, potencialmente excluyendo innovaciones legítimas.

Planes de expansión a audiolibros y digitales incorporan blockchain para trazabilidad, un paso pragmático pero costoso. ¿Restaurará confianza o fragmentará el mercado en ‘humanos certificados’ vs. todo lo demás?

Implicaciones económicas y éticas

Económicamente, protege royalties: autores humanos ven ingresos caer un 25% en plataformas inundadas por IA barata, per Nielsen BookScan. El logo podría premiumizar libros certificados, similar a vinos con denominación de origen. Éticamente, fomenta autenticidad, pero plantea sesgos: ¿quién define ‘humano puro’? Regulación blanda como esta evita legislaciones pesadas, alineándose con enfoques europeos de autorregulación.

Sin embargo, frena innovación: herramientas IA democratizan la escritura para discapacitados o no nativos, y etiquetarlas como ‘inferiores’ podría estigmatizar progreso tecnológico.

Reacciones del sector y perspectivas futuras

Editores como Penguin Random House aplauden, mientras startups IA como Sudowrite critican como proteccionismo cultural. La Society planea alianzas con Amazon para filtros automáticos. En un mercado global de 100 mil millones de euros, esta logo Society of Authors libros humanos es un experimento clave.

Análisis Blixel:

Como Marcos Vidal, escéptico de medidas que disfrazan control bajo protección, veo esta logo como un parche pragmático pero miope. Bienintencionada, responde a datos reales: IA genera el 10-20% de ebooks low-cost, erosionando márgenes humanos. Pero su revisión manual es un cuello de botella burocrático, reminiscentes de certificaciones ISO que ahogan pymes creativas. Detectores IA fallan, sí, pero blockchain propuesto acelera trazabilidad sin humanos caros. Ironía: mientras reguladores europeos como la AI Act imponen cargas, aquí optan por autorregulación voluntaria, loable. Problema real es hipocresía: editores usan IA en marketing, pero la demonizan en autoría. Innovación gana con etiquetado transparente, no segregación. Futuro: mercado dual, premium humano vs accesible IA, impulsando calidad en ambos. No frenes el tren tecnológico por nostalgia literaria; educa lectores para elegir. Esta logo Society of Authors libros humanos es paso inicial, pero necesita escalar sin elitismo.