OpenAI ha desvelado los secretos técnicos detrás de su arquitectura de baja latencia para IA de voz, logrando tiempos de respuesta consistentes por debajo de los 500 milisegundos en producción. La compañía implementa técnicas de streaming y procesamiento paralelo que permiten mantener conversaciones fluidas a gran escala, información crucial para empresas que desarrollan productos conversacionales donde cada milisegundo cuenta para la experiencia del usuario.

La arquitectura que rompe las barreras del tiempo real

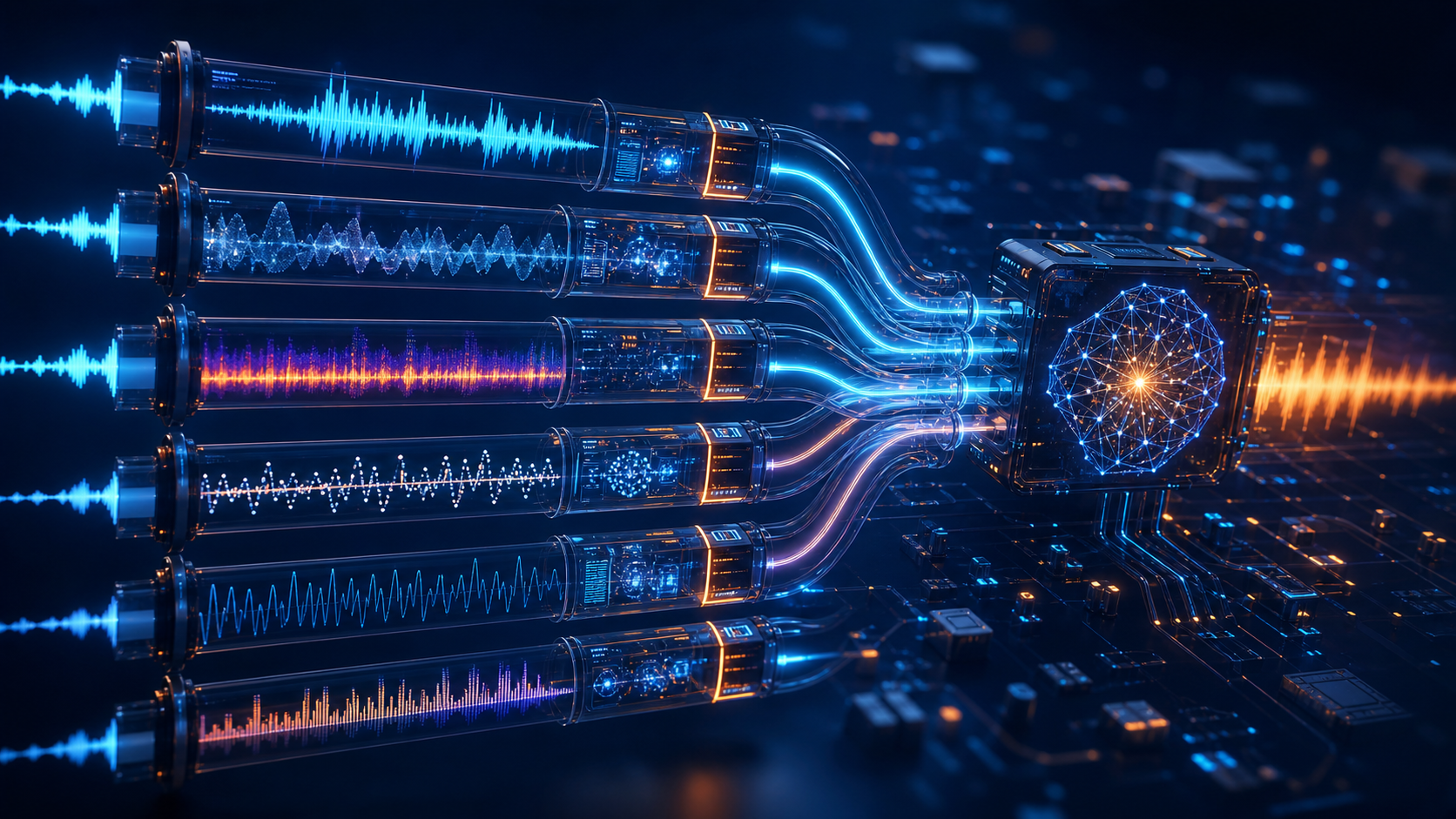

Los detalles técnicos publicados por OpenAI revelan una arquitectura multicapa que procesa audio de forma incremental, sin esperar a que termine la entrada completa del usuario. El sistema divide el procesamiento en tres etapas paralelas: captura y preprocesamiento de audio, inferencia del modelo de lenguaje, y síntesis de voz de salida. Esta arquitectura de baja latencia para IA de voz permite que cada componente trabaje con chunks de datos mientras los otros procesan información anterior o posterior en la pipeline.

La clave está en el streaming bidireccional: mientras el usuario habla, el sistema ya está procesando los primeros fragmentos de audio y preparando respuestas parciales. OpenAI utiliza modelos optimizados específicamente para inferencia rápida, con técnicas de cuantización y pruning que reducen el tamaño sin sacrificar calidad. El resultado son respuestas que comienzan a generarse antes de que el usuario termine de hablar, creando la sensación de conversación natural.

Optimizaciones técnicas que marcan la diferencia

El procesamiento paralelo se extiende a nivel de hardware con distribución inteligente de cargas entre GPUs. OpenAI implementa un sistema de caché predictivo que mantiene en memoria los contextos de conversación más probables, reduciendo el tiempo de inicialización. Las optimizaciones incluyen técnicas de batching dinámico que agrupa peticiones similares sin aumentar la latencia individual, y algoritmos de scheduling que priorizan las respuestas en curso sobre nuevas peticiones.

La síntesis de voz opera con modelos neurales compactos entrenados específicamente para velocidad, utilizando técnicas de destilación de conocimiento desde modelos más grandes. El sistema mantiene múltiples versiones del modelo cargadas simultáneamente, seleccionando la óptima según la complejidad de cada respuesta. Esta arquitectura de baja latencia para IA de voz logra consistencia incluso durante picos de tráfico mediante balanceadores de carga inteligentes que redirigen peticiones según la capacidad en tiempo real.

Como pueden aplicar esto las empresas hoy

Las empresas que desarrollan asistentes de voz o aplicaciones conversacionales pueden implementar varias de estas técnicas sin necesidad de la infraestructura completa de OpenAI. El streaming de audio bidireccional es implementable con WebRTC y bibliotecas como Web Audio API, permitiendo procesar fragmentos de 100-200ms en lugar de esperar frases completas. Las técnicas de caché predictivo son aplicables a nivel de aplicación, manteniendo contextos frecuentes en Redis o sistemas similares para reducir tiempos de inicialización.

Análisis Blixel

La publicación de estos detalles técnicos por parte de OpenAI no es casualidad: están estableciendo el estándar de lo que significa «tiempo real» en IA conversacional. Mientras la competencia lucha por alcanzar latencias de 1-2 segundos, OpenAI ya opera consistentemente bajo 500ms, creando una ventaja competitiva significativa en aplicaciones críticas como atención al cliente o asistentes médicos. Sin embargo, la implementación de esta arquitectura de baja latencia para IA de voz requiere inversión considerable en infraestructura y expertise técnico. Para PYMEs, la lección clave no está en replicar toda la arquitectura, sino en adoptar los principios: procesamiento incremental, caché inteligente y optimización específica para el caso de uso. La democratización de estas técnicas llegará probablemente a través de APIs y servicios cloud, pero conocer los fundamentos permite a las empresas evaluar proveedores y planificar arquitecturas futuras con criterio técnico sólido.

¿Quieres aplicar esto en tu empresa? En Blixel.ai te ayudamos a integrar IA con sentido común. Hablemos.