La implementación de soluciones de Inteligencia Artificial en entornos empresariales no tiene por qué ser un laberinto técnico. De hecho, la creación de un pipeline de IA basado en Gemma 3 1B Instruct y Hugging Face ya es una realidad lista para producción, accesible incluso para equipos con recursos limitados. Este avance democratiza el acceso a modelos de lenguaje grandes, permitiendo a las empresas desarrollar aplicaciones generativas personalizadas de forma eficiente y escalable.

Monta tu pipeline de IA con Gemma 3 1B Instruct

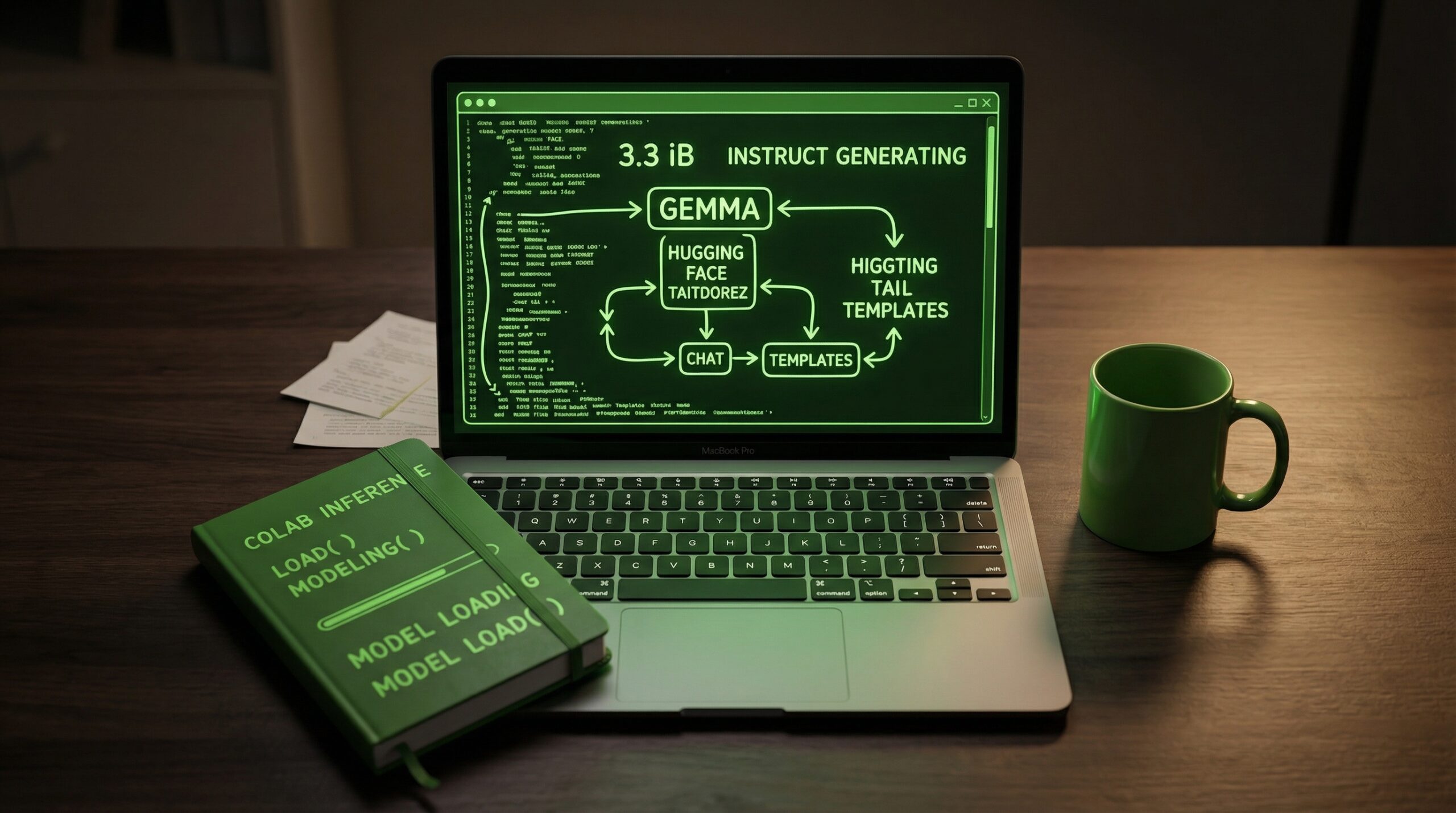

La clave para un pipeline de IA robusto y adaptable radica en la combinación de herramientas potentes y accesibles. Hugging Face Transformers, en conjunto con Google Colab, ofrece un ecosistema ideal para probar, ajustar y desplegar modelos como Gemma 3 1B Instruct. Este modelo, parte de la familia Gemma de Google, está optimizado para seguir instrucciones y es particularmente eficiente en términos de recursos, lo que lo hace ideal para PYMES que buscan integrar IA sin grandes inversiones en hardware.

El proceso comienza con instalar las dependencias básicas: torch, transformers, datasets, accelerate, evaluate, trl y sentencepiece. Si cuentas con GPUs que soporten BF16 y Flash Attention, la aceleración puede ser hasta 3x, reduciendo drásticamente los tiempos de entrenamiento y optimizando el consumo de recursos.

Para acceder al modelo, es necesario aceptar la licencia en Hugging Face y configurar los tokens de seguridad en Colab. Una vez hecho esto, puedes cargar el modelo base y aplicar las plantillas de chat (chat templates) para formatear los prompts de manera conversacional, facilitando así la interacción y mejorando la calidad de las respuestas generadas. La función pipeline('text-generation') te permitirá generar texto de forma eficiente, controlando la longitud y otros parámetros clave.

La capacidad de realizar fine-tuning en menos de 5 minutos de forma gratuita en Colab es un punto decisivo. Esto significa que las empresas pueden adaptar el modelo a sus necesidades específicas, ajustándolo a sus datos y dominios sin incurrir en costes iniciales elevados ni requerir infraestructuras complejas. Además, la compatibilidad con la familia Gemma, desde los 270M hasta los 27B de parámetros, y las opciones de cuantización (int4/fp8 para llama.cpp), abren un abanico de posibilidades para diferentes escenarios de uso, desde chatbots sencillos hasta asistentes más complejos.

Análisis Blixel: Un pipeline de IA al alcance de tu negocio

Este avance del pipeline de IA basado en Gemma 3 1B Instruct nos demuestra que la inteligencia artificial no es solo para grandes corporaciones. Para nuestras PYMES, esto se traduce en una oportunidad real de integrar capacidades de IA generativa de forma práctica y económica. Imagina un chatbot que responda preguntas de clientes con información específica de tu catálogo, o un asistente que redacte borradores de emails personalizados. La clave es empezar con algo pequeño, un caso de uso concreto que añada valor real a tu operación diaria. No se trata de construir el modelo más complejo, sino el que mejor se adapte a tus necesidades. La posibilidad de fine-tuning con Google Colab es un game-changer para las pequeñas empresas que buscan ser competitivas. Recomendamos explorar casos de uso específicos de tu negocio y empezar a experimentar con estas herramientas. No esperes a tener el presupuesto de una multinacional; la IA ya está aquí para ti.

Las opciones de despliegue son variadas. Desde soluciones escalables como Vertex AI hasta implementaciones más ligeras con Cloud Run y Ollama, las empresas pueden elegir la arquitectura que mejor se adapte a sus requisitos de escalabilidad y presupuesto. El soporte para PyTorch, JAX, Unsloth y vLLM asegura flexibilidad y rendimiento. Este enfoque «production-ready» no solo facilita la creación de aplicaciones, sino que garantiza su viabilidad a largo plazo, lo que es crucial para cualquier inversión tecnológica.

Fuente: Marktechpost