En el mundo de la Inteligencia Artificial, especialmente con la proliferación de los Modelos de Lenguaje Grandes (LLMs), una pregunta crucial emerge para cualquier empresa que busque integrar estas tecnologías: ¿cuántos evaluadores humanos son necesarios para benchmarks de IA confiables? Google Research ha publicado un análisis detallado que aborda precisamente esta cuestión, ofreciendo una hoja de ruta para optimizar la evaluación de LLMs sin sacrificar la fiabilidad. Este estudio es vital para PYMES que necesitan maximizar sus recursos y asegurarse de que sus inversiones en IA se basan en datos sólidos.

Optimización de la evaluación humana en IA

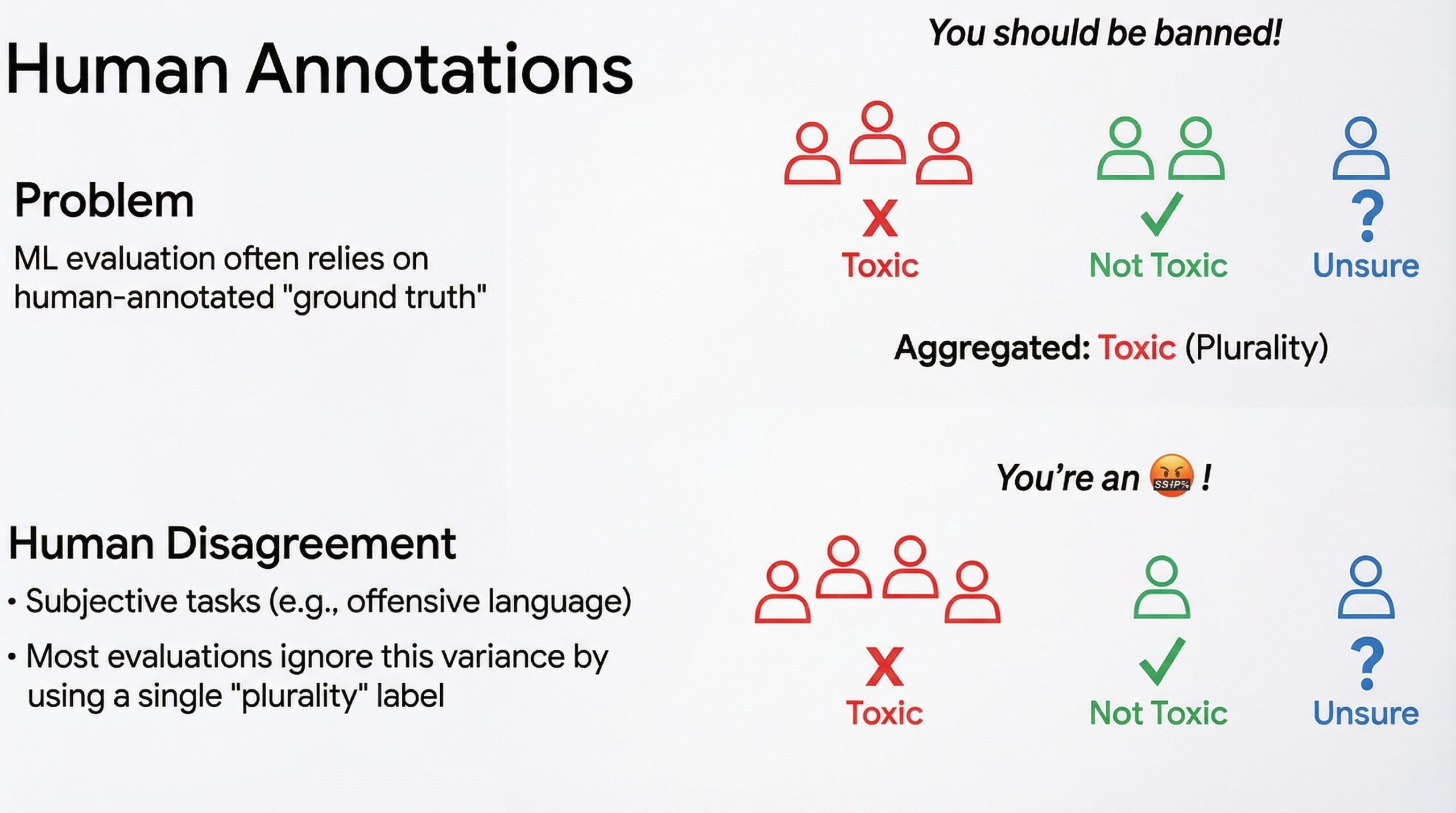

El estudio de Google se centra en determinar el número mínimo de evaluadores humanos requeridos para obtener métricas de rendimiento estables y precisas en tareas como la factualidad, la coherencia y la seguridad de las respuestas de los LLMs. Tradicionalmente, la evaluación humana es costosa y lenta. Sin embargo, este análisis propone un enfoque estadístico innovador, basado en el intervalo de confianza y el error estándar, para determinar cuándo los resultados de la evaluación son suficientemente robustos.

Los hallazgos son reveladores. En la mayoría de los benchmarks, se puede alcanzar el 95% de la precisión máxima con tan solo 3 a 5 evaluadores. Sin embargo, en dominios más complejos, como la factualidad paramétrica, la convergencia estable puede requerir hasta 7 evaluadores. Este matiz es fundamental: no todas las tareas son iguales y la evaluación debe adaptarse a la complejidad del dominio. La clave es entender que la varianza entre evaluadores es significativa (ICC ~0.4-0.6), lo que desaconseja el uso de los 1-2 raters que algunos benchmarks menores utilizan, obteniendo resultados volátiles e inestables.

Análisis Blixel: Más allá de los números

Para las empresas, estos datos de Google Research no son solo números; son una oportunidad para ser más eficientes. Si estás evaluando un LLM para tu chatbot de atención al cliente o tu herramienta de generación de contenido, saber que puedes obtener una fiabilidad considerable con un número reducido de evaluadores es un cambio de juego. Esto significa que puedes reducir los costos de evaluación humana en aproximadamente un 70% sin perder la calidad de los datos.

Nuestra recomendación práctica: no te cases con un número fijo desde el principio. El estudio propone un método de muestreo adaptativo: comienza con pocos evaluadores y añade más solo si es necesario, hasta alcanzar un ancho de intervalo de confianza objetivo (por ejemplo, ±2%). Esto permite optimizar el gasto y ajustar la intensidad de la evaluación a la criticidad y complejidad de tu aplicación IA. No hay por qué pagar por una evaluación excesiva cuando con menos es suficiente para tomar decisiones informadas para tu negocio.

Impacto en la fiabilidad de la IA aplicada

Este trabajo no solo optimiza costos, sino que eleva el estándar científico de la evaluación de IA. Critica implícitamente prácticas industriales que usan benchmarks poco rigurosos, donde la cantidad de evaluadores humanos para benchmarks de IA es insuficiente. Al validar su metodología con un análisis bootstrap (10k resamples), modelado bayesiano y validación cruzada, Google proporciona una herramienta robusta y escalable para la era de los modelos frontier. La disponibilidad del código y los datasets para reproducción es un plus que fomenta la transparencia y la adopción de estas buenas prácticas en la industria.

Para tu empresa, esto se traduce en una mayor confianza en las métricas de rendimiento de los sistemas de IA que implementes. Un benchmark riguroso, respaldado por una evaluación humana optimizada, te dará una base sólida para tomar decisiones estratégicas, invertir en las tecnologías adecuadas y mitigar riesgos. En definitiva, este estudio de Google proporciona un marco claro para que las empresas de todos los tamaños evalúen sus modelos de IA de manera más inteligente, más eficiente y con mayor garantía de éxito.

Fuente: Google Research Blog