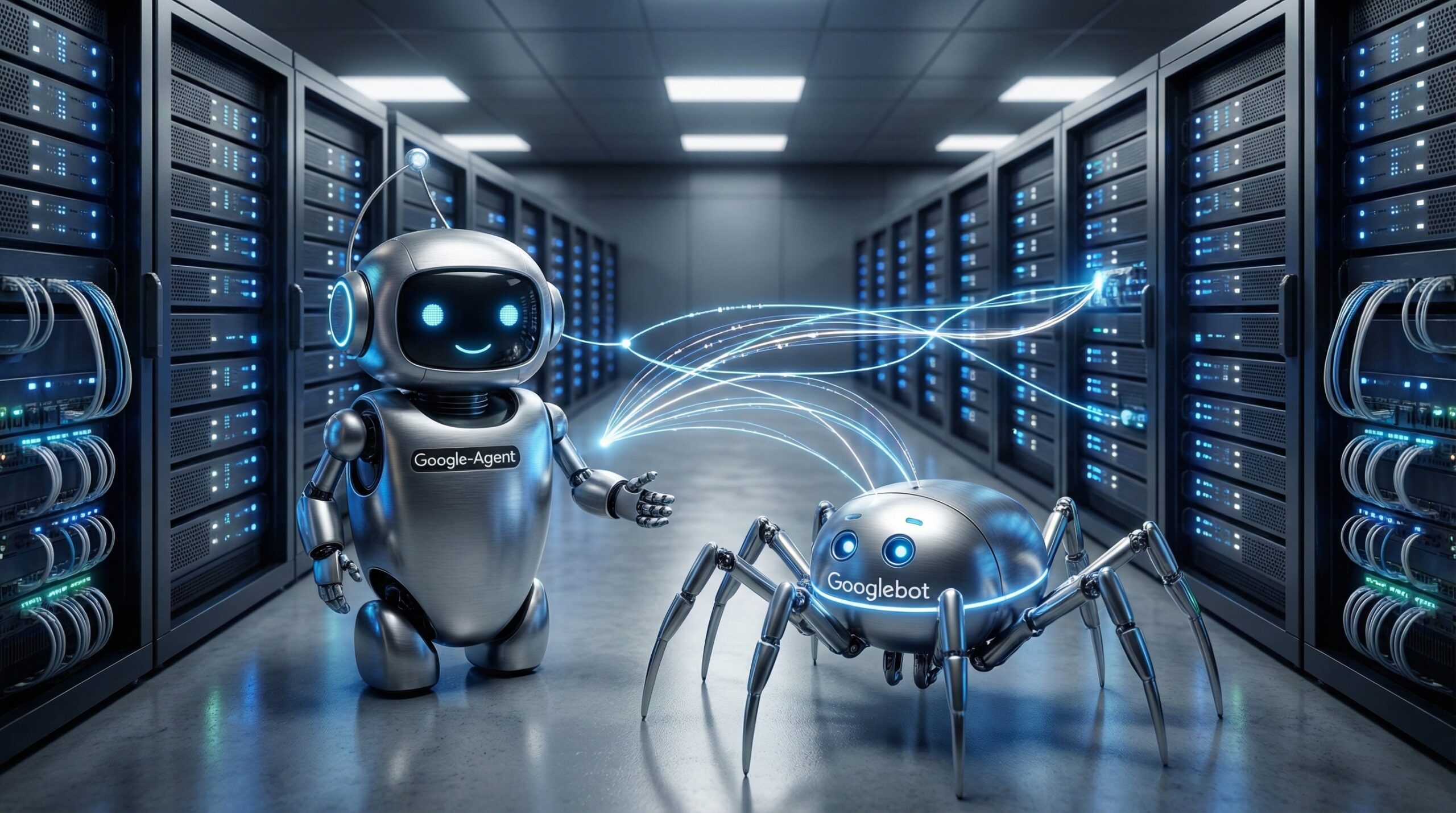

Google ha marcado una distinción técnica crucial entre sus agentes AI, aquellos que interactúan por medio de los usuarios, y Googlebot, su tradicional sistema de rastreo para la indexación web. Esta delimitación, basada en el conocido User-Agent y patrones de comportamiento específicos, abre una puerta importante para que las empresas y webmasters puedan controlar el acceso a su contenido de forma diferenciada. Un control directo que antes era más difuso y generaba incertidumbre.

Google delimita agentes AI: Qué implica para tu web

Entender la diferencia es clave. Googlebot es el rastreador de Google de siempre, el que usa un User-Agent que incluye claramente ‘Googlebot’. Su misión es indexar contenido para aparecer en los resultados de búsqueda tradicionales. Para ello, renderiza JavaScript usando versiones de Chrome actualizadas y tiene un propósito claro: construir el índice de búsqueda. Representa el 38.7% del tráfico de Google.

Por otro lado, los nuevos agentes AI o Google Agent son distintos. No usan el User-Agent ‘Googlebot’ y se activan por interacciones de usuario en interfaces conversacionales o impulsadas por IA. Su objetivo no es un rastreo sistemático para indexar, sino un acceso puntual para la síntesis generativa y respuestas contextuales. Dicho de otro modo, no renderizan JavaScript complejamente, sino que priorizan la extracción de datos para modelos de IA. Esta diferencia es fundamental porque significa que lo que un agente AI ‘ve’ de tu web y la forma en que lo procesa, no es lo mismo que Googlebot.

La capacidad de Google delimita agentes AI y ofrece así una ventaja estratégica. Ahora podemos diseñar reglas específicas en nuestro archivo robots.txt. Por ejemplo, permitir que Googlebot indexe nuestro contenido para los resultados de búsqueda (SERPs) tradicionales, pero bloquear el acceso a los agentes AI si deseamos evitar que nuestro contenido sea utilizado para el entrenamiento o la generación de respuestas en modelos de IA. Esto es especialmente relevante en un ecosistema donde bots como GPTbot (12.8% del tráfico web), Claudebot o Bingbot son cada vez más activos, rastreando la web de manera autónoma con fines de entrenamiento.

Análisis Blixel: Tu estrategia de contenido frente a la IA de Google

Esta distinción de Google no es una anécdota técnica; es un cambio fundamental en cómo las empresas deben gestionar su presencia digital. Hasta ahora, el robots.txt era una herramienta más o menos estática para controlar la visibilidad en buscadores. Con la capacidad de Google delimita agentes AI, se convierte en un activo de estrategia de contenido. Si eres una PYME, esto significa que tienes más control sobre la soberanía de tus datos. ¿Quieres que la IA de Google use tu contenido para generar respuestas? ¿O prefieres reservarlo para tus propios modelos o protegerlo como ventaja competitiva?

Mi recomendación es clara: revisa tu archivo robots.txt. Asegúrate de entender qué User-Agents estás permitiendo o denegando. Google ha proporcionado cadenas de User-Agent actualizadas. Esta es tu oportunidad para diferenciar entre la indexación tradicional (para SEO) y el uso de tu contenido para entrenamiento de IA. No es una decisión trivial; depende de tu modelo de negocio, la singularidad de tu contenido y tu estrategia de propiedad intelectual. Ignorar esto es dejar la puerta abierta sin saber quién entra y para qué.

Estamos en un punto donde la evolución de los AI agents que navegan la web autónomamente requiere respuestas técnicas claras. Esta guía de Google, publicada el 28 de marzo de 2026, proporciona las herramientas para que los publishers optimicen tanto la indexación como la protección de su contenido generativo. Además, se alinea con la tendencia de agentes que ejecutan flujos de trabajo complejos bajo supervisión humana, lo que subraya la necesidad de una gestión de acceso más granular.

Fuente: Marktechpost