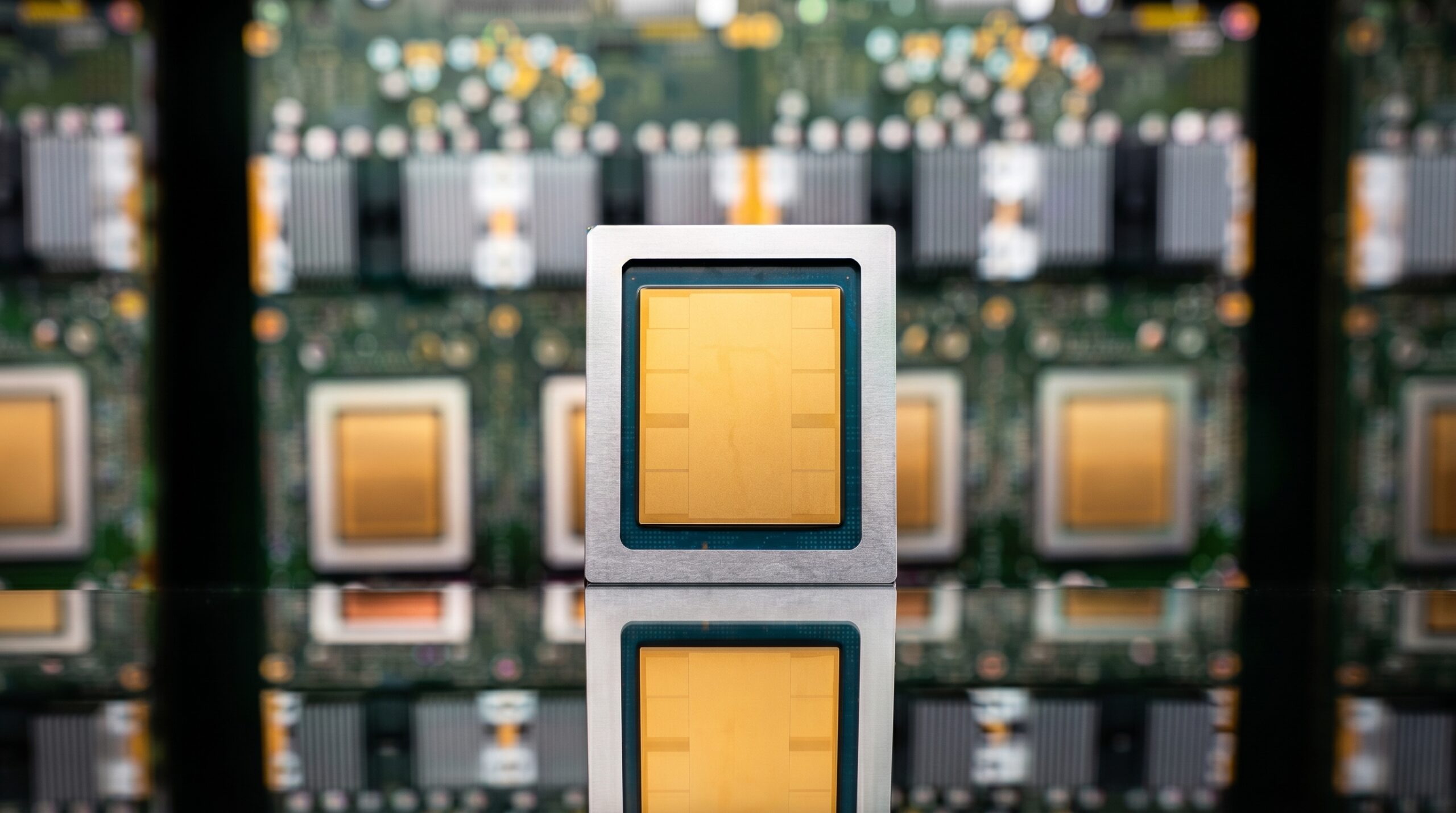

En el reciente evento Google Cloud Next 2026, Google lanza TPUs 8ª generación, dos nuevos procesadores, el TPU 8t y el TPU 8i, optimizados para revolucionar el desarrollo y despliegue de la inteligencia artificial. Google está apostando fuerte por este hardware, buscando no solo satisfacer la creciente demanda de la IA sino también establecer una competencia seria con gigantes como Nvidia. Para las empresas, esto significa más opciones y, potencialmente, una mayor eficiencia en sus proyectos de IA.

Google lanza TPUs 8ª generación: El 8t para Entrenamiento a Gran Escala

El TPU 8t ha sido diseñado específicamente para el entrenamiento de modelos de IA a gran escala, incluyendo la artillería pesada de los Grandes Modelos de Lenguaje (LLM). Lo crucial aquí es que la colaboración con Google DeepMind ha permitido crear un chip que reduce los ciclos de desarrollo de meses a semanas. Esto no es una promesa vacía; es un dato que debería resonar con cualquier directivo de PYME que entienda el coste y el tiempo implicado en la innovación. Para vuestros equipos de desarrollo, esto se traduce en una capacidad sin precedentes para iterar y lanzar productos de IA al mercado mucho más rápido.

Este nuevo TPU potencia supercomputadoras personalizadas, abordando así las demandas de arquitecturas de modelos en constante evolución. En un mercado donde la velocidad es oro, el TPU 8t podría ser el activo diferenciador que una empresa necesita para mantenerse a la vanguardia. La posibilidad de entrenar modelos complejos en una fracción del tiempo abre la puerta a experimentos más audaces y a la adaptación ágil a nuevas tendencias tecnológicas. Más contexto e información podéis encontrar, por ejemplo, en cómo Google ha ido evolucionando su hardware de IA.

El TPU 8i: Eficiencia en Inferencias y Despliegue en Producción

Mientras el 8t se enfoca en el músculo del entrenamiento, el TPU 8i pisa fuerte en el terreno de la inferencia y el aprendizaje por refuerzo. Aquí, Google promete un 80% de mejora en rendimiento por dólar respecto a la generación anterior. Esta cifra no es menor, especialmente para aquellas empresas que están moviendo modelos de IA de la fase de prototipo a la producción. El coste de la inferencia puede escalar rápidamente, y una mejora del 80% en eficiencia económica es un argumento de peso para considerar el TPU 8i en vuestras infraestructuras.

Estos chips se integran en la infraestructura AI Hypercomputer de Google, que combina cómputo de alto rendimiento, almacenamiento rápido y remediación automatizada. Esto significa no solo hardware potente, sino un ecosistema completo diseñado para optimizar el ciclo de vida de la IA. Las velocidades récord en desarrollo de productos que menciona Google no son solo un eslogan; son una oportunidad para que vuestras empresas agilicen lanzamientos y mejoren la competitividad.

Análisis Blixel: Implicaciones Reales de los TPUs de Google

Desde Blixel, vemos con optimismo que Google lanza TPUs 8ª generación. Para las PYMEs, esta noticia es de doble filo pero con un matiz positivo. Primero, la clara competencia con Nvidia significa que la carrera por la eficiencia y el precio se intensificará, lo que debería traducirse en costes más accesibles a medio y largo plazo para las cargas de trabajo de IA. Ya sea que optéis por Google Cloud o por otros proveedores, la presión competitiva os beneficiará.

Segundo, la apuesta de Google por sus propios chips reduce la dependencia de un único proveedor de hardware. Esto es clave en la gestión de riesgos en la cadena de suministro y garantiza una mayor estabilidad a la hora de planificar vuestra estrategia de IA. Nuestra recomendación es empezar a evaluar las ofertas de Google Cloud que integran estos nuevos TPUs, especialmente si ya tenéis cargas de trabajo significativas en inferencia o estáis contemplando el entrenamiento de modelos de lenguaje propios. No se trata de un cambio radical mañana, pero sí de una señal clara de dónde se dirige el mercado y de las oportunidades que se abren para optimizar vuestros presupuestos y tiempos de desarrollo.

Adicionalmente, los acuerdos estratégicos de Google, incluyendo un pacto multibillonario con Anthropic para el acceso a hasta 1 millón de TPUs, solidifican su posición como proveedor líder de infraestructura AI. Estos movimientos no solo aseguran la visibilidad de ingresos para Google Cloud, sino que también garantizan la disponibilidad y escalabilidad de estos recursos para empresas como la vuestra. Al diversificar su dependencia de GPUs Nvidia, Google está construyendo una base sólida para un futuro de IA más versátil y eficiente.

Fuente: TechCrunch