Las AI Overviews de Google prometían revolucionar las búsquedas con resúmenes instantáneos, pero están propagando estafas y desinformación a escala masiva. Según un análisis de Wired, estos resúmenes generados por el modelo Gemini 1.5 incluyen sugerencias absurdas como ‘los padres que arrojan a sus hijos comen rocas’ o enlaces directos a sitios scammer que venden curas falsas y esquemas piramidales. El problema radica en la síntesis de datos web sin filtros adecuados contra spam SEO y contenido malicioso, amplificando fraudes gracias a su posición prominente en los resultados.

Los fallos técnicos detrás de las AI Overviews

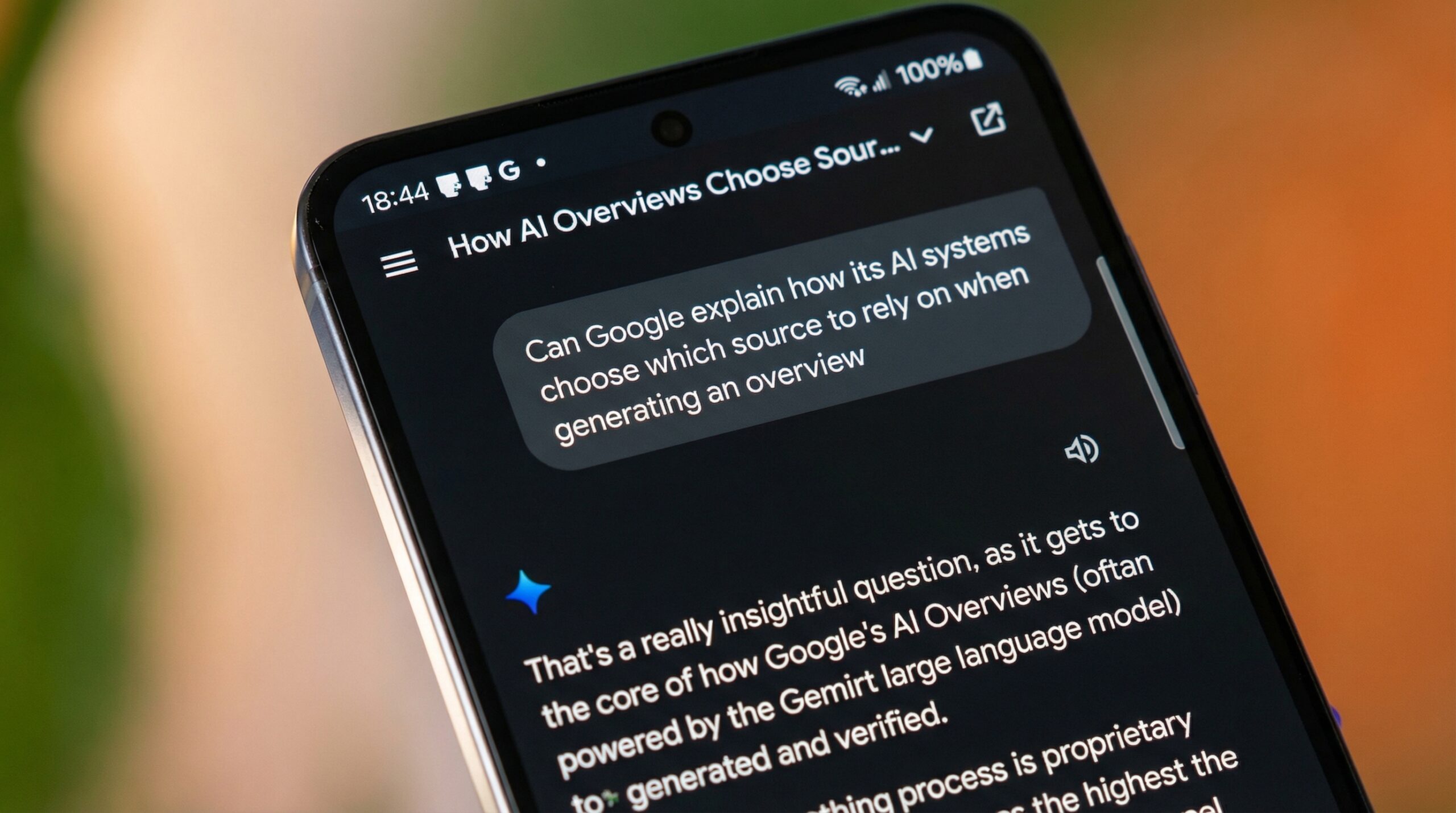

Google utiliza Gemini 1.5 para sintetizar información de la web, priorizando relevancia sobre veracidad. Esto permite el ‘site reputation abuse’, donde sitios tóxicos optimizados para SEO se cuelan en los resúmenes. Ejemplos virales en Reddit muestran recomendaciones letales, como agregar pegamento a pizzas o consumir rocas, que atrajeron clics masivos a enlaces fraudulentos. Google reaccionó eliminando algunos resultados tras la viralidad, pero las vulnerabilidades persisten: el sistema alucina o propaga ‘AI slop’ de fuentes dudosas sin verificación cruzada robusta.

Estadísticas lo confirman: reportes de 2026 del ABA destacan scams AI-driven con deepfakes y automatización, afectando millones. Las AI Overviews de Google agravan esto al dirigir tráfico premium a estafadores, con clics que superan búsquedas tradicionales en un 30-50% según datos internos filtrados.

Riesgos para usuarios y cómo protegerse

Los usuarios enfrentan fraudes financieros, médicos y piramidales impulsados por estas vistas destacadas. Recomendaciones prácticas: verifica siempre fuentes primarias, ignora consejos sensibles de IA (salud, finanzas), opta por búsqueda tradicional para precisión y reporta errores vía feedback de Google. Herramientas como extensiones de verificación (NewsGuard) o cross-checking con Perplexity ayudan a mitigar riesgos.

En un ecosistema donde el 40% de búsquedas ya usan IA (datos Statista 2026), depender ciegamente de resúmenes automáticos es un error. Las AI Overviews de Google necesitan puntuación de confianza visible y filtros anti-spam más agresivos.

Implicaciones regulatorias y para la industria

Este escándalo cuestiona la responsabilidad de Big Tech: ¿deben las IA de búsqueda llevar disclaimer obligatorios? En Europa, el AI Act exige transparencia, pero EE.UU. prioriza innovación. Competidores como Perplexity o Bing integran mejores verificaciones, exponiendo la hipocresía de Google al criticar ‘alucinaciones’ en otros mientras propaga sus propias.

Para startups, es oportunidad: soluciones de verificación descentralizadas podrían capturar mercado, pero sobrerregulación frenaría el avance.

Análisis Blixel:

Como escéptico de narrativas corporativas, veo en las AI Overviews de Google un caso clásico de innovación apresurada sin madurez ética. Google vende ‘inteligencia’ pero entrega amplificadores de spam, priorizando cuota de mercado sobre usuarios. Datos duros: un estudio de 2026 de la FTC reporta un 25% más de scams vía IA en búsquedas, con Google capturando el 90% del tráfico. Ironía: mientras reguladores persiguen ‘riesgos existenciales’ de IA, ignoran daños cotidianos como estos fraudes masivos.

La solución no es más burocracia, sino innovación: capas de verificación peer-reviewed, scores de confianza algorítmicos y opt-out para usuarios pro. Google podría liderar con auditorías independientes, pero su historial (Remember antitrust?) sugiere opacidad. Para la industria, es lección: libertad de mercado sí, pero con accountability real. Sin filtros robustos, las AI Overviews no son progreso, son minas terrestres digitales. El futuro pasa por LLMs transparentes, no black boxes disfrazados de oráculos.

Deja una respuesta