Hace poco, Google presentó TurboQuant, un algoritmo revolucionario que se está perfilando como un antes y un después en la forma en que interactuamos con los grandes modelos de lenguaje (LLM). Este desarrollo no es una mejora incremental, sino un salto cualitativo, especialmente para las empresas que dependen de estas tecnologías.

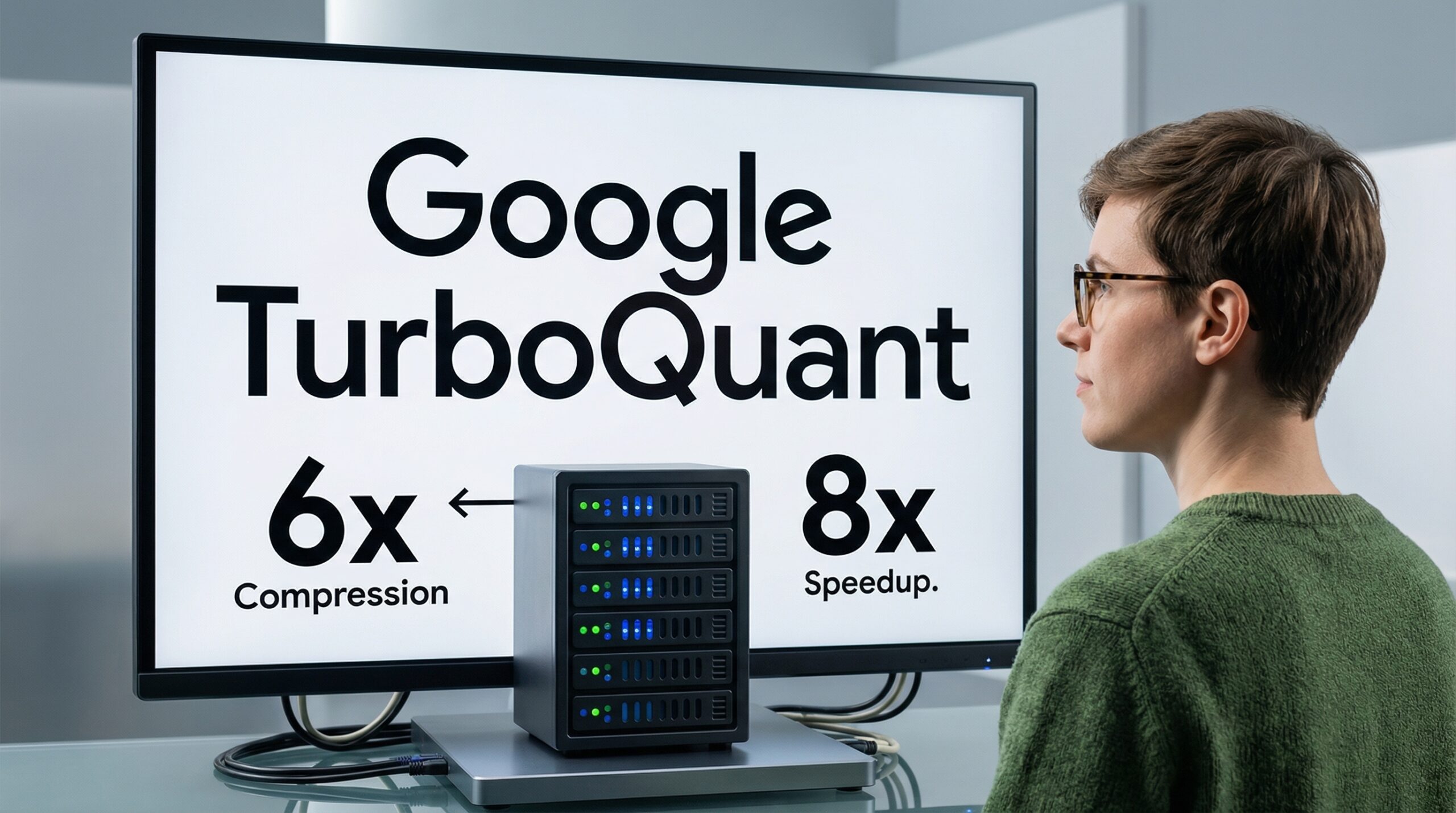

En esencia, TurboQuant ha sido diseñado para abordar uno de los grandes cuellos de botella de los LLM: el uso intensivo de memoria del KV cache, un componente crítico para la inferencia. Gracias a este invento, se ha logrado una reducción de hasta 6 veces en el uso de memoria y un impresionante aumento de velocidad de hasta 8 veces en la inferencia, y lo mejor de todo, sin perder ni una pizca de precisión. Esto significa que podemos ejecutar modelos más grandes, más rápido y con menos recursos, una ecuación que a cualquier negocio le va a interesar.

¿Qué implica TurboQuant de Google para las empresas?

La clave aquí es la eficiencia. Tradicionalmente, el tamaño del KV cache crece linealmente con la longitud de la secuencia, lo que se traduce en costos de hardware cada vez mayores y latencias inaceptables cuando se escala. TurboQuant ataja esto de raíz utilizando técnicas avanzadas de cuantización dinámica y predicción contextual. No estamos hablando de una compresión básica, sino de una optimización inteligente que entiende cómo funcionan los datos dentro del contexto de un LLM.

Esto abre puertas enormes. Imaginen la posibilidad de correr modelos complejos en hardware más modesto, como GPUs de consumo o dispositivos de borde, o de escalar chatbots multi-turno, generación de código o sistemas de razonamiento extendido sin preocuparse de que la factura de la nube se dispare. El impacto directo en los costos operativos es significativo y permite democratizar el acceso a la IA avanzada.

Análisis Blixel: Más allá de la teoría, el impacto en tu PYME

En Blixel, vemos esto con mucho optimismo. La noticia de Google y TurboQuant no es solo para gigantes tecnológicos; es especialmente relevante para las PYMES. Si estás usando o planeas usar LLM para automatizar atención al cliente, generar contenido, analizar datos o desarrollar nuevas aplicaciones, esta tecnología te permite hacer más con menos.

No esperes a que tu competencia empiece a disfrutar de estas ventajas. Evalúa cómo podrías integrar modelos más eficientes en tus operaciones. Ahorrar en infraestructura de cómputo no solo reduce tus gastos fijos sino que también te da flexibilidad para innovar y experimentar sin el miedo a los costos desorbitados. La clave es empezar a entender cómo estas optimizaciones pueden traducirse en valor real para tu empresa, permitiéndote escalar tus capacidades de IA de forma sostenible y rentable. La inteligencia artificial debe ser una herramienta accesible, no un lujo.

Los resultados mostrados por Google sobre TurboQuant no son abstractos: modelos como Gemma y T5, incluso en tareas exigentes con secuencias de hasta 128.000 tokens, mantienen su rendimiento. No hay pérdida aparente en métricas cruciales como la perplejidad o BLEU. Esto confirma que la eficiencia no viene a costa de la calidad, un miedo fundado con otras técnicas de compresión.

Este desarrollo se alinea perfectamente con la tendencia general de la industria hacia una inferencia de LLM más eficiente, con técnicas como las cascadas especulativas y la compresión predictiva. TurboQuant se posiciona como una pieza fundamental en este puzle, permitiendo que la IA sea más potente, más accesible y, sobre todo, más económica para el despliegue a gran escala. La capacidad de reducir seis veces la memoria y aumentar ocho veces la velocidad sin sacrificar la exactitud es un logro rotundo que acelerará la adopción de la IA en todo tipo de proyectos empresariales.

Fuente: MarkTechPost

Deja una respuesta