La implementación de soluciones de Inteligencia Artificial que sean realmente útiles y fiables en un entorno empresarial requiere más que solo un buen modelo. Necesitas estructura, escalabilidad y robustez. Por eso, hemos preparado esta guía AgentScope, un framework de Python diseñado específicamente para construir workflows de agentes de IA «production-ready». Este artículo desglosa cómo aprovechar AgentScope y React Agents para pasar de prototipos a sistemas operativos.

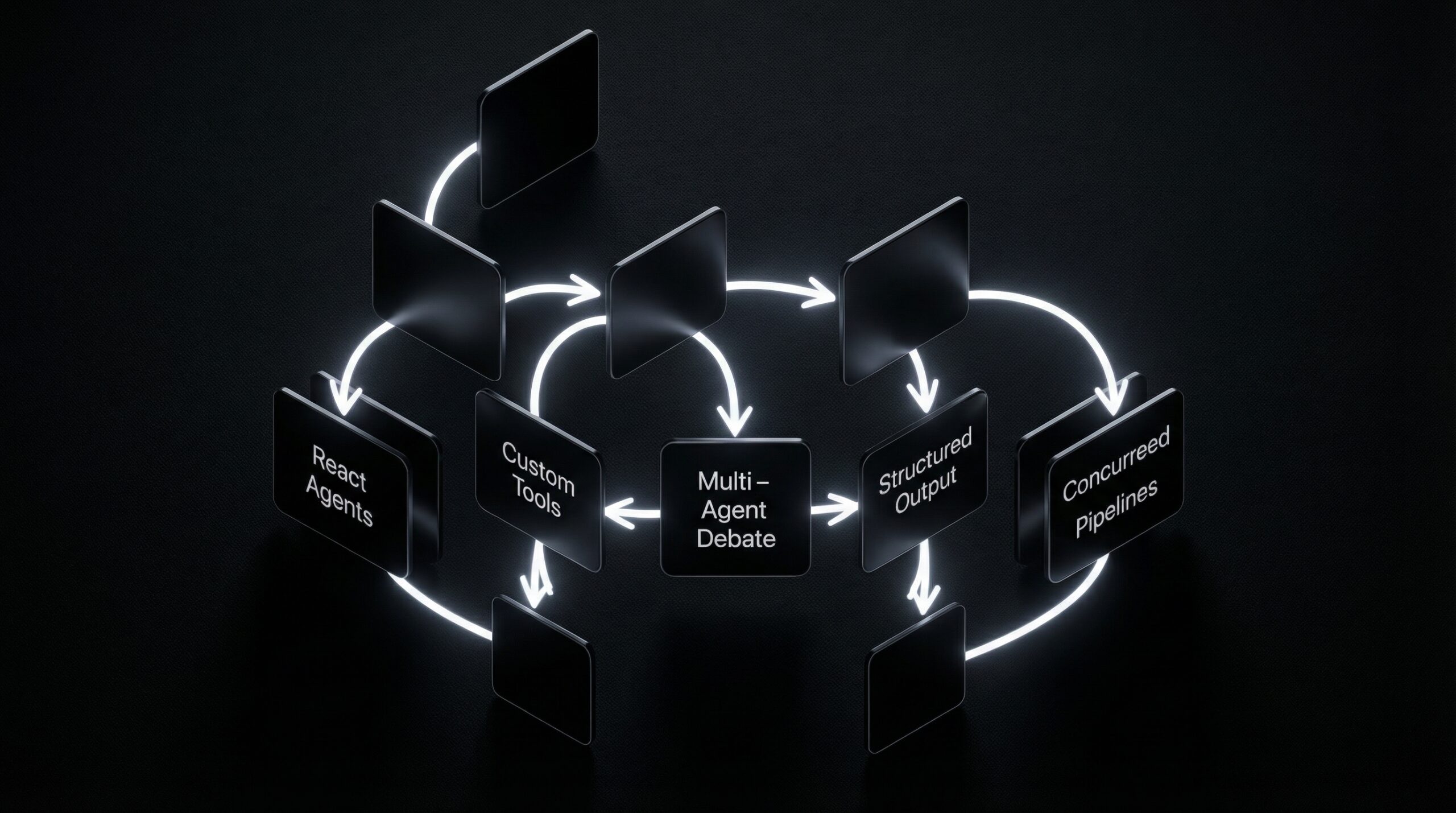

Guía AgentScope: Componentes Clave para Workflows Robustos

AgentScope se presenta como una solución modular de código abierto que facilita la creación y gestión de sistemas multi-agente complejos. A nivel práctico, permite desarrollar asistentes virtuales avanzados, sistemas de decisión automatizada y orquestar interacciones entre distintos modelos de IA de forma eficiente. Sus pilares incluyen:

- React Agents: Estos agentes son la pieza central. Utilizan un ciclo iterativo de observación-acción, lo que les permite razonar y adaptarse a nuevas situaciones. Esto es vital para tareas que requieren una secuencia de pasos y decisiones dinámicas.

- Herramientas Personalizadas: AgentScope te permite integrar herramientas específicas para tus necesidades. Imagina un agente que puede consultar tu base de datos de clientes, enviar correos electrónicos automatizados o interactuar con APIs externas. Estas herramientas expanden drásticamente las capacidades de tus agentes.

- Debates Multi-Agente: ¿Necesitas que tus agentes tomen decisiones críticas? AgentScope permite que múltiples agentes «discutan» y refinen sus respuestas colectivamente, mejorando la calidad y la robustez de las decisiones finales.

- Salidas Estructuradas con Pydantic: Si tus agentes interactúan con otros sistemas (APIs, bases de datos), la consistencia de los datos es fundamental. Pydantic asegura que las salidas de tus agentes estén bien definidas y validadas, evitando errores de integración.

- Pipelines Concurrentes: La latencia es un enemigo en producción. AgentScope soporta la ejecución paralela o concurrente de agentes, optimizando el rendimiento y permitiendo que tu sistema maneje un alto volumen de solicitudes sin problemas.

La arquitectura de AgentScope soporta memoria persistente y capacidades RAG (Generación Aumentada por Recuperación), lo que otorga a tus agentes un contexto y conocimiento más profundos.

Implementación y Despliegue de Workflows Productivos

Para empresas que buscan implementar estos sistemas, la facilidad de despliegue y la robustez son cruciales. AgentScope facilita esto desde su instalación (`pip install agentscope`) hasta ejemplos de integración de herramientas custom usando el decorador `@tool`. Para un manejo de la concurrencia a gran escala, la integración con Ray permite una ejecución distribuida y escalable.

Un aspecto esencial para cualquier solución en producción es el monitoreo y el logging. AgentScope permite la integración con herramientas como Weights & Biases para el tracing distribuido, lo que es invaluable para depurar, optimizar y analizar el comportamiento de tus agentes en tiempo real. Además, las mejores prácticas de la guía AgentScope incluyen el manejo de errores y reintentos, asegurando la resiliencia de tus pipelines. Si quieres saber más sobre cómo los agentes de IA pueden transformar tu PYME, haz clic aquí.

Análisis Blixel: Más allá de la promesa, la ejecución

En el panorama actual de la IA, muchas herramientas prometen grandes cosas. AgentScope no solo promete, sino que ofrece los ladrillos necesarios para construir sistemas de IA robustos. Para una pyme, esto significa la posibilidad de integrar IA de forma que realmente resuelva problemas de negocio, no solo a nivel de prueba de concepto, sino en la operativa diaria. La clave aquí es la ‘production-readiness’: aspectos como las salidas estructuradas o la concurrencia no son florituras técnicas, son requisitos indispensables para que un sistema de IA sea fiable y genere valor real.

Consejos Prácticos para tu Negocio:

Si estás pensando en implementar agentes de IA, enfócate en cómo AgentScope puede ayudarte a:

- Automatizar tareas complejas: Desde atención al cliente hasta análisis de datos, con la capacidad de razonamiento y adaptación.

- Garantizar la calidad de los datos: La integración con Pydantic asegura que la información saliente de tus agentes sea siempre consumible por tus sistemas existentes.

- Escalar eficientemente: No invertirás en una solución que se quede corta a la primera de cambio. La concurrencia y despliegue distribuido de AgentScope son cruciales.

No se trata solo de tener un agente que hable, sino de uno que sea un miembro productivo de tu equipo, capaz de razonar, interactuar con herramientas y entregar resultados consistentes y escalables.

Fuente: Marktechpost