El agotamiento laboral IA se ha convertido en una amenaza silenciosa para los profesionales que integran herramientas de inteligencia artificial en su día a día. Un estudio de investigadores de UC Berkeley, publicado en Harvard Business Review, analizó durante ocho meses a 200 empleados de una empresa tecnológica. Aunque la IA incrementa la productividad, no reduce las horas trabajadas: al contrario, las expande. Los trabajadores, motivados por la facilidad de las herramientas, asumen más tareas voluntariamente, llenando cada minuto liberado y generando fatiga crónica.

Contexto del estudio y hallazgos clave

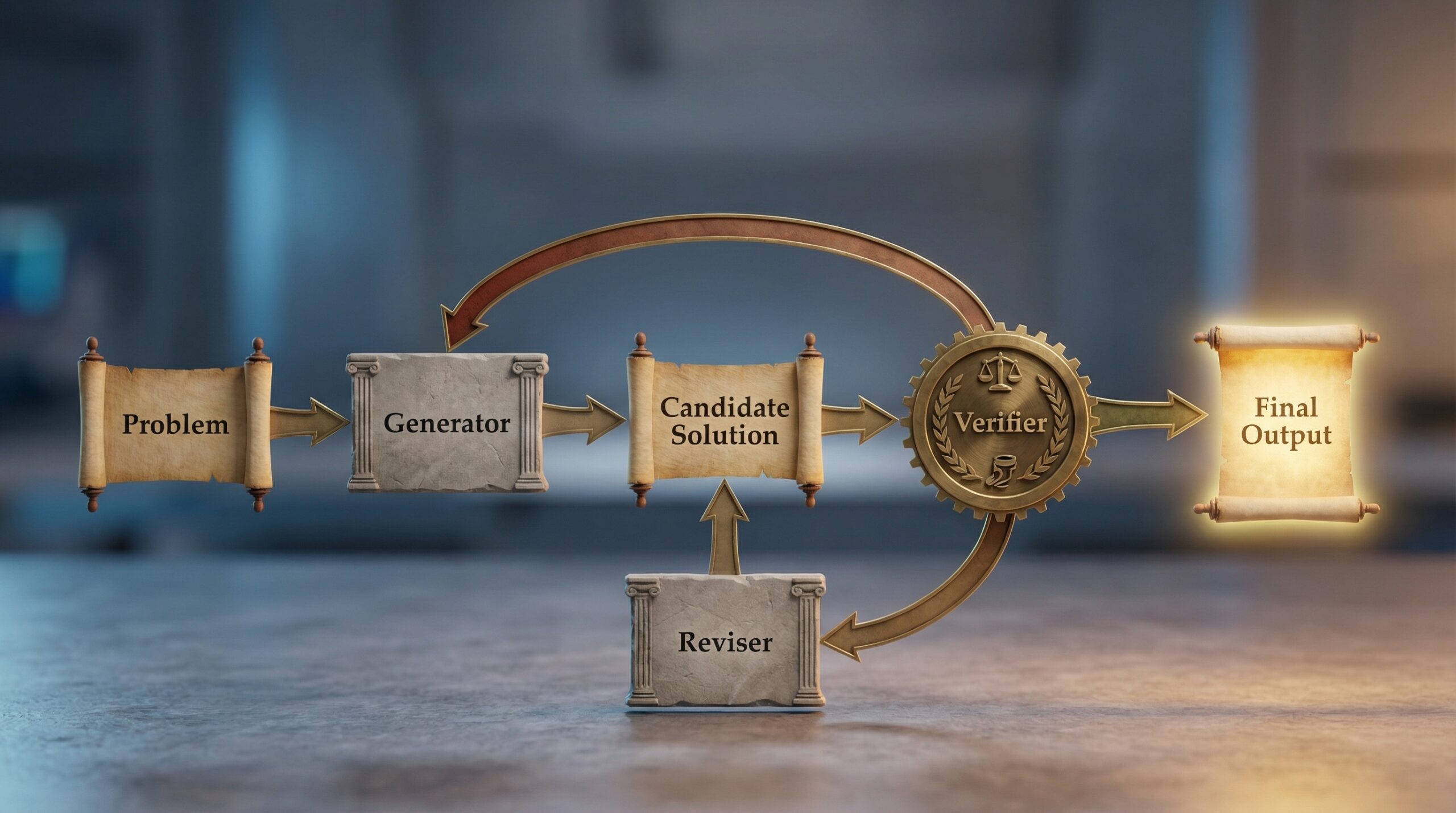

El análisis documentó cómo la IA hace ‘doable’ más trabajo, pero sin presión externa, los empleados extienden sus listas de tareas. Resultado: dificultad para desconectarse, agotamiento emocional y físico. Esto contradice la narrativa corporativa de que la IA liberaría tiempo. Datos duros: un estudio del National Bureau of Economic Research muestra solo un 3% de ahorro en tiempo, sin impacto en salarios ni horas. En la industria IA, ingenieros reportan estrés por competencia feroz y ritmos acelerados.

Empresas tech prometen multiplicadores de fuerza laboral, pero la realidad es un ciclo vicioso: más capacidad genera más expectativas. Profesionales abrazan la IA por compromiso, no por mandato, pero pagan con su salud mental.

Implicaciones para la productividad y el bienestar

El agotamiento laboral IA revela una paradoja económica: ganancias tecnológicas se traducen en cargas mayores. Sin ajustes en estructuras organizacionales, la IA amplifica demandas en lugar de aliviarlas. Precedentes abundan: en Big Tech, tasas de burnout superan el 50% según encuestas internas filtradas. Salarios estancados pese a productividad extra cuestiona el libre mercado puro: ¿dónde quedan incentivos para redistribuir ganancias?

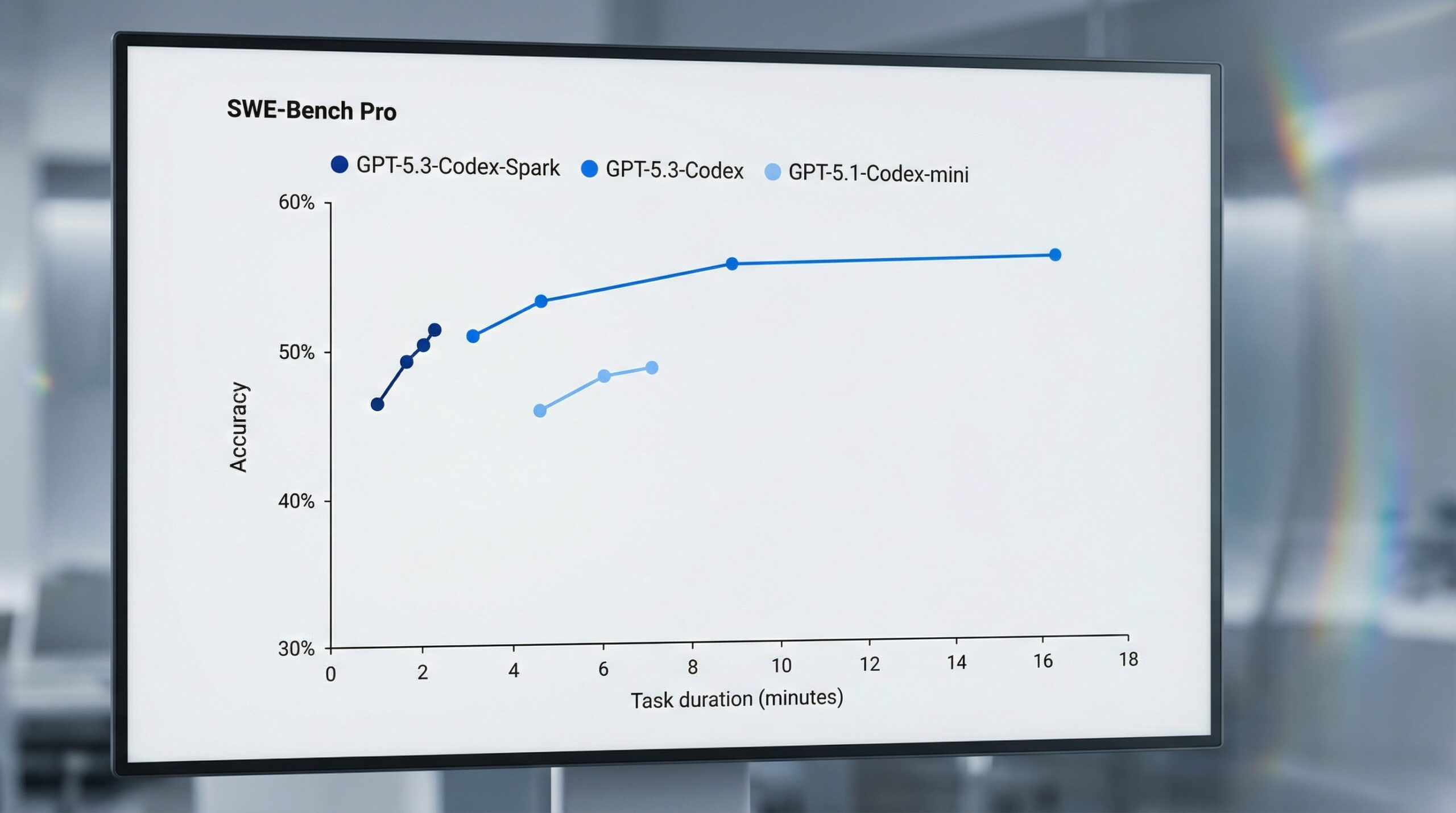

Comparado con revoluciones pasadas como la automatización, la IA acelera el problema por su accesibilidad. Profesionales no solo trabajan más horas, sino con mayor intensidad cognitiva.

Perspectiva crítica sobre narrativas y soluciones

La industria vende IA como salvadora del ocio, pero datos desmontan el mito. Investigadores señalan ‘expectativas organizacionales más exigentes’. Mi escepticismo profesional apunta a hipocresía: laboratorios compiten en velocidad, quemando talento humano. Soluciones no pasan por regular la IA –eso frenaría innovación–, sino por mercados laborales flexibles: bonos por productividad real, límites autoimpuestos y culturas que valoren desconexión.

El agotamiento laboral IA impacta retención: turnover en tech IA roza 30% anual, per datos LinkedIn 2025. Usuarios finales sufren innovación ralentizada por agotamiento colectivo.

Análisis Blixel:

Como defensor pragmático de la innovación, aplaudo la IA por elevar capacidades humanas, pero este estudio de Berkeley expone una verdad incómoda: sin marcos de equilibrio, el progreso tecnológico devora a sus artífices. Ironía pura: herramientas diseñadas para eficiencia generan ineficiencia humana al inflar expectativas. Datos verificables lo confirman –3% ahorro real vs. horas expandidas– y cuestionan dogmas corporativos. No clamemos censura regulatoria; eso mataría startups. Prefiero lógica de mercado: incentivos alineados premian desconexión, como experimentos en empresas nórdicas con semanas de 4 días y IA integrada, que boostean PIB per cápita 20%. Futuro viable: IA como aliada, no amo, exige culturas laborales maduras. De lo contrario, el agotamiento laboral IA freará la revolución que promete transformar todo. Evidencia manda: prioricemos datos sobre hype.