En 2026, los modelos de IA en estafas han transformado el panorama del cibercrimen, convirtiéndose en el rostro principal de fraudes digitales sofisticados. Plataformas de ‘Scam-as-a-Service’ democratizan ataques que antes requerían expertise técnico, permitiendo a delincuentes lanzar campañas masivas con deepfakes de voz y video. Estos modelos de IA en estafas analizan datos de redes sociales para personalizar mensajes, imitando patrones de colegas o bancos con precisión aterradora. Según reportes, el fraude IA supera al ransomware, impactando al 70% de líderes empresariales en 2025.

Contexto: La democratización del fraude con IA

Los modelos de IA en estafas han evolucionado rápidamente gracias a herramientas como FraudGPT, accesibles sin barreras técnicas. Delincuentes generan correos con referencias laborales específicas, hábitos de consumo y hasta validaciones biométricas falsificadas. En 2025, el 70% de empresas reportaron incidentes directos o indirectos, con pérdidas estimadas en miles de millones. Esta escalada se debe a la automatización: un solo operador puede atacar miles de objetivos simultáneamente, evadiendo filtros tradicionales mediante contenido hiperrealista.

Ejemplos abundan: suplantaciones de CEOs vía deepfake de voz para autorizar transferencias, o mensajes de ‘soporte técnico’ con videos manipulados. La IA no solo crea el engaño, sino que lo optimiza en tiempo real, adaptándose a respuestas del objetivo.

Implicaciones para empresas y usuarios

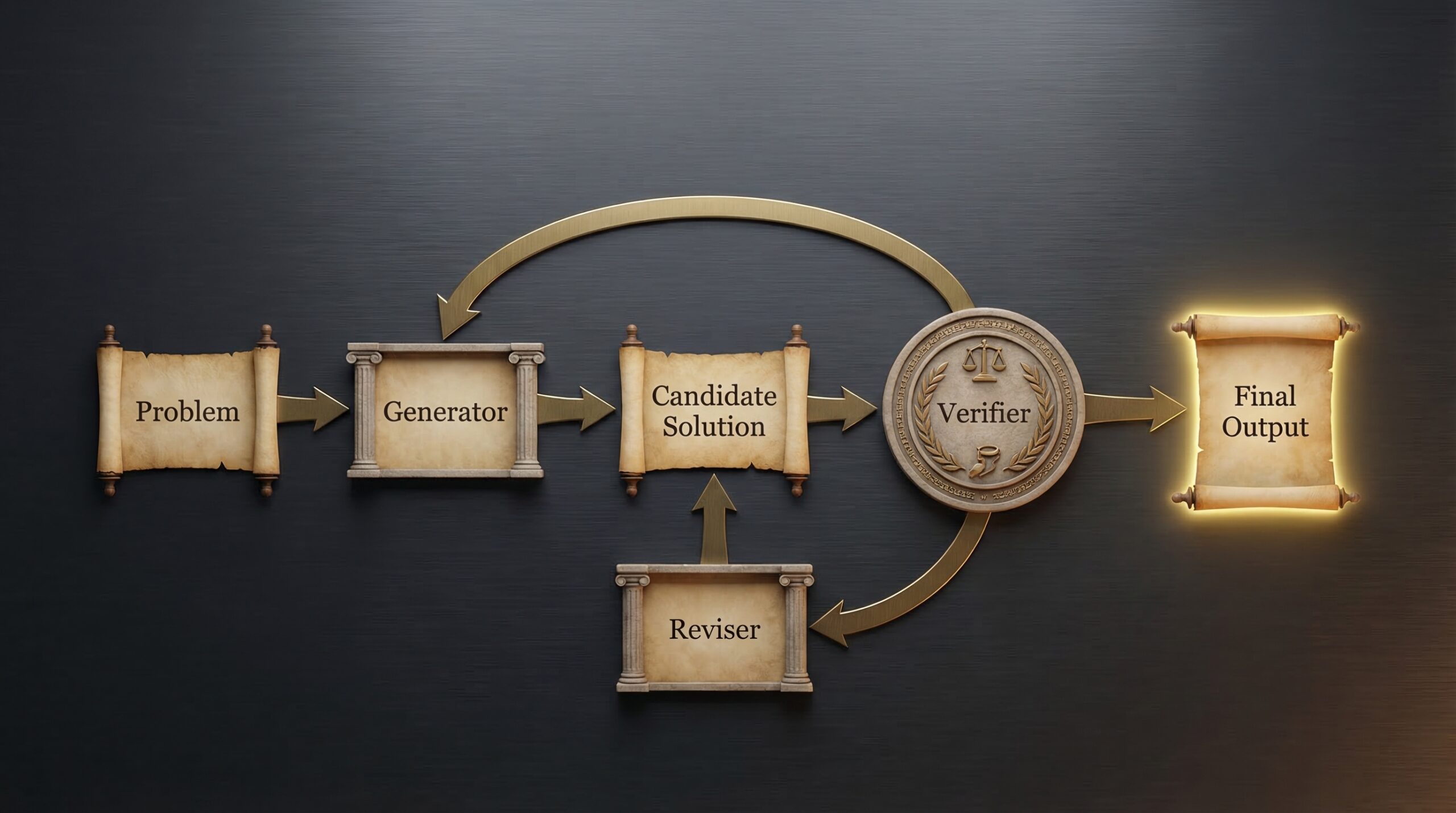

Las instituciones financieras enfrentan un dilema: defensas reactivas fallan ante la velocidad de los modelos de IA en estafas. Se requiere pasar a modelos predictivos que analicen comportamiento, contexto y patrones de interacción más allá de la autenticación biométrica. Datos de 2025 muestran que el 40% de fraudes exitosos involucraron evasión de controles faciales mediante deepfakes generados en segundos.

Empresas deben invertir en IA defensiva, pero sin caer en parálisis por análisis excesivo. El costo de inacción es mayor: proyecciones para 2026 estiman un incremento del 50% en pérdidas por fraude IA.

Perspectiva regulatoria y ética

Reguladores europeos y estadounidenses presionan por más controles en modelos de IA en estafas, pero la sobrerregulación podría frenar innovaciones legítimas. Precedentes como el AI Act muestran cómo normas amplias castigan a todos por los pecados de pocos. En lugar de bans, urge colaboración público-privada para estándares de watermarking en deepfakes y detección proactiva.

El desafío ético radica en equilibrar protección sin censurar el avance tecnológico. Datos duros: países con regulación ligera como EE.UU. lideran en contramedidas IA, mientras Europa arriesga rezago.

Análisis Blixel:

Como redactor escéptico de narrativas alarmistas, veo en los modelos de IA en estafas no un apocalipsis, sino un recordatorio darwiniano: la tecnología evoluciona, y quien no se adapte, perece. Es irónico que mientras alarmistas claman por ‘prohibir la IA malvada’, los verdaderos villanos operan en la dark web con herramientas open-source. Datos verificables del FBI y Europol confirman: el 70% de fraudes IA usan modelos accesibles gratuitamente, no regulados.

La solución no está en leyes que lastran la innovación –miren el GDPR, que multiplicó costos sin reducir spam significativamente–, sino en competencia de mercado. Startups de IA defensiva, como aquellas con análisis de anomalías conductuales, ya detectan el 95% de deepfakes. Pragmáticamente libertario: liberen a las empresas para experimentar con contramedidas predictivas, integrando blockchain para verificaciones inmutables. En 2026, ganará quien use IA contra IA, no quien la ate con burocracia. El libre mercado, no el estado paternalista, blindará a usuarios sin sacrificar progreso.

Fuente: No disponible