Infraestructura IA llave en mano para empresas.

Una infraestructura IA para empresas llave en mano significa que tu empresa recibe un sistema completo de inteligencia artificial: auditado, disenado, instalado, configurado y con soporte continuo. No compras hardware suelto ni contratas cloud sin estrategia. En cambio, obtienes una solucion que funciona desde el primer dia.

No hagas bricolaje con tu infraestructura de IA

Muchas empresas intentan montar su propia infraestructura de inteligencia artificial comprando hardware por un lado, contratando cloud por otro y buscando talento que lo una todo. El resultado suele ser meses de retraso, sobrecostes y un sistema que no escala.

El enfoque DIY (hazlo tu mismo) para infraestructura de IA tiene tres problemas fundamentales. En primer lugar, requiere un equipo interno con experiencia en hardware GPU, networking de alta velocidad, stacks de IA (CUDA, PyTorch, vLLM, TensorRT) y DevOps especializado. Este perfil es dificil de encontrar y caro de retener. En segundo lugar, el proceso de seleccion de hardware es complejo: elegir entre A100 y H100, entre 1U y 4U, entre aire y refrigeracion liquida, requiere conocimiento especifico que solo se adquiere con experiencia en despliegues reales.

Por otro lado, el modelo cloud-only tampoco es la solucion definitiva. Si bien la nube ofrece flexibilidad para validar ideas y escalar puntualmente, depender exclusivamente de ella para cargas de trabajo de IA tiene consecuencias a medio plazo: costes recurrentes que crecen con el uso, latencia variable que afecta a la experiencia del usuario, y riesgo de soberania de datos cuando se procesan datos sensibles en servidores de terceros ubicados fuera de la UE.

Nuestro enfoque llave en mano resuelve estos problemas combinando lo mejor de ambos mundos. Primero validamos en cloud para minimizar riesgos, despues disenamos e instalamos la infraestructura on-premise optima. De esta manera, tu empresa obtiene la soberania y el control del hardware propio sin el dolor de cabeza de montarlo desde cero. Y ademas, seguimos la metodologia Blixel, que garantiza entregables concretos en cada fase.

Primero auditamos, despues validamos en cloud, luego instalamos hardware

No empezamos comprando servidores. Empezamos entendiendo tu negocio, tus datos y tus objetivos. De este modo, cada euro invertido en infraestructura esta justificado por un caso de uso real.

La primera fase es la auditoria tecnica. Analizamos tus flujos de datos, identificamos que procesos son candidatos a ser automatizados con IA, evaluamos el volumen de inferencias esperado y determinamos los requisitos de latencia, privacidad y disponibilidad. Como resultado de esta fase, obtienes un informe detallado con la arquitectura recomendada y una estimacion de recursos.

La segunda fase es la validacion en cloud. Antes de invertir en hardware, desplegamos un prototipo funcional en la nube utilizando las mismas herramientas y modelos que se usaran en produccion. De esta forma, puedes probar el sistema con datos reales, medir el rendimiento y ajustar la configuracion antes de comprometerte con una compra de hardware. Este paso reduce significativamente el riesgo de la inversion.

La tercera fase es la instalacion on-premise. Una vez validado el sistema en cloud, seleccionamos el hardware optimo, lo configuramos con el stack completo de IA y lo instalamos en tus instalaciones (o en un colocation de tu eleccion). El resultado es un sistema identico al que probaste en cloud, pero ejecutandose en tu propia infraestructura, con tus datos dentro de tu red. Ademas, nuestros agentes IA pueden integrarse directamente con la infraestructura on-premise para automatizar procesos de negocio.

Tres configuraciones adaptadas a tu realidad

No es lo mismo una PYME que necesita ejecutar un modelo de lenguaje para atencion al cliente que una multinacional que quiere entrenar modelos propios. Por eso, ofrecemos tres niveles de infraestructura, cada uno disenado para un perfil de empresa diferente.

- Rack 1U-2U compacto

- 1-2 GPUs NVIDIA L40S (48 GB cada una)

- Stack: Ollama + RAG pipeline

- Modelos hasta 70B parametros (cuantizados)

- Soporte + monitorizacion incluidos

- Rack 2U-4U de alto rendimiento

- 4-8 GPUs NVIDIA H100 NVL (94 GB cada una)

- Stack: vLLM + fine-tuning pipeline

- Modelos hasta 405B parametros

- NVLink inter-GPU + InfiniBand

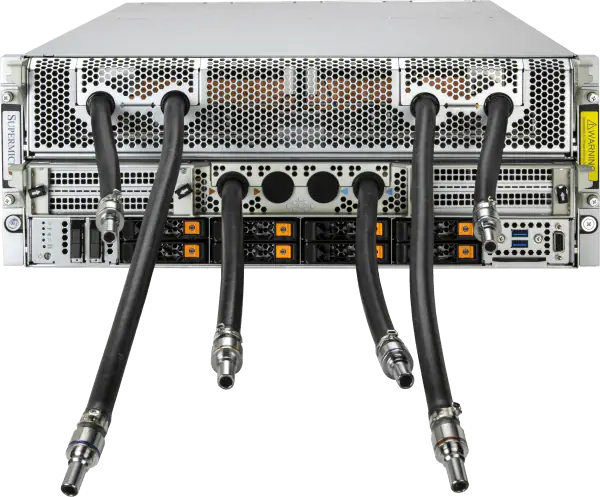

- Chasis HGX 8U de maxima potencia

- 8x NVIDIA H200 SXM (141 GB HBM3e cada una)

- NVLink 4a gen (900 GB/s bidireccional)

- Entrenamiento de modelos desde cero

- Refrigeracion liquida directa al chip

Para informacion detallada sobre las GPUs NVIDIA de datacenter utilizadas en estas configuraciones, consulta la seccion oficial de soluciones de datacenter de NVIDIA. Asimismo, puedes revisar las especificaciones de nuestro hardware GPU para mas detalle tecnico.

Todo lo que recibes con una solucion llave en mano

El servicio llave en mano no es solo hardware. Incluye todas las fases necesarias para que tu empresa tenga una infraestructura de IA operativa, segura y escalable.

Cuando la IA necesita estar en el punto de operacion

No todos los casos de uso requieren un servidor en un datacenter. A veces, la IA necesita ejecutarse directamente en el lugar donde se generan los datos: una fabrica, un almacen, un vehiculo o un punto de venta.

Edge AI para empresas industriales

Dispositivos fanless compactos, mini racks 1U con GPU NVIDIA L4 y equipos ruggedizados IP65 para exteriores. Inferencia en tiempo real sin depender de la nube, con latencias inferiores a 10 ms. Disenamos, desplegamos y monitorizamos redes de dispositivos edge en cualquier sector: manufactura, retail, logistica, smart city y salud.

El edge AI complementa la infraestructura centralizada. Los modelos se entrenan en el datacenter con GPUs de alto rendimiento y se despliegan en dispositivos edge optimizados para inferencia. De esta manera, tu empresa obtiene la potencia de entrenamiento del servidor central y la velocidad de respuesta del edge, sin sacrificar ni una ni otra.

Por que no depender solo de la nube para IA

La nube es perfecta para validar, prototipar y escalar puntualmente. Sin embargo, como unica estrategia para infraestructura de IA tiene limitaciones importantes que muchas empresas descubren demasiado tarde.

Nuestras automatizaciones con IA se integran directamente con la infraestructura on-premise, creando flujos de trabajo que procesan datos sensibles sin que salgan de tu red en ningun momento.

FAQ sobre infraestructura IA llave en mano

El plazo tipico desde la auditoria inicial hasta la puesta en produccion es de 4 a 8 semanas, dependiendo de la complejidad del despliegue. La fase de auditoria dura 1-2 semanas, la validacion en cloud 1-2 semanas, y la instalacion on-premise 2-4 semanas. Durante todo el proceso, tu empresa ya puede empezar a usar la version cloud del sistema, de forma que el impacto en el negocio es inmediato.

Todas nuestras soluciones estan disenadas para escalar. Un servidor de 2 GPUs puede ampliarse a 4 u 8 sin cambiar el chasis. Ademas, si necesitas pasar de un nivel PYME a Empresa, el proceso de migracion esta planificado desde el principio. Por lo tanto, no es necesario empezar de cero ni perder la configuracion existente. Simplemente escalamos la infraestructura a la siguiente fase.

No necesariamente. El servicio incluye monitorizacion remota y soporte tecnico, de forma que tu empresa no necesita un equipo de DevOps especializado en IA. Sin embargo, recomendamos que al menos una persona de tu equipo de IT reciba la formacion incluida para poder realizar operaciones basicas como reiniciar servicios, verificar el estado del sistema y desplegar actualizaciones de modelos.

Absolutamente, y de hecho es el camino que recomendamos. Empezar en cloud permite validar el caso de uso con una inversion minima. Una vez que los resultados son positivos, migramos la solucion a infraestructura on-premise. El stack de IA es identico en ambos entornos (mismos modelos, mismas APIs, misma configuracion), de forma que la transicion es transparente para los usuarios finales.

La diferencia principal esta en la potencia de computo y los casos de uso soportados. La solucion PYME con GPUs L40S es ideal para inferencia de modelos existentes (ejecutar modelos preentrenados para responder consultas, clasificar documentos, etc.). La solucion Enterprise con H200 SXM permite, ademas, entrenar modelos propios desde cero con datos de la empresa. Por lo tanto, la eleccion depende de si necesitas solo ejecutar modelos o tambien crearlos.

Tu infraestructura IA, lista para produccion

Auditamos tu caso de uso, validamos en cloud y desplegamos la solucion on-premise completa. Solicita un diagnostico tecnico sin compromiso.

Agenda auditoria gratuita