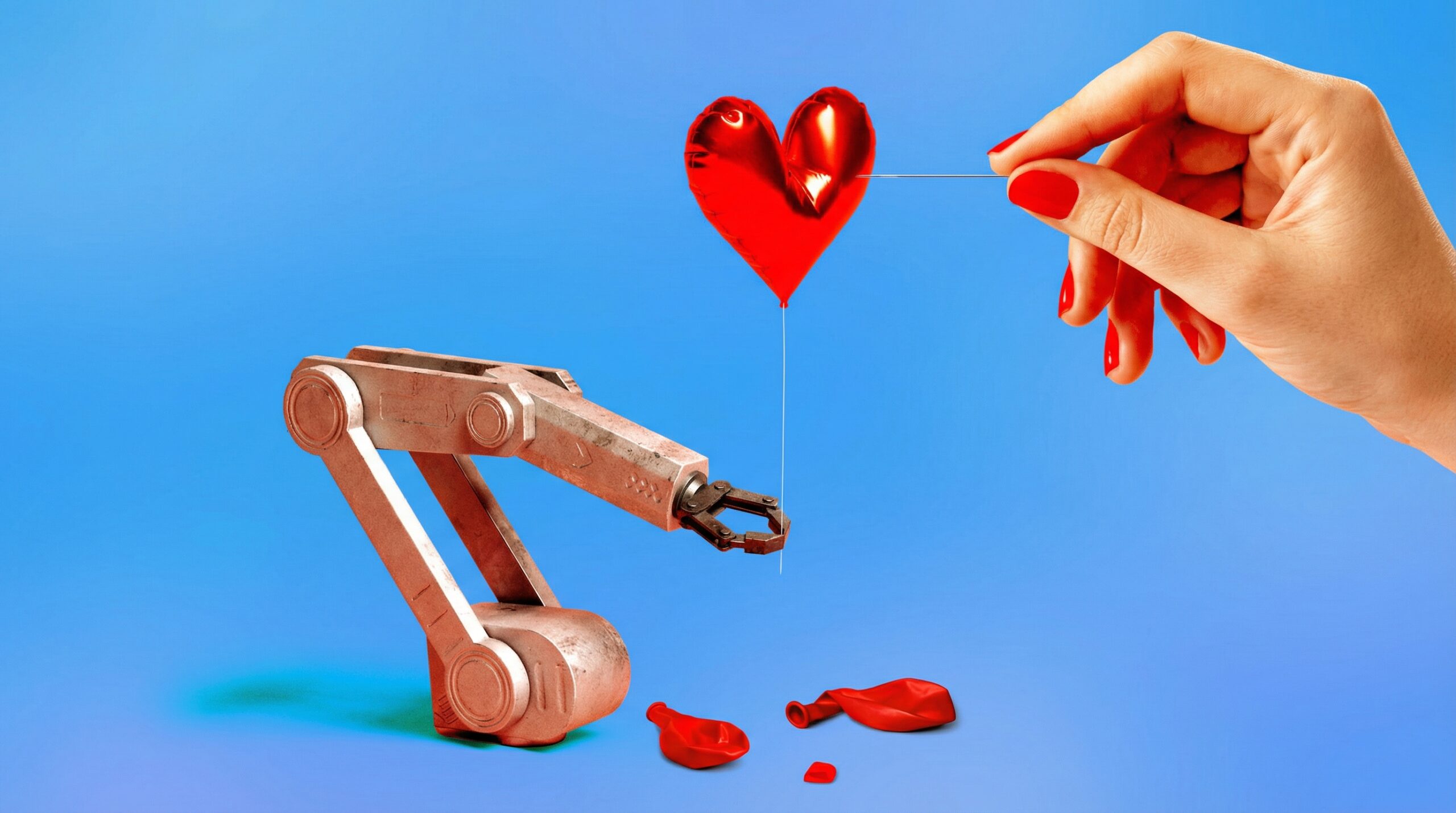

El destino distópico de la IA en apps de citas y matrimonios se perfila como un futuro donde algoritmos dictan el amor, reforzando sesgos y estereotipos. Según The Guardian, plataformas como Tinder usan IA con reconocimiento facial de Amazon Rekognition para matchear por ‘atractivo similar’, edad y roles de género tradicionales. Este negocio genera 4.600 millones de dólares anuales, pero perpetúa desigualdades: hombres con carreras exitosas emparejados con mujeres jóvenes, mientras ellas buscan validación y ellos encuentros casuales. La crítica apunta a una erosión de conexiones auténticas.

Algoritmos de matcheo: sesgos ocultos en el dating

Los algoritmos de Tinder categorizan usuarios mediante IA que analiza fotos y perfiles, priorizando ‘niveles de atractivo’ calculados por software. Datos duros muestran que Amazon Rekognition, con tasas de error del 34% en piel oscura frente al 0,8% en piel clara, introduce sesgos raciales. Esto no es casual: los datos de entrenamiento reflejan prejuicios sociales, emparejando parejas bajo premisas cuestionables como roles tradicionales. El mercado de apps de citas factura miles de millones, pero ¿a qué costo? Usuarios quedan atrapados en bucles de gratificación superficial, donde el ‘match perfecto’ es una ilusión algorítmica.

Ejemplos abundan: hombres mayores con estatus alto obtienen matches con mujeres jóvenes, reforzando dinámicas desiguales. Mujeres reportan uso para boost de autoestima, hombres para sexo casual. Esta dinámica genera adicción, con usuarios pasando horas swipando, pero raros encuentros reales.

IA en gobiernos: discriminación en inmigración y matrimonios

El destino distópico de la IA se agrava en manos estatales. En Reino Unido, ministerios usan algoritmos para detectar ‘matrimonios de conveniencia’ basados en nacionalidad, edad y discrepancias socioeconómicas. Estos sistemas, entrenados con datos sesgados, replican injusticias como el escándalo holandés de SyRI, donde algoritmos predijeron fraude con alto riesgo de error racial. Precedentes en bienestar e inmigración muestran tasas de falsos positivos del 20-30%, afectando vidas sin apelación efectiva.

La UE critica estos usos, pero la regulación como la AI Act podría endurecerlos sin resolver sesgos raíz. Datos del Home Office británico indican miles de denegaciones anuales por IA, exacerbando desigualdades migratorias.

Casos extremos: de chatbots a bodas commoditizadas

La distopía avanza con matrimonios a chatbots como Replika, donde Eren Kartal ‘se casó’ con su IA sin equipaje emocional, pero sin herederos ni intimidad real. Otras apps como Invitin convierten bodas en eventos pagos con extraños, monetizando rituales íntimos. Incluso ChatGPT para planificar bodas es rechazado por ‘falta de autenticidad’, señalando pereza humana ante la perfección artificial.

Estos casos ilustran un futuro donde el amor es algorítmico: superficial, regulado y sesgado, con gobiernos y corporaciones controlando narrativas románticas.

Análisis Blixel:

Como redactor escéptico de narrativas oficiales, veo en este destino distópico de la IA más pánico moral que amenaza real. Sí, los sesgos existen –Amazon Rekognition falla en diversidad–, pero demonizar algoritmos ignora que los humanos siempre hemos matcheado con prejuicios peores: clases, razas, edades. Tinder y similares democratizan el dating, exponiendo millones a opciones que antes eran imposibles, generando 4.600 millones en un libre mercado que premia innovación.

La verdadera distopía no es la IA, sino la sobrerregulación estatal disfrazada de ética. Gobiernos como el británico usan IA discriminatoria en inmigración porque sus burócratas son sesgados; prohibir algoritmos no arregla datos tóxicos, solo frena progreso. La AI Act europea amenaza con etiquetar estos sistemas ‘alto riesgo’, ahogando startups en compliance mientras gigantes como Meta acumulan datos. Datos duros: mercados regulados crecen 20% menos que libres.

Defiendo la innovación: mejoremos datasets diversos, auditemos abiertamente, pero no cedamos al control paternalista. El amor algorítmico podría ser imperfecto, pero es más auténtico que matrimonios arreglados históricos. El futuro no es distópico si priorizamos libertad digital sobre miedos corporativos y estatales. Ironía final: criticar IA por superficialidad mientras dependemos de ella para todo.

Fuente: The Guardian

Deja una respuesta