Visa ha puesto en marcha un movimiento estratégico con el lanzamiento global de Visa Agentic Ready, un programa diseñado para preparar el ecosistema de pagos para el comercio agéntico. Esto significa, en cristiano, que los agentes de inteligencia artificial actuarán de forma autónoma para realizar compras de bienes y servicios. El despliegue inicial se centra en Europa, incluyendo Reino Unido, una zona elegida por su madurez tecnológica en tokenización, passkeys y autenticación avanzada. Esto no es ciencia ficción; Visa ya está trabajando en cómo se pagará cuando tu asistente de IA decida, con tu permiso, comprarte las entradas del concierto que te interesaban.

Visa Agentic Ready y el futuro del comercio autónomo

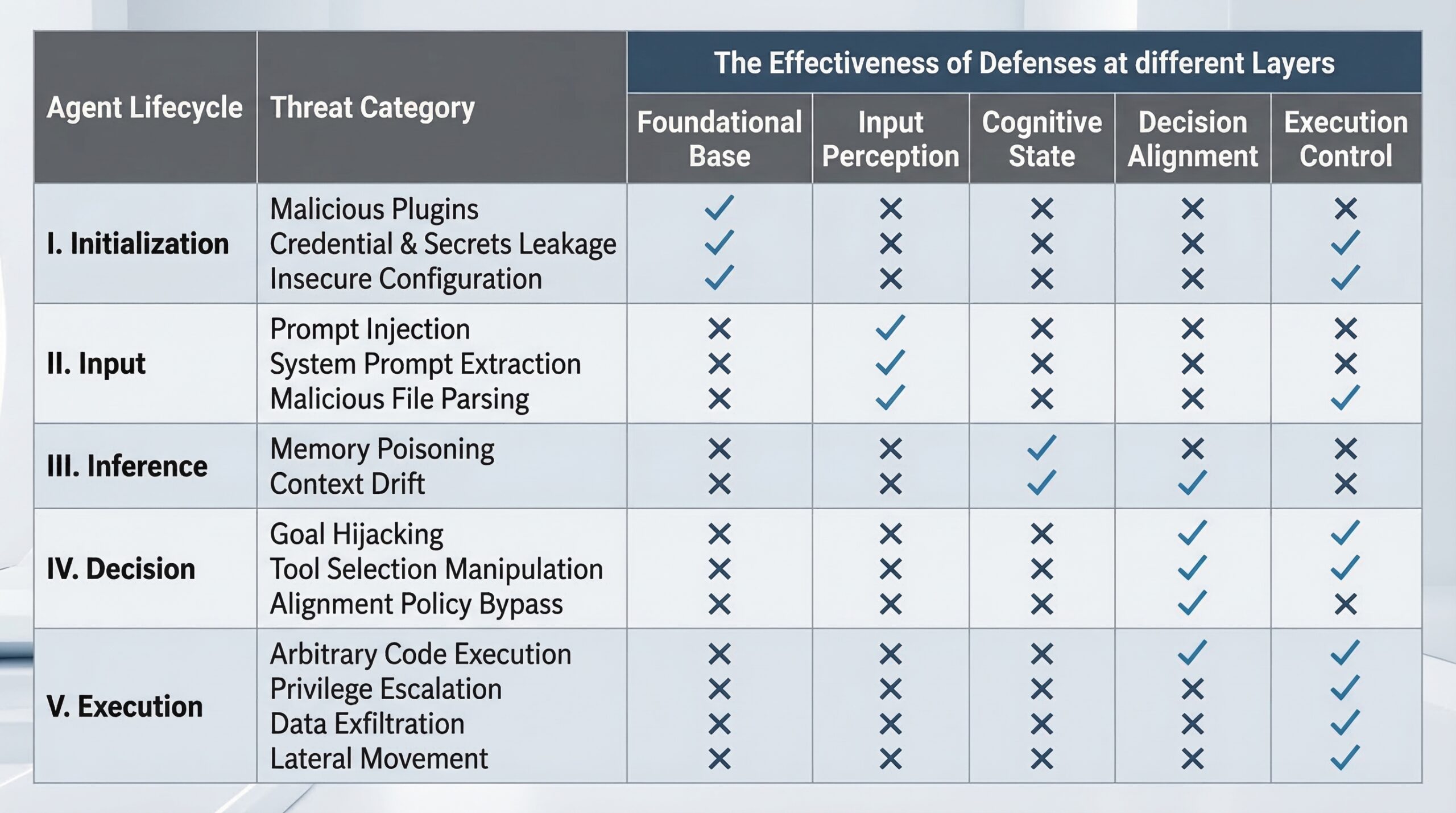

El programa Visa Agentic Ready se integra con Visa Intelligent Commerce (VIC), el marco estratégico de la compañía que capitaliza tres décadas de experiencia en IA para asegurar transacciones. La primera fase se focaliza en los emisores bancarios, estableciendo un marco para validar transacciones iniciadas por agentes IA en entornos controlados, en colaboración con comercios específicos. Esto garantiza una seguridad escalable antes de su lanzamiento masivo. Bancos como Barclays, HSBC UK, Revolut, Santander, Commerzbank y Erste Group ya están abordo, lo que da una idea de la seriedad del compromiso.

Este movimiento por parte de Visa busca anticiparse a un cambio fundamental en cómo se realizan los pagos. La compañía prevé que el 2026 será un año clave para la adopción masiva de pagos por IA, transformando el comercio de un modelo asistido a uno completamente autónomo. Para las PYMES, significa prepararse para un cliente que no es una persona, sino un algoritmo actuando en nombre de esa persona. Aquí es donde entra en juego la importancia de entender cómo la infraestructura de pagos está cambiando y cómo podemos adaptarnos para no quedarnos atrás. Es el momento de revisar tu pasarela de pagos y asegurarte de que es lo suficientemente flexible. Puedes ver más sobre las tendencias de pagos digitales en este recurso.

Análisis Blixel: ¿Qué significa Visa Agentic Ready para tu negocio?

Esta iniciativa de Visa no es solo una novedad tecnológica; es una clara señal de hacia dónde se dirigen los pagos y el comercio digital. Para una PYME, esto se traduce en una necesidad imperiosa de empezar a pensar en la flexibilidad de sus sistemas de venta y cobro. Si tus clientes, o mejor dicho, sus agentes de IA, van a realizar compras autónomas, tus sistemas deben estar preparados para identificarlos, procesar pagos y gestionar post-venta de forma automatizada y segura. No se trata de implementar IA en tu negocio de la noche a la mañana, sino de entender que las grandes infraestructuras, como Visa, ya están sentando las bases. Empieza por asegurarte de que tus plataformas de e-commerce y TPVs son compatibles con las últimas medidas de seguridad y tokenización. La clave aquí es la ‘preparación’: si Visa está preparando a los bancos, nosotros, como empresarios, debemos preparar nuestros comercios.

Preparando tu Negocio para el Comercio Agéntico

La adopción masiva de los pagos iniciados por IA puede parecer lejana, pero el hecho de que Visa ya esté trabajando con grandes bancos europeos subraya la inminencia de este cambio. Para tu PYME, esto se traduce en: 1) Evaluar la seguridad de tus transacciones actuales, asegurándote de que utilizas sistemas de tokenización y autenticación robustos. 2) Investigar cómo tus proveedores de pasarelas de pago y plataformas de e-commerce planean integrarse con estas nuevas capacidades agénticas. 3) Considerar cómo una IA podría interactuar con tus productos o servicios de forma autónoma y qué implicaciones tiene esto para tu inventario o atención al cliente.

Fuente: Artificial Intelligence News