La reciente noticia de que OpenAI adquiere startup de finanzas IA Hiro marca un punto de inflexión estratégico, indicando un movimiento claro de la compañía hacia la monetización de sus avanzados modelos de lenguaje a través de aplicaciones verticales. Publicado por TechCrunch el 13 de abril de 2026, este movimiento posiciona a OpenAI en el competido sector de las finanzas personales, integrando la potencia de sus sistemas generativos con la experiencia en IA financiera de Hiro.

¿Por qué OpenAI se interesa en las finanzas personales con IA?

Hiro es una startup que ha ganado tracción desarrollando asistentes financieros inteligentes. Su tecnología se basa en el procesamiento de lenguaje natural (PLN) y el aprendizaje automático para analizar patrones de gasto, optimizar presupuestos y ofrecer recomendaciones personalizadas. Esto no es solo una expansión de portafolio para OpenAI; es una estrategia para infundir IA avanzada directamente en la gestión económica diaria, abriendo nuevas vías de interacción entre usuarios, bancos y el software. La capacidad de Hiro para el forecasting financiero mediante algoritmos de series temporales, combinada con la comprensión conversacional de ChatGPT, podría revolucionar cómo las PYMEs y los negocios gestionan su tesorería y proyecciones.

La operación, aunque no se ha divulgado el precio, se estima en una valoración de Hiro entre 200 y 300 millones de dólares. Este tipo de adquisición refleja una tendencia de consolidación en el sector de la IA, donde las grandes tecnológicas buscan dominar nichos específicos. Para las empresas, esto significa que las herramientas de IA para la toma de decisiones financieras serán cada vez más sofisticadas y accesibles.

Análisis Blixel: La oportunidad financiera para su negocio

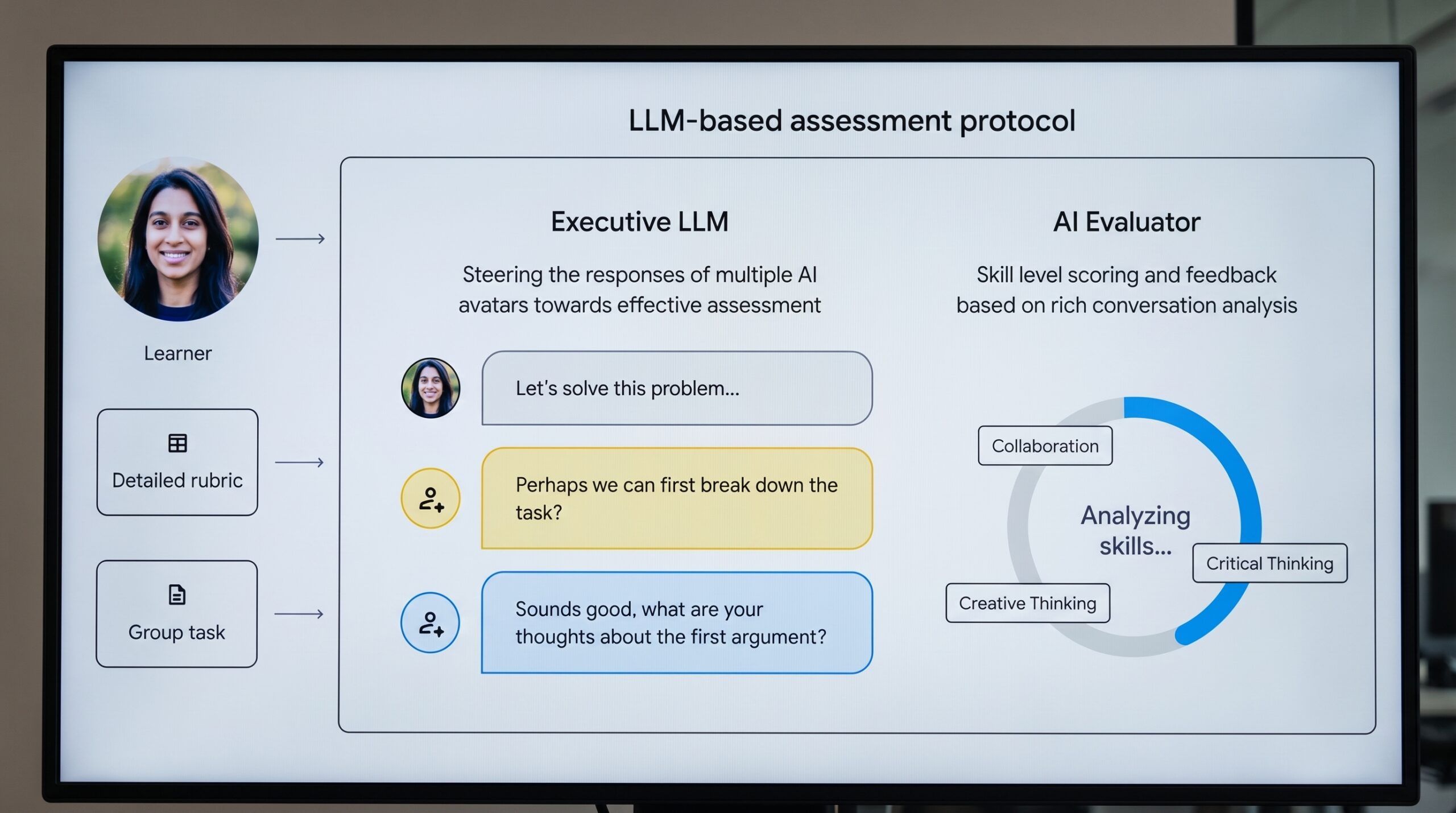

Desde Blixel, vemos esta adquisición como una señal inequívoca: la inteligencia artificial dejará de ser solo una herramienta de marketing o atención al cliente, para convertirse en un pilar fundamental de la gestión financiera. Para las PYMEs, esto se traduce en una oportunidad para automatizar y optimizar procesos complejos. Imaginen un asistente inteligente que no solo les dice cuánto tienen que pagar, sino que predice flujos de caja futuros con alta precisión, identifica riesgos financieros antes de que se materialicen o incluso negocia mejores condiciones con proveedores basándose en datos en tiempo real.

La clave aquí es la personalización y la proactividad. Las empresas que abracen estas tecnologías podrán liberarse de tareas repetitivas, permitiendo que sus equipos se centren en la estrategia y el crecimiento. Sin embargo, no todo es miel sobre hojuelas. La integración de sistemas tan complejos plantea desafíos significativos en cuanto a la privacidad de los datos, la ciberseguridad y el cumplimiento normativo. Mi consejo es que empiecen a evaluar cómo la IA puede integrarse en sus operaciones financieras, manteniendo siempre un ojo crítico en la seguridad de la información y la adecuación a normativas como GDPR o CCPA.

Las implicaciones técnicas son vastas, abarcando desde la gestión autónoma de finanzas hasta alertas proactivas ante riesgos. Esta convergencia entre IA generativa y software financiero tradicional acelerará la competencia en el sector fintech, donde actores como Plaid o Cleo ya están bien posicionados. La pregunta para las empresas no es si usarán la IA en finanzas, sino cuándo y cómo optimizarán su implementación.

Fuente: TechCrunch