Las preocupaciones éticas empleados Palantir han escalado ante la expansión de contratos con ICE, la agencia de inmigración de EE.UU. Según un podcast de Wired, Palantir desarrolla ‘ImmigrationOS’, un sistema de IA por 30 millones de dólares que rastrea y prioriza deportaciones de supuestos criminales. Herramientas como ELITE generan mapas geospaciales, dossiers con puntuaciones de confianza del 98,95% y listas de objetivos, integrando datos de HHS, USCIS y CLEAR. Esto genera tensiones internas en la compañía, fundada por Peter Thiel, ante el uso masivo de datos sensibles.

Contexto de la colaboración Palantir-ICE

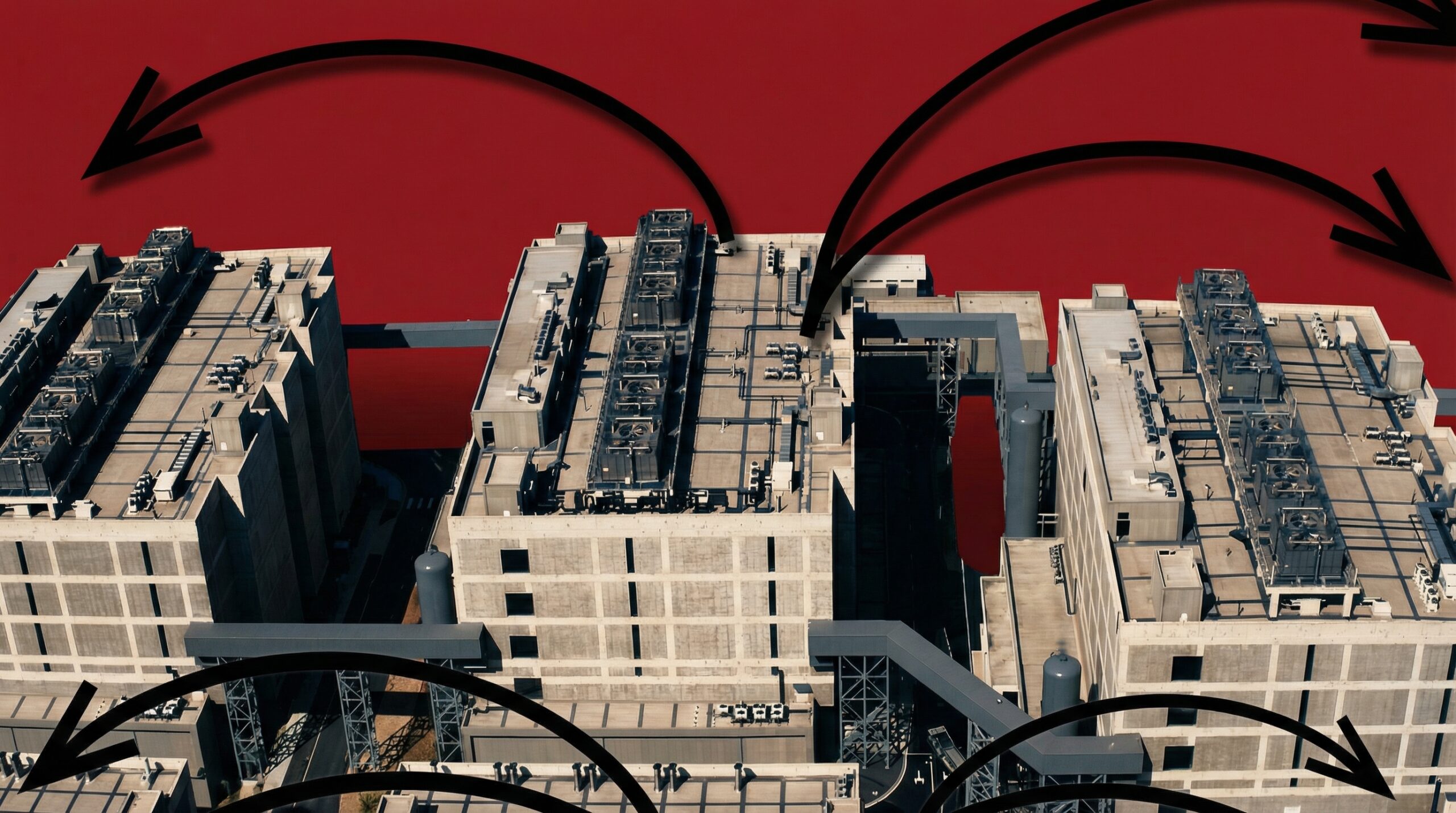

Palantir, experta en análisis de datos con IA, ha profundizado su relación con ICE mediante plataformas que fusionan datos comerciales y gubernamentales. ImmigrationOS ofrece visibilidad en tiempo real para identificar pandilleros, violentos y overstays de visa. ELITE desactiva salvaguardas en ‘operaciones especiales’, facilitando redadas con heat-maps. Monitoreo de redes sociales vía Clearview AI y ShadowDragon añade vigilancia continua, con scoring predictivo que exporta listas accionables. Estas herramientas, rechazadas parcialmente en 2020 por riesgos, resurgen con la administración Trump, vinculada a Thiel y JD Vance.

Empleados expresan inquietudes por la opacidad: decisiones automatizadas difíciles de auditar, integrando datos de Medicaid que podrían afectar a ciudadanos. Incidentes como el tiroteo en Operation Metro Surge resaltan riesgos reales de violencia.

Implicaciones éticas y de privacidad

Las preocupaciones éticas empleados Palantir centran en la weaponización de IA para enforcement masivo. EFF y el senador Wyden critican abusos potenciales contra estadounidenses, discriminación vía algoritmos y falta de auditorías humanas. Datos comerciales se convierten en herramientas de deportación, erosionando privacidad sin consentimiento. Palantir refuta como ‘engañosas’ estas acusaciones, pero la integración de fuentes múltiples plantea dilemas sobre sesgos en scoring y vigilancia ‘always-on’.

Precedentes como demandas de libertades civiles subrayan consecuencias no intencionadas: autodeportaciones inducidas por tracking y operaciones letales.

Perspectiva técnica y reacciones del sector

Técnicamente, estas plataformas destacan la potencia de IA en fusión de datos masivos y geospatial analytics, impulsando eficiencia en enforcement. Sin embargo, preocupaciones éticas empleados Palantir reflejan tensiones entre innovación y control estatal. Protestas internas contrastan con el rechazo previo a contratos ERO, demandando auditorías de derechos humanos.

Palantir defiende su rol en priorizar ‘criminales violentos’, pero críticos ven hipocresía en rechazar sobrerregulación mientras habilita vigilancia masiva.

Análisis Blixel:

Como redactor escéptico de narrativas oficiales, veo en estas preocupaciones éticas empleados Palantir un choque clásico entre avance tecnológico y apetito estatal por control. Palantir innova con IA puntera –fusión de datos, scoring predictivo, analytics geospaciales– que podría optimizar cualquier operación logística, pero aquí se weaponiza para deportaciones. ¿Ironía? Los mismos que claman por ‘ética’ en IA ignoran datos duros: ICE prioriza criminales reales, con puntuaciones del 98,95% basadas en evidencias verificables de HHS y USCIS. EFF y Wyden agitan fantasmas de abusos, pero ¿dónde estaban cuando Medicaid filtraba datos sin IA?

El libertarianismo pragmático me dicta defender la innovación: rechazar estos contratos por ‘ética’ frena el libre mercado tech, cediendo terreno a regulaciones asfixiantes. Palantir rechazó ERO en 2020 por riesgos desproporcionados; hoy, con Trump, asume el desafío. Tensiones internas son sanas –evidencia de debate genuino–, no propaganda. Riesgos reales existen: sesgos algorítmicos, incidentes fatales como Renee Nicole Good. Solución no es censura tech, sino auditorías transparentes y límites legales claros, sin hipocresía corporativista. La IA acelera enforcement, pero el problema radica en políticas migratorias opacas, no en la herramienta. Futuro: equilibrar privacidad con seguridad vía mercados libres, no estados omnipotentes disfrazados de protectores.